"此段文字包含了人工智能和深度学习领域的重要发展历程和技术关键点。"

这段文本实际上列举了一系列在人工智能和深度学习领域的重要里程碑事件和技术发展。以下是这些事件和技术的详细解释:

1. XOR问题:在1969年,PLA(Perceptron Learning Algorithm)无法解决XOR问题,这个问题暴露了单层感知器的局限性,推动了多层神经网络的研究。

2. 多层感知器(MLP):1981年,MLP(Multi-Layer Perceptron)的发展引入了反向传播算法,使得神经网络能够处理非线性可分的问题。

3. BP算法:1986年,BP(Backpropagation)算法被提出,用于训练多层神经网络,这是现代深度学习的基础之一。

4. 卷积神经网络(CNN):1989年,CNN(Convolutional Neural Network)被引入,其在图像识别任务中的表现优异,尤其是由于 Universal Approximation Theorem 提供了理论支持。

5. LSTM:1997年,LSTM(Long Short-Term Memory)网络被提出,是循环神经网络的一种,有效解决了序列数据的长期依赖问题。

6. GPU加速:2009年,GPU(Graphics Processing Unit)被广泛应用于深度学习,显著提升了训练速度,使得大规模神经网络的训练成为可能。

7. ImageNet竞赛:2012年,ImageNet大赛推动了深度学习的革命,AlexNet的胜利证明了深度学习在图像分类上的优越性。

8. VAE(变分自编码器):2013年,VAE作为一种生成模型,结合了概率论与深度学习,用于数据降维和生成新样本。

9. GAN(生成对抗网络):2014年,GAN的出现开创了新的生成模型领域,可以生成逼真的图像和其他类型的数据。

10. AlphaGo:2016年,谷歌DeepMind的AlphaGo战胜了世界围棋冠军,展示了深度强化学习的巨大潜力。

11. GNN(图神经网络):2018年,GNN的发展允许处理图结构数据,为社交网络分析、化学分子结构研究等领域带来了突破。

此外,文本还提到了一些关键概念:

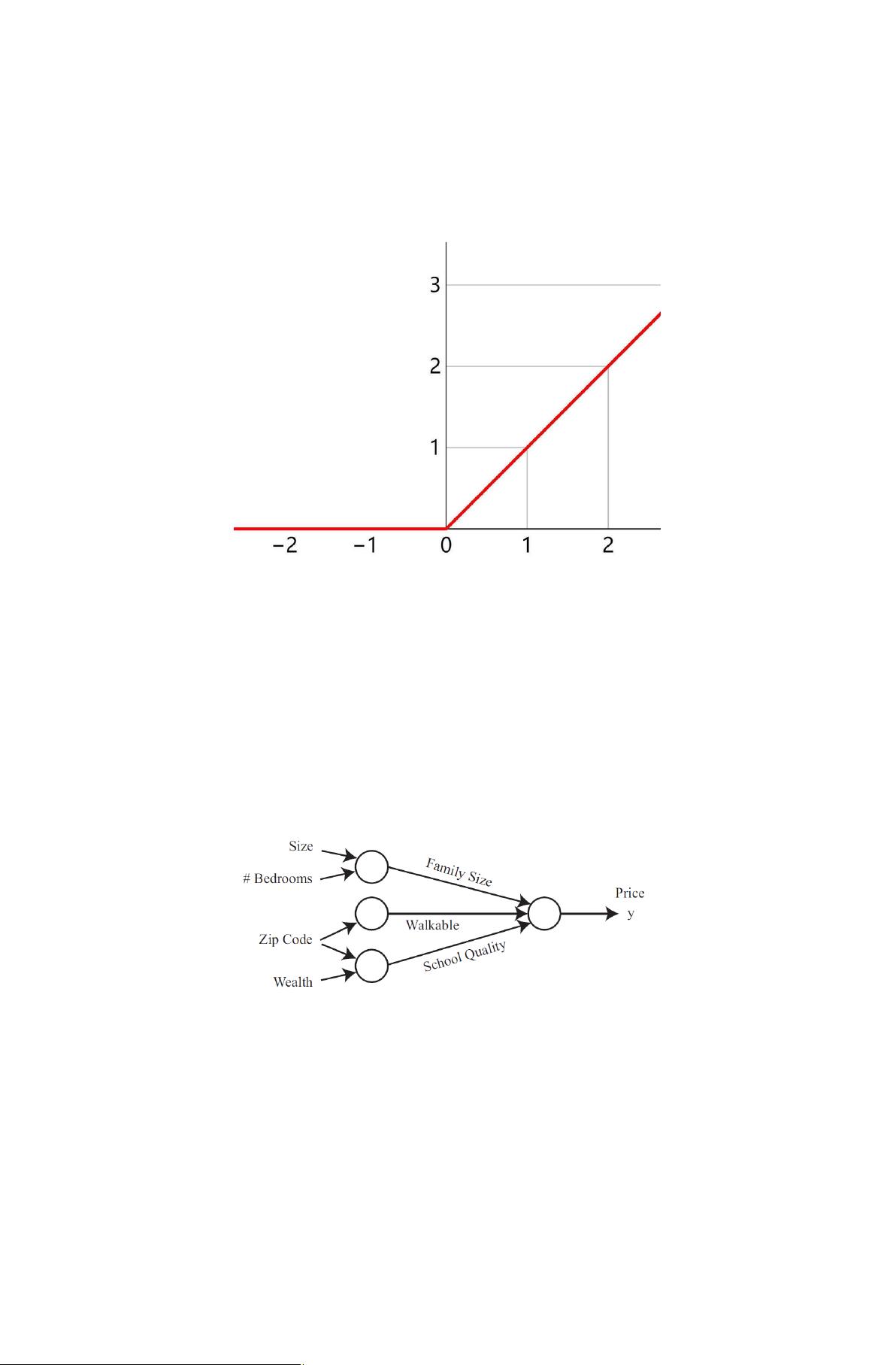

- 非线性可分:许多实际问题不能通过简单的线性边界解决,这推动了多层网络的发展。

- 损失函数:如均方误差(MSE),用于衡量模型预测值与真实值之间的差异,是优化过程的关键部分。

- 学习率:控制模型参数更新的速度,对训练过程的收敛性至关重要。

- 反向传播:通过计算损失函数关于权重的梯度来更新权重,是多层网络训练的核心。

这些事件和技术构成了深度学习领域的重要历史和发展脉络,展示了人工智能从早期概念到现代复杂模型的演变。