深度残差收缩网络:融合注意力与信号降噪的故障诊断利器

需积分: 50 63 浏览量

更新于2024-07-16

收藏 437KB DOCX 举报

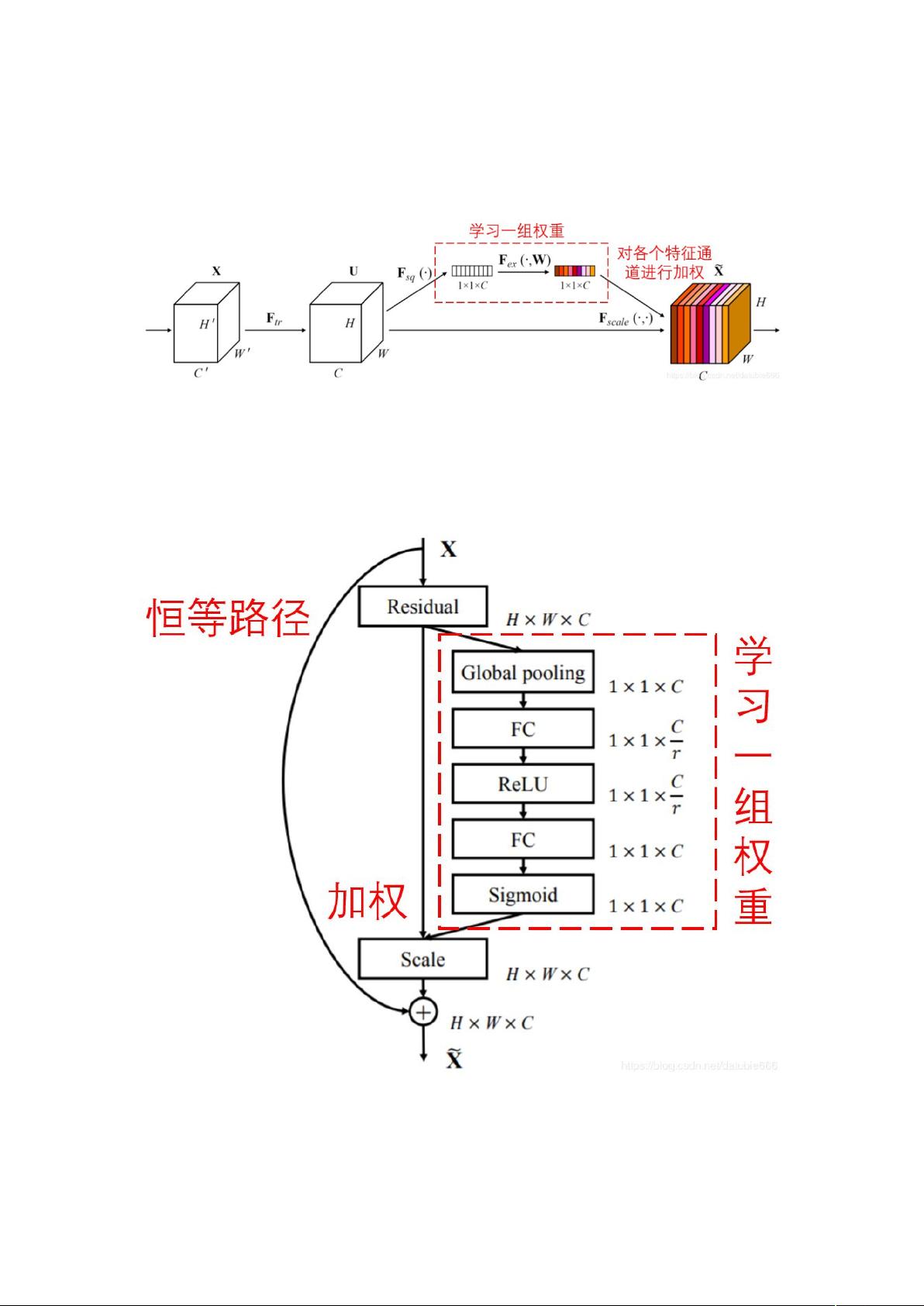

深度残差网络(Residual Networks, ResNet)在2016年的IEEE Conference on Computer Vision and Pattern Recognition中因其出色的表现荣获最佳论文奖,至今在学术界享有高度关注,尤其是在深度学习领域,其引用次数超过38,000次。然而,随着研究的深入,研究人员提出了深度残差收缩网络(Deep Residual Shrinkage Networks),这是一个融合了深度残差结构、注意力机制以及软阈值函数的创新方法。

深度残差收缩网络的主要目的是解决深度学习模型在处理含噪声数据时面临的挑战。噪声可以来源于各种形式,如高斯噪声、粉色噪声或拉普拉斯噪声,这些都可能干扰模型对有用信息的提取。在深度神经网络中,软阈值化作为一种关键的信号降噪技术,通过设定阈值,将那些小于阈值的特征视为噪声并删除,而对大于阈值的特征则进行收缩到零的操作。这样有助于剔除无关特征,提高模型的鲁棒性和准确性。

提出深度残差收缩网络的原因在于两个主要方面:

1. 噪声抑制:在样本分类过程中,确保模型忽略噪声至关重要。例如,在语音识别中,车辆噪声会干扰识别性能。深度残差收缩网络利用注意力机制识别出与当前任务无关的特征,通过软阈值化将其抑制,以提升模型的纯净度。

2. 多样性适应:即使在同一批样本中,噪声水平也会有所不同。深度残差收缩网络能够动态地处理这种多样性,通过注意力机制对每个样本的特性进行个性化处理,比如在猫狗分类中,识别并排除不同场景中出现的其他动物特征,从而提高分类精度。

深度残差收缩网络是一种先进的深度学习架构,它通过结合残差连接、注意力机制和软阈值化策略,有效地处理噪声,增强模型对复杂数据集的适应能力,从而在实际问题中展现出显著的优势。对于对深度学习和信号处理感兴趣的读者,深入理解并应用这种网络结构将有助于提升在噪声环境下的任务表现。

660 浏览量

635 浏览量

1330 浏览量

135 浏览量

216 浏览量

193 浏览量

178 浏览量

140 浏览量

416 浏览量

ChooseAndBelieve

- 粉丝: 0

最新资源

- VS2010环境Qt链接MySQL数据库测试程序

- daycula-vim主题:黑暗风格的Vim色彩方案

- HTTPComponents最新版本发布,客户端与核心组件升级

- Android WebView与JS互调的实践示例

- 教务管理系统功能全面,操作简便,适用于winxp及以上版本

- 使用堆栈实现四则运算的编程实践

- 开源Lisp实现的联合生成算法及多面体计算

- 细胞图像处理与模式识别检测技术

- 深入解析psimedia:音频视频RTP抽象库

- 传名广告联盟商业正式版 v5.3 功能全面升级

- JSON序列化与反序列化实例教程

- 手机美食餐饮微官网HTML源码开源项目

- 基于联合相关变换的图像识别程序与土豆形貌图片库

- C#毕业设计:超市进销存管理系统实现

- 高效下载地址转换器:迅雷与快车互转

- 探索inoutPrimaryrepo项目:JavaScript的核心应用