鸢尾花分类探索:KNN与K-Means算法实战

13 浏览量

更新于2024-08-03

收藏 370KB PDF 举报

"鸢尾花数据集通过MATLAB进行可视化分析和分类,主要涉及KNN算法和K-Means聚类。"

在机器学习领域,鸢尾花数据集(Iris dataset)是一个经典的数据集,用于展示不同的分类方法。本案例中,我们将使用MATLAB来对鸢尾花数据进行散点图绘制以及K近邻(KNN)分类和K-Means聚类。

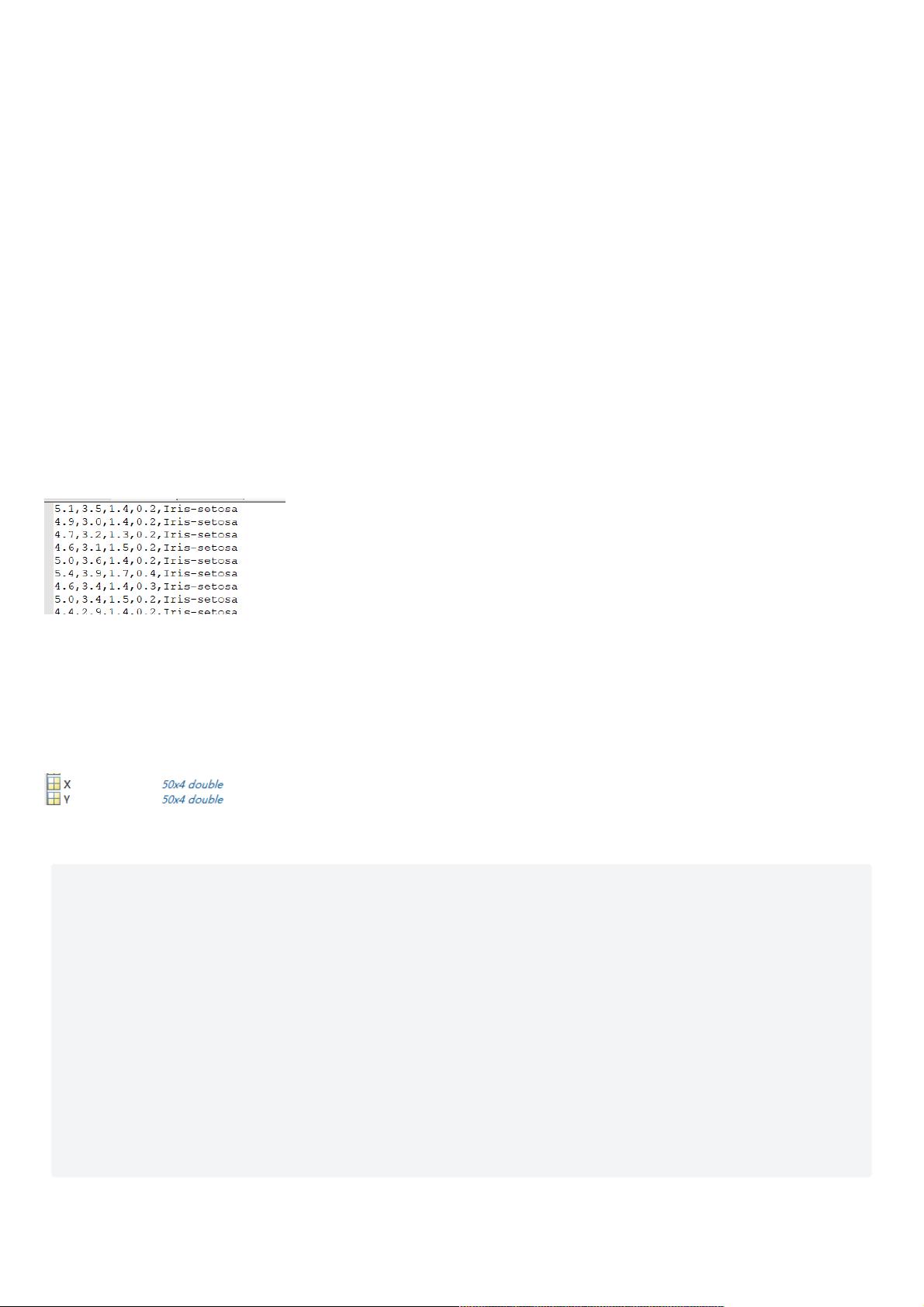

首先,鸢尾花数据集包含三个类别:IrisSetosa、IrisVersicolour和IrisVirginica,每个类别有50个样本,每个样本具有四个特征:萼片长度(sepallengthincm)、萼片宽度(sepalwidthincm)、花瓣长度(petallengthincm)和花瓣宽度(petalwidthincm)。数据可以通过CSV文件或直接在MATLAB中导入。

对于数据处理,我们可以将数据导入MATLAB并创建三个矩阵X、Y和Z,分别对应三种鸢尾花类别的样本。接下来,我们绘制散点图来直观地比较不同特征之间的关系。通过MATLAB的`combntns`函数,我们可以生成所有可能的特征组合,然后对每一对特征绘制散点图。散点图的颜色表示不同的鸢尾花种类,有助于我们观察各类别的分布情况。

然后,我们转向K近邻(KNN)分类算法。KNN是一种基于实例的学习,其核心思想是通过找到测试样本最近的K个邻居,根据这些邻居的类别决定测试样本的类别。KNN的关键要素包括:

1. **K值的选取**:K值决定了考虑的邻居数量。较小的K值可能导致过拟合,而较大的K值可能会引入噪声,使得分类边界变得模糊。通常,K值会选择一个较小的奇数,以避免平局。

2. **距离度量**:用于计算样本之间的相似性。常见的距离度量有:

- **欧式距离**:是最常用的距离度量,定义为两个向量之间各元素差的平方和的平方根。

- **汉明距离**:适用于离散特征,计算两个二进制字符串的差异位数。

- **曼哈顿距离**:在各个维度上绝对差的总和,适合于没有相关性的特征。

- **闵可夫斯基距离**:欧式距离和曼哈顿距离的推广,当p=1时为曼哈顿距离,p=2时为欧式距离。

3. **分类决策的制定**:多数投票原则是最常见的决策方式,即选择K个邻居中出现次数最多的类别作为测试样本的预测类别。

在MATLAB中实现KNN分类,我们需要计算测试样本到训练集中所有样本的距离,找到K个最近的邻居,然后根据邻居的类别进行投票。

此外,K-Means聚类算法也是数据挖掘中的常用方法,它通过迭代过程将样本分配到K个簇中,使得簇内的样本点尽可能接近,而簇间的样本点尽可能远离。虽然KNN和K-Means都与K值有关,但它们的目的是不同的:KNN用于分类,K-Means用于无监督的聚类。

在MATLAB中,可以使用内置的`kmeans`函数执行K-Means聚类。不过,该案例主要关注了KNN分类,没有详细描述K-Means的实现过程。

这个案例提供了一个很好的示例,展示了如何利用MATLAB对鸢尾花数据进行可视化和分类,同时涵盖了KNN算法的基本概念和实现。通过这样的实践,我们可以更好地理解和应用这些机器学习技术。

2024-04-16 上传

2021-10-01 上传

2021-02-14 上传

2023-09-06 上传

2023-05-17 上传

2023-08-29 上传

2023-08-30 上传

2023-08-27 上传

2023-06-09 上传

zz_ll9023

- 粉丝: 1079

- 资源: 5267

最新资源

- FiniteDifferencePricing:Crank Nicolson方案的C ++应用程序通过Green函数对付红利的美国期权定价

- es6-jest-ramda-样板

- WindowsTerminalHere:右击.inf文件的Windows终端的资源管理器“此处的Windows终端”,直到直接支持它为止

- IAAC_Cloud-Based-Management_FR:该存储库是IAAC(MaCAD计划)的基于云的管理研讨会的最终提交内容的一部分

- 实现界面放大镜功能ios源码下载

- 电子功用-基于应用统计方法和嵌入式计算的智能电子闹钟设定方法

- 汉堡建筑商

- infogram-java-samples

- ct-ng-toolchains:适用于Altera SoCFPGA和NXP LPC32xx目标的裸机ARM工具链

- StudyMegaParsec:研究megaparsec的用法

- vercelly-app:React Native应用程序,用于管理Vercel项目和部署

- 一个很漂亮的VC++登录窗体界面

- hackontrol-frontend:一个React JS前端应用程序Hackontrol

- 基于micropython的ESP32血压、血氧、心率、体温的传感系统(python)

- crispy-couscous

- Echarts商业级数据图表库模块v1.6.0.241.rar