Linux常用命令详解:cat与chattr功能与应用

需积分: 3 56 浏览量

更新于2024-07-20

收藏 1.57MB DOC 举报

Linux 是一种广泛使用的开源操作系统,以其强大的命令行工具著称。本文将深入探讨两个常用的Linux命令:`cat` 和 `chattr`,它们在文件管理和权限控制中发挥着关键作用。

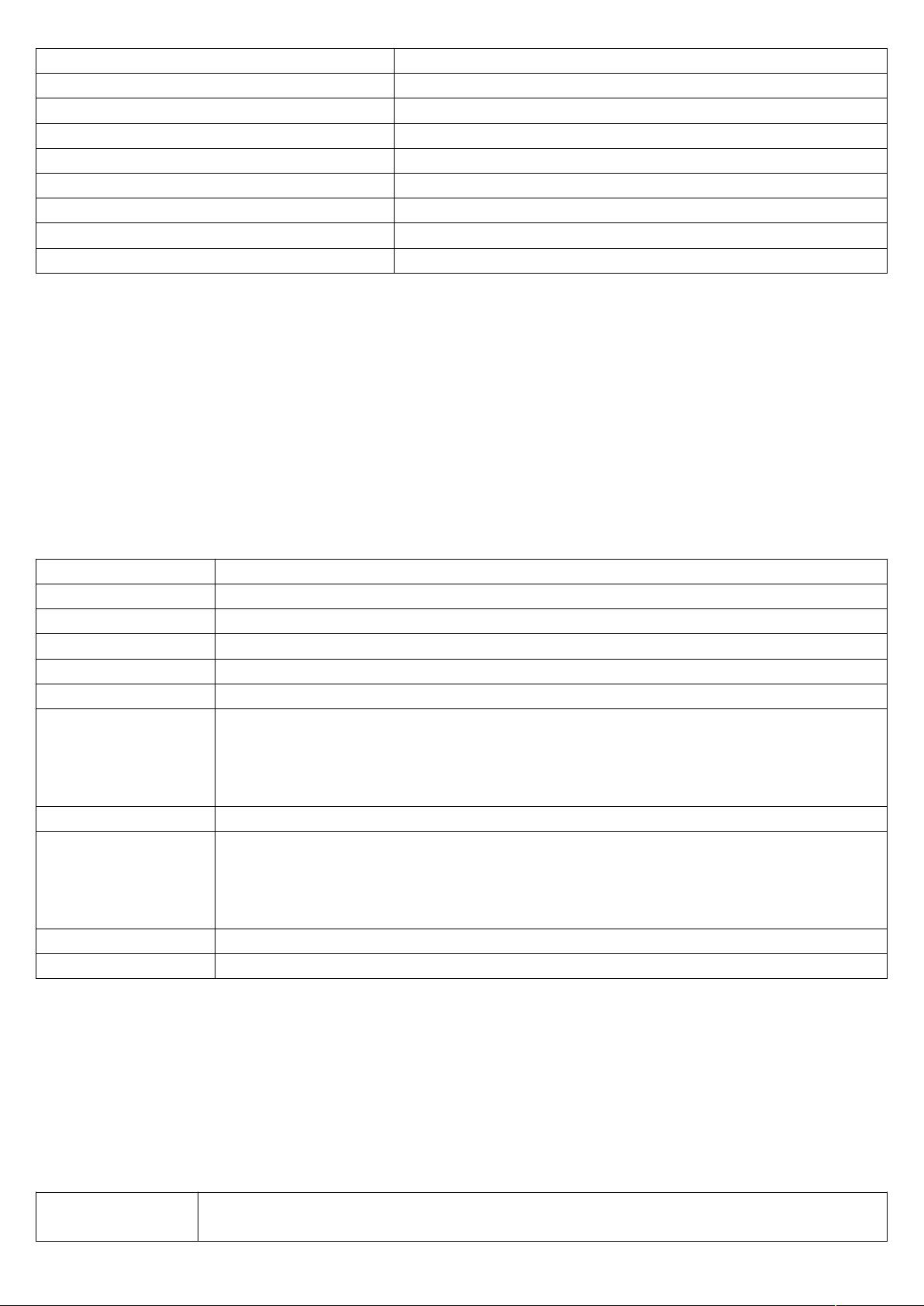

**1. cat命令**

`cat` 是一个基础但功能强大的文本处理工具,它的主要功能是连接和显示多个文件的内容。默认情况下,它会将所有输入文件的内容连接在一起并输出到标准输出(通常是屏幕),如果提供了输出文件名(如`> fileName`),则会将内容追加到该文件中。`cat` 命令支持多种选项,例如:

- `-n` 或 `--number`:为输出的每一行添加行号。

- `-b` 或 `-n` 的变体:仅对非空白行编号。

- `-s` 或 `--squeeze-blank`:消除连续的空白行。

- `-v` 或 `--show-nonprinting`:显示不可打印字符。

- 示例中,`cat -ntextfile1 > textfile2`用于将`textfile1`的内容加上行号并写入`textfile2`,而`textfile2 >> textfile3`则是将`textfile2`的内容追加到`textfile3`。

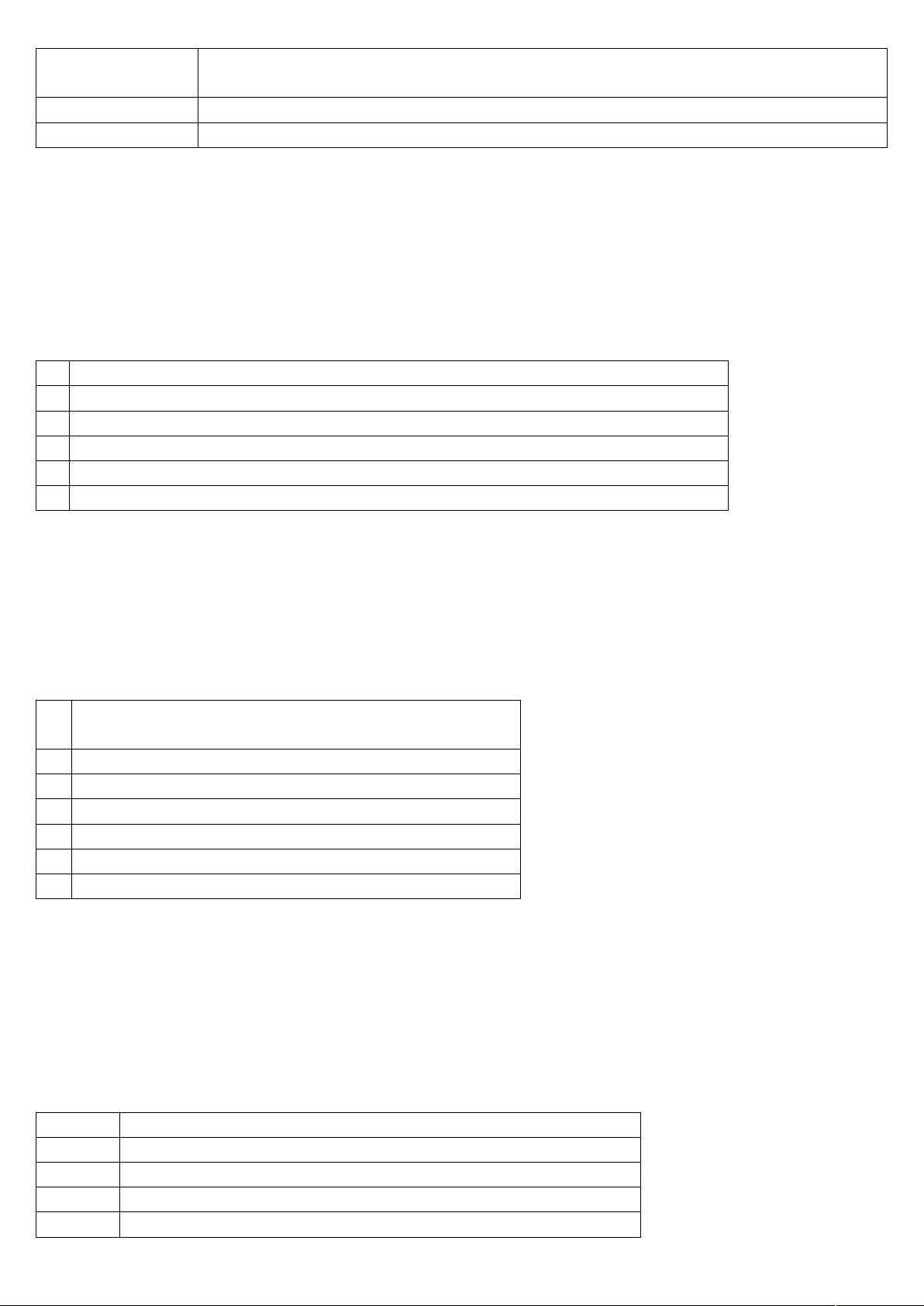

**2. chattr命令**

`chattr` 是用来改变文件或目录的元数据属性,特别适用于ext2文件系统。该命令可用于设置以下八种属性:

- `a`:只允许附加,不允许修改。

- `b`:不更新最后访问时间。

- `c`:压缩文件或目录存储。

- `d`:不参与备份(排除在垃圾回收操作外)。

- `i`:锁定文件,禁止修改。

- `s`:保密删除,不可恢复。

- `S`:实时更新文件或目录属性。

- `u`:防止意外删除,增加保护。

`chattr` 命令的常用选项包括:

- `-R`:递归处理,作用于目录及其所有内容。

- `-v` 或 `-V`:分别用于查看当前属性和显示操作过程。

- `+<属性>`、`-<属性>` 和 `<属性>`:分别用于启用、禁用或指定特定属性。

`chgrp` 命令用于更改文件或目录的群组所有权,与`chattr`不同,但同样重要,因为它控制了文件权限的分配。

通过熟练掌握这些命令及其参数,用户可以在Linux环境下高效地管理文件、保持数据安全性和执行权限操作。理解这两个命令的用法对于Linux系统管理员和开发人员来说是必不可少的,它们简化了文件操作流程,提高了系统的灵活性和安全性。

1694 浏览量

948 浏览量

3927 浏览量

2025-02-17 上传

2025-02-17 上传

2025-02-17 上传

hh383750599

- 粉丝: 0

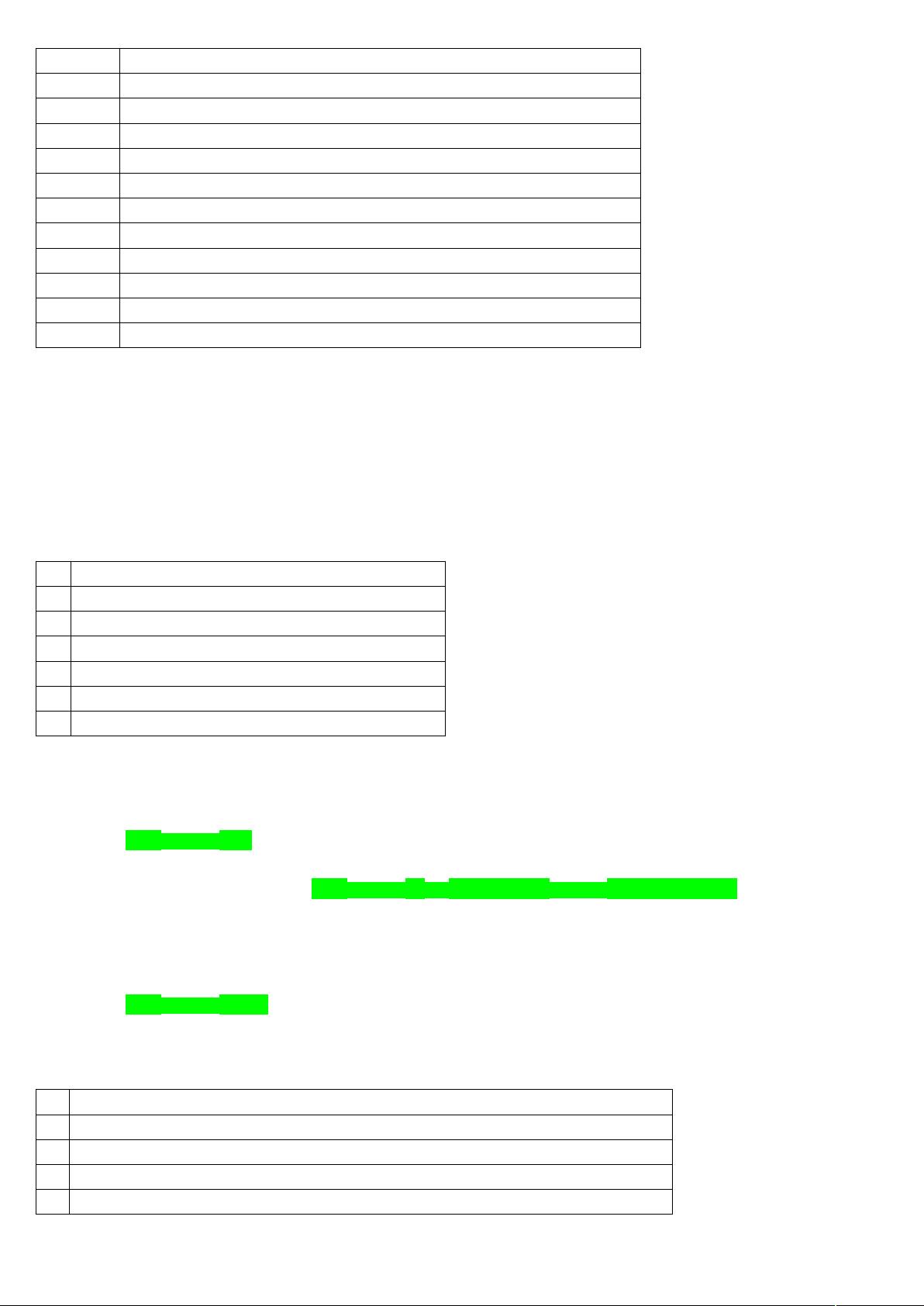

最新资源

- Node.js项目mmRequest-demo的实践教程

- Matconvnet1.0-beta20:Matlab深度学习工具包深度解析

- GGTabBar:实现IOS多选项卡的简单案例源码

- 省市县镇村五级数据导入数据库操作指南

- MFC制作的洗牌系统:界面优化体验

- Android Studio 邮件发送功能实现演示

- 彻底清理旧.NET框架的免费工具下载

- MATLAB实现一元线性回归算法详解

- 掌握JavaScript的课堂简单练习

- SDN中的POX控制器负载均衡策略代码

- Swift实现的点击弹出动态菜单效果教程

- SSM框架与ORACLE数据库整合教程

- Windows系统下的Redis服务部署指南

- WinWebMail v3.8:邮件服务器的高效解决方案与聚类分析算法

- 免费获取虚拟版Visual C++ 6.0 Repack版下载

- 2022年美赛备资料精选集合