深度解析:卷积神经网络结构与应用详解

需积分: 16 90 浏览量

更新于2024-09-10

收藏 484KB PPTX 举报

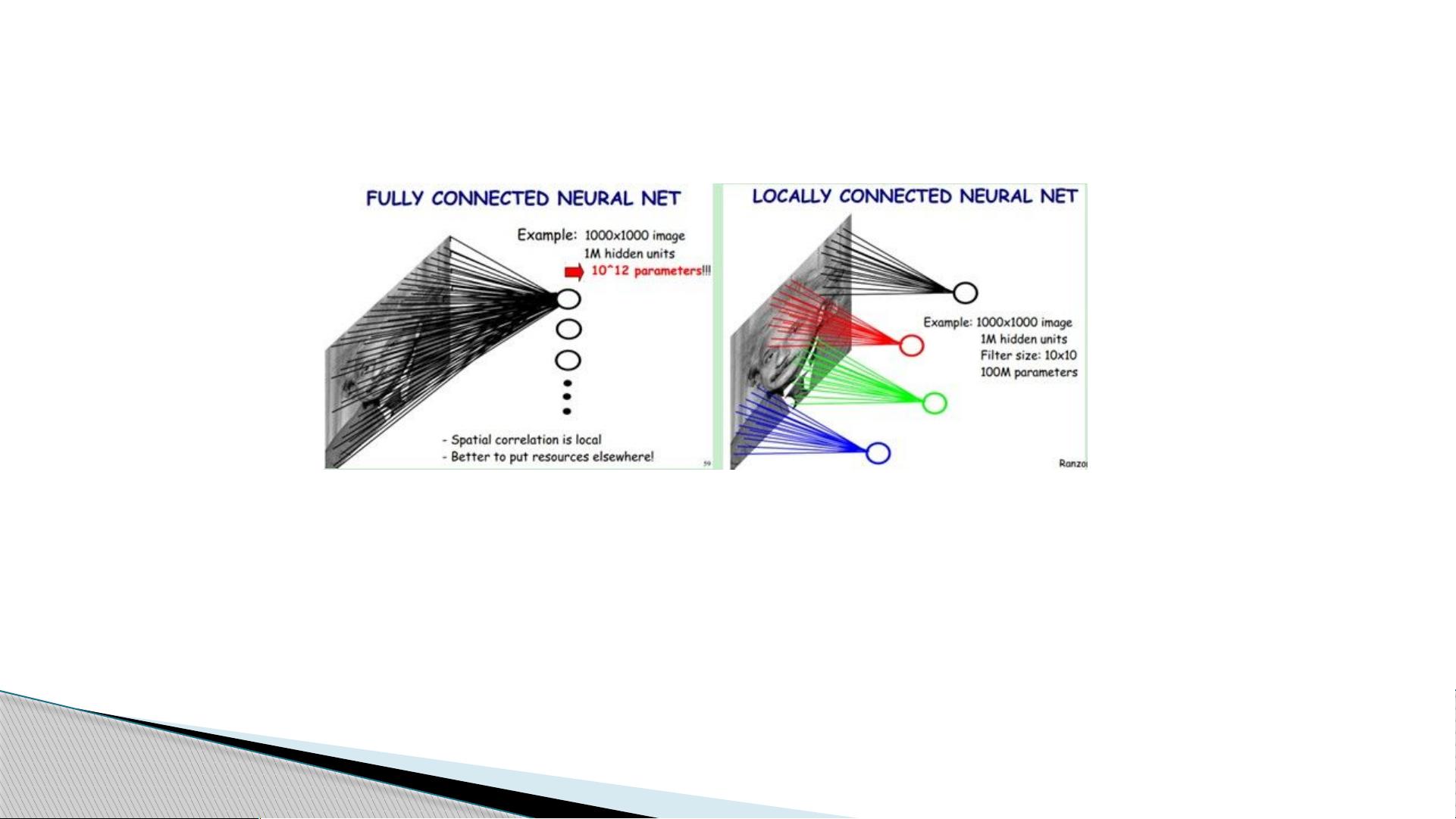

卷积神经网络(Convolutional Neural Networks, CNN)是一种深度学习架构,特别适用于图像和视频等数据的处理,因其高效地捕捉局部特征并减少了参数数量而广受欢迎。在本篇PPT中,作者对CNN进行了详尽的讲解,包括以下几个关键组成部分:

1. **数据输入层**:

数据输入层是CNN的起点,负责接收原始的像素数据或特征矩阵。它不涉及复杂的连接方式,而是直接将输入数据馈送到网络中。

2. **卷积层(Feature Map Layer)**:

卷积层的核心特性是局部连接和权值共享。每个神经元仅与其前一层的特定区域(局部接受域)相连,通过滑动窗口的方式提取局部特征。这种设计允许网络学习到输入数据中的不变特征,如边缘、纹理等。卷积操作有助于降低参数数量,避免过拟合。

3. **激励函数**:

激励函数用于引入非线性,使神经网络能够处理复杂的数据模式。常见的激励函数包括Sigmoid、Tanh、ReLU(Rectified Linear Unit)以及Leaky ReLU,这些函数分别具有不同的激活效果和优点。

4. **池化层(Pooling Layer)**:

池化层用于特征的下采样,减少数据维度,进一步降低计算量,同时保持重要的特征信息。常用的池化操作有最大池化和平均池化,它们在一定程度上实现了数据的不变性和鲁棒性。

5. **全连接层(Dense Layer)**:

在卷积层之后,全连接层将先前的特征图展平成一维向量,然后用1x1的卷积(也称为“1D卷积”或“内积”)进行连接,这相当于传统神经网络中的分类层。这些特征向量经过一些分类器处理后,用于最终的分类任务。

通过这些层次结构,CNN有效地提取了输入数据的多级抽象特征,使得网络在图像识别、物体检测、语音识别等领域表现出色。动态展示图使得理解这些概念更为直观,帮助学习者深入掌握卷积神经网络的工作原理和优势。

2018-01-31 上传

2020-11-11 上传

2022-01-15 上传

2022-11-22 上传

点击了解资源详情

2023-03-13 上传

wujx0213

- 粉丝: 1

- 资源: 6

最新资源

- 全国江河水系图层shp文件包下载

- 点云二值化测试数据集的详细解读

- JDiskCat:跨平台开源磁盘目录工具

- 加密FS模块:实现动态文件加密的Node.js包

- 宠物小精灵记忆配对游戏:强化你的命名记忆

- React入门教程:创建React应用与脚本使用指南

- Linux和Unix文件标记解决方案:贝岭的matlab代码

- Unity射击游戏UI套件:支持C#与多种屏幕布局

- MapboxGL Draw自定义模式:高效切割多边形方法

- C语言课程设计:计算机程序编辑语言的应用与优势

- 吴恩达课程手写实现Python优化器和网络模型

- PFT_2019项目:ft_printf测试器的新版测试规范

- MySQL数据库备份Shell脚本使用指南

- Ohbug扩展实现屏幕录像功能

- Ember CLI 插件:ember-cli-i18n-lazy-lookup 实现高效国际化

- Wireshark网络调试工具:中文支持的网口发包与分析