哈工大PCA算法详解:Fisher准则与特征向量转换

需积分: 17 59 浏览量

更新于2024-09-10

收藏 596KB PDF 举报

本讲义主要探讨的是哈尔滨工业大学(哈工大)的研究生课程中关于主成分分析(PCA)算法及其基于Fisher准则的应用。PCA是一种常用的数据降维方法,通过最大化数据方差来找到数据的主要方向,常用于特征提取和数据分析中。Fisher准则在此处可能指的是Fisher判别准则,它在分类问题中特别有效,有助于找到不同类别之间的最大分离。

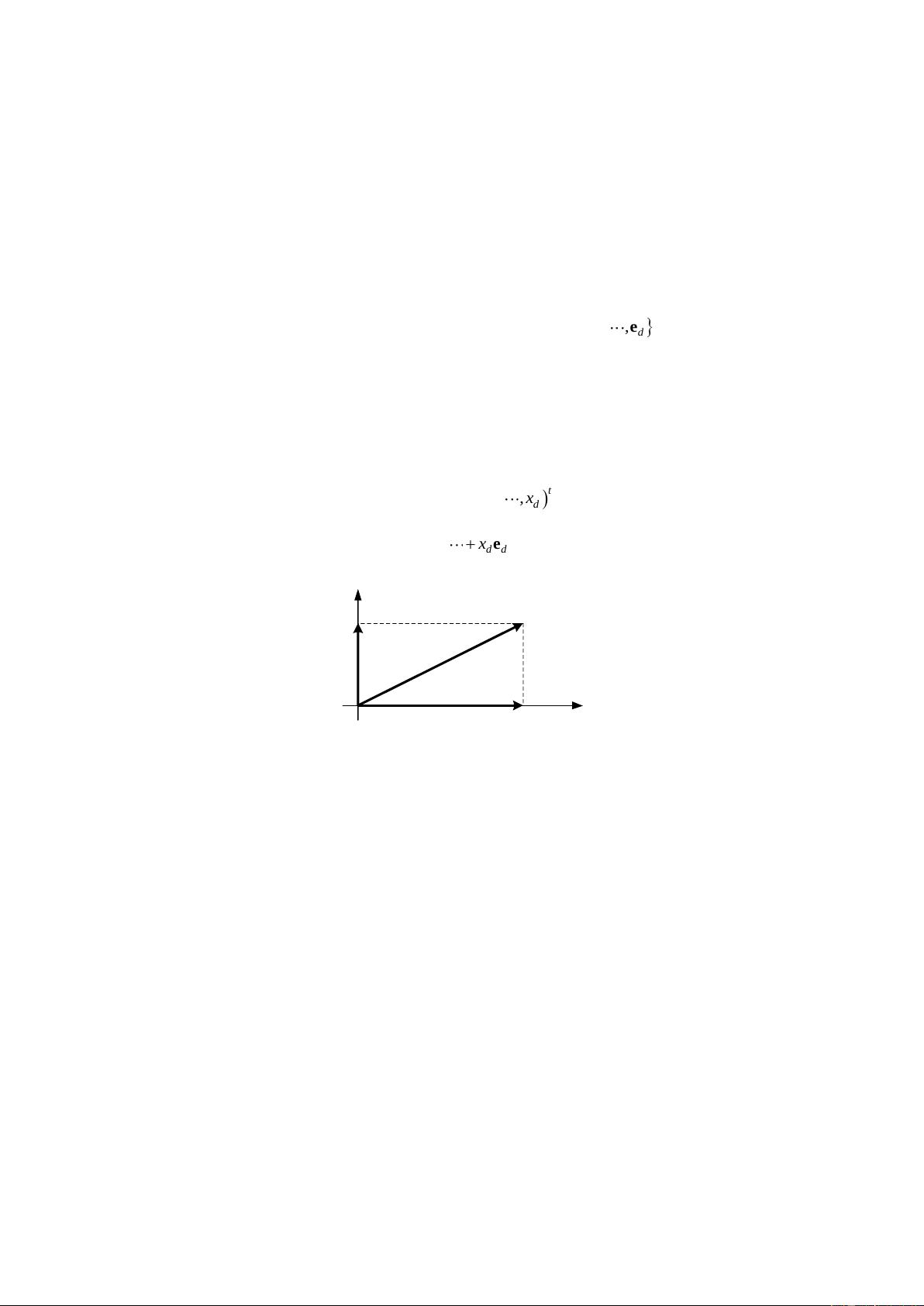

首先,讲义强调了矢量和坐标系的概念,指出特征向量通常用坐标表示,每个分量代表其在特定坐标轴上的投影。一个标准正交坐标系由单位长度且相互垂直的基向量组成,如直角坐标系。通过内积运算,我们可以确定向量在各坐标轴上的分量。

接着,讲义深入到PCA算法的推导。在样本集合中,每个样本对应特征空间中的一个点。在不同的坐标系下,同一样本的表示会发生变化,但本质信息不变。这里举了一个从原坐标系到新坐标系转换的例子,其中新坐标系可能更有利于数据的解释或处理。新坐标系的基向量、原点偏移量μ以及向量x的变换关系被明确地给出。

公式(1)表明新坐标系下向量的变化是由于原向量加上一个常向量μ;公式(2)展示了在新坐标系下,向量的坐标由原向量和μ以及基向量的线性组合决定;而公式(3)则给出了如何通过原向量和基向量计算新坐标系下的分量。

Fisher准则在这里可能是用来指导选择最佳的主成分方向,使得不同类别的样本在新坐标系中尽可能分离,从而简化模型并提高分类性能。理解这些概念对于理解和实施PCA算法至关重要,特别是在实际数据分析和机器学习项目中。

总结来说,这门哈工大的讲义深入讲解了PCA的数学原理,特别是如何通过Fisher准则来优化坐标变换,以便在处理高维数据时降低复杂性,并保持关键信息。这对于那些希望在数据分析或机器学习领域运用PCA技术的学生和研究者来说是一份宝贵的参考资料。

2022-07-15 上传

2022-09-21 上传

2022-07-14 上传

2018-04-15 上传

2022-09-24 上传

chaihahaha

- 粉丝: 0

- 资源: 25

最新资源

- Aspose资源包:转PDF无水印学习工具

- Go语言控制台输入输出操作教程

- 红外遥控报警器原理及应用详解下载

- 控制卷筒纸侧面位置的先进装置技术解析

- 易语言加解密例程源码详解与实践

- SpringMVC客户管理系统:Hibernate与Bootstrap集成实践

- 深入理解JavaScript Set与WeakSet的使用

- 深入解析接收存储及发送装置的广播技术方法

- zyString模块1.0源码公开-易语言编程利器

- Android记分板UI设计:SimpleScoreboard的简洁与高效

- 量子网格列设置存储组件:开源解决方案

- 全面技术源码合集:CcVita Php Check v1.1

- 中军创易语言抢购软件:付款功能解析

- Python手动实现图像滤波教程

- MATLAB源代码实现基于DFT的量子传输分析

- 开源程序Hukoch.exe:简化食谱管理与导入功能