SVM入门解析:从基础到应用

需积分: 9 20 浏览量

更新于2024-07-26

1

收藏 380KB DOC 举报

"SVM入门教程,讲解SVM的基本原理和应用,适合初学者学习"

支持向量机(Support Vector Machine,简称SVM)是一种监督学习算法,尤其在小样本、非线性和高维数据集上的分类和回归任务中表现突出。它的核心思想是通过构建最大边距超平面作为决策边界,将不同类别的数据点最大程度地分开。

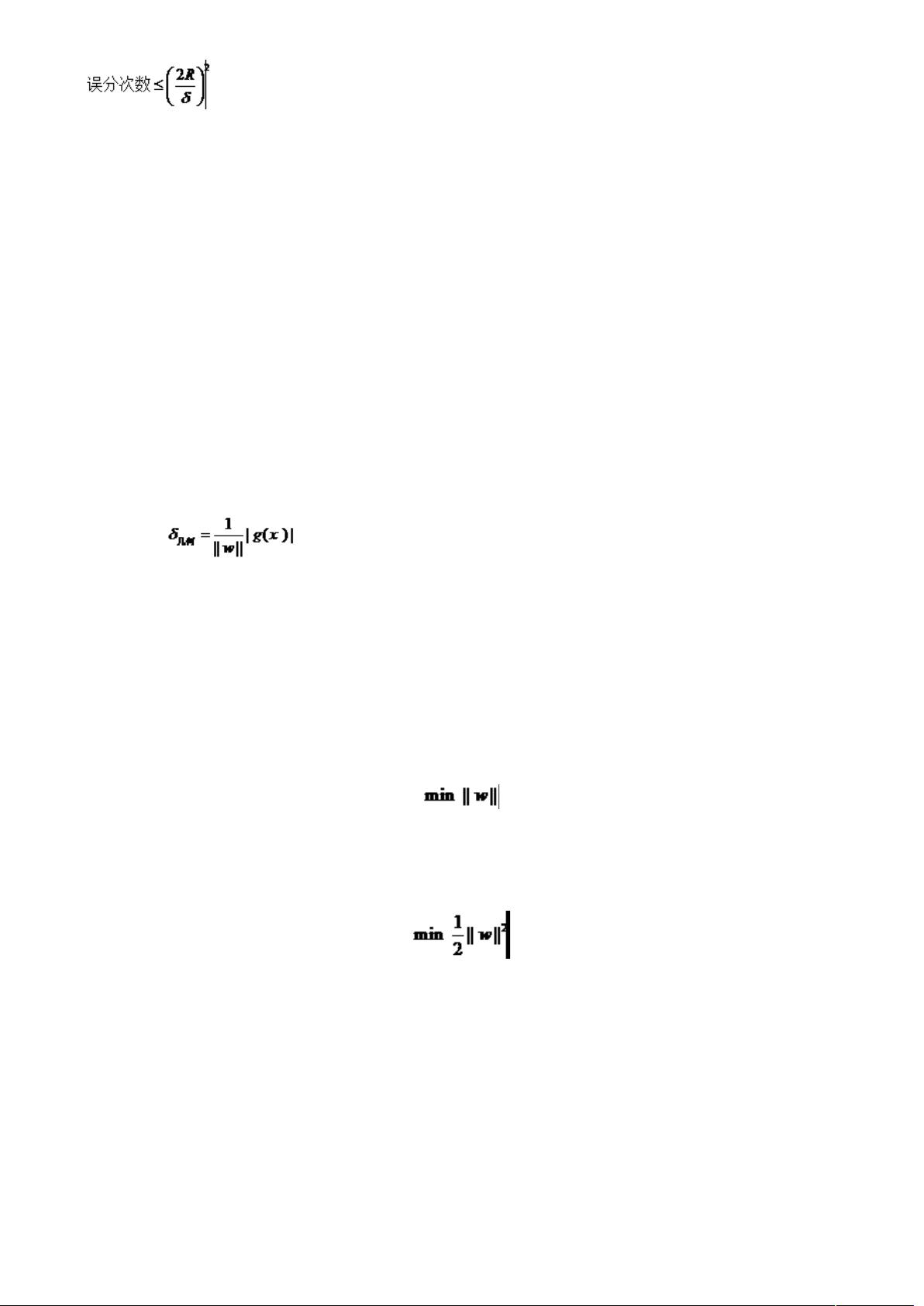

在SVM的理论基础中,Vapnik-Chervonenkis (VC) 维度是一个关键概念,它量化了一个模型的复杂度。VC维越高,表示模型能够学习的复杂模式越多,但也可能导致过拟合。SVM的目标是在保证分类性能的同时,选择具有较低VC维的模型,以达到较好的泛化能力。

结构风险最小化是SVM追求的目标,这是统计学习理论中的一个重要原则。它强调在训练过程中,不仅要考虑模型在现有样本上的表现(即经验风险),还要考虑模型对未见过数据的预测能力(即期望风险)。通过优化这两者之间的平衡,SVM寻找一个在训练误差和潜在泛化误差之间有最优权衡的模型。

SVM的一个独特之处在于它引入了核函数。核函数能够将原始低维数据映射到高维空间,使得在高维空间中原本难以分离的数据在低维空间中变得可分。这使得SVM可以处理非线性问题,即使数据集的维度非常高,也能有效应对。

在实际应用中,SVM广泛应用于各种领域,如文本分类、生物信息学、图像识别等。对于初学者而言,理解SVM的核心概念,包括最大边距、支持向量、核函数以及结构风险最小化,是掌握SVM的关键。同时,学习如何选择合适的核函数、调整超参数以及解决过拟合问题,也是掌握SVM实战技能的重要部分。

SVM提供了一种强大而灵活的工具,用于处理各种机器学习问题。其理论基础和实践应用都值得深入学习和探索,特别是对于那些希望在数据科学领域有所建树的人来说,SVM是必备的知识点之一。

2010-11-24 上传

2017-11-22 上传

2015-04-08 上传

2020-12-21 上传

2023-09-22 上传

点击了解资源详情

点击了解资源详情

点击了解资源详情

点击了解资源详情

u010323351

- 粉丝: 0

- 资源: 1

最新资源

- 前端协作项目:发布猜图游戏功能与待修复事项

- Spring框架REST服务开发实践指南

- ALU课设实现基础与高级运算功能

- 深入了解STK:C++音频信号处理综合工具套件

- 华中科技大学电信学院软件无线电实验资料汇总

- CGSN数据解析与集成验证工具集:Python和Shell脚本

- Java实现的远程视频会议系统开发教程

- Change-OEM: 用Java修改Windows OEM信息与Logo

- cmnd:文本到远程API的桥接平台开发

- 解决BIOS刷写错误28:PRR.exe的应用与效果

- 深度学习对抗攻击库:adversarial_robustness_toolbox 1.10.0

- Win7系统CP2102驱动下载与安装指南

- 深入理解Java中的函数式编程技巧

- GY-906 MLX90614ESF传感器模块温度采集应用资料

- Adversarial Robustness Toolbox 1.15.1 工具包安装教程

- GNU Radio的供应商中立SDR开发包:gr-sdr介绍