没有合适的资源?快使用搜索试试~ 我知道了~

首页模式识别作业-习题解答+代码.docx

反向传播框架下推导学习规则。总结BP算法。描述自组织算法的计算步骤,给出训练算法的框图。指出卷积神经网络需要计算的权重数量;相对于全连接和非权值共享,所减少的权重数量。编写两个通用的三层前向神经网络反向传播算法程序,一个采用批量方式更新权重,另一个采用单样本方式更新权重。隐含层不同结点数目对训练精度的影响;观察不同的梯度更新步长对训练的影响,并给出一些描述或解释。

资源详情

资源评论

资源推荐

第一部分:计算与证明 :

1.

考虑一个三层网络进行分类,隐藏层中有 个结点,输出层中有 c 个结点。

模式(也称为样本)在 d 维空间中。 隐藏层中结点的激活函数(或传递函数)

为 sigmoid 型函数。 不同地,输出层中的结点将采用以下 softmax 操作作为其激

活函数:

其中, 代表输出层中第 j 个结点的加权和。

(a) 如果每个样本的标准函数是平方误差的和,则在反向传播框架下推导学习规

则,即分析每一层权重的更新方法):

其中, 是输出层中第 个结点处的样本的已知目标值。

解:上标 表示第 个样本:

对第 个样本,隐含层 结点的输入加权和为:

经过激励,隐含层 结点的输出:

#04

输出层 结点的输入加权为:

经过激励,输出层 结点的输出:

单个样本的误差函数:

① 隐含层到输出层的连接权重调整量:

② 输入层到隐含层的连接权重调整量:

(b) 结合课堂所学知识,对反向传播算法进行总结。注意:本题只需要推导出单

1

#04

个样本对权重更新的贡献即可(因为多个样本只是简单地相加)

解:通过观察(a)中的两个式子:

,

更新任意两层之间的连接权重时,权重调整量与更新权重所连接的边的起

始结点的输出和连接的边的指向结点收集到的误差信号的乘积成正比;同时,

误差信号的大小等于:该结点收集到的误差乘以激励函数对“该结点加权和”的

导数。单个训练样本的贡献表示为:

下标 和 分别指“待更新权重”所连接的起始结点和指向结点, 代表起

始结点的实际输出, 表示指向结点的误差(由后一层收集得到)。

2.

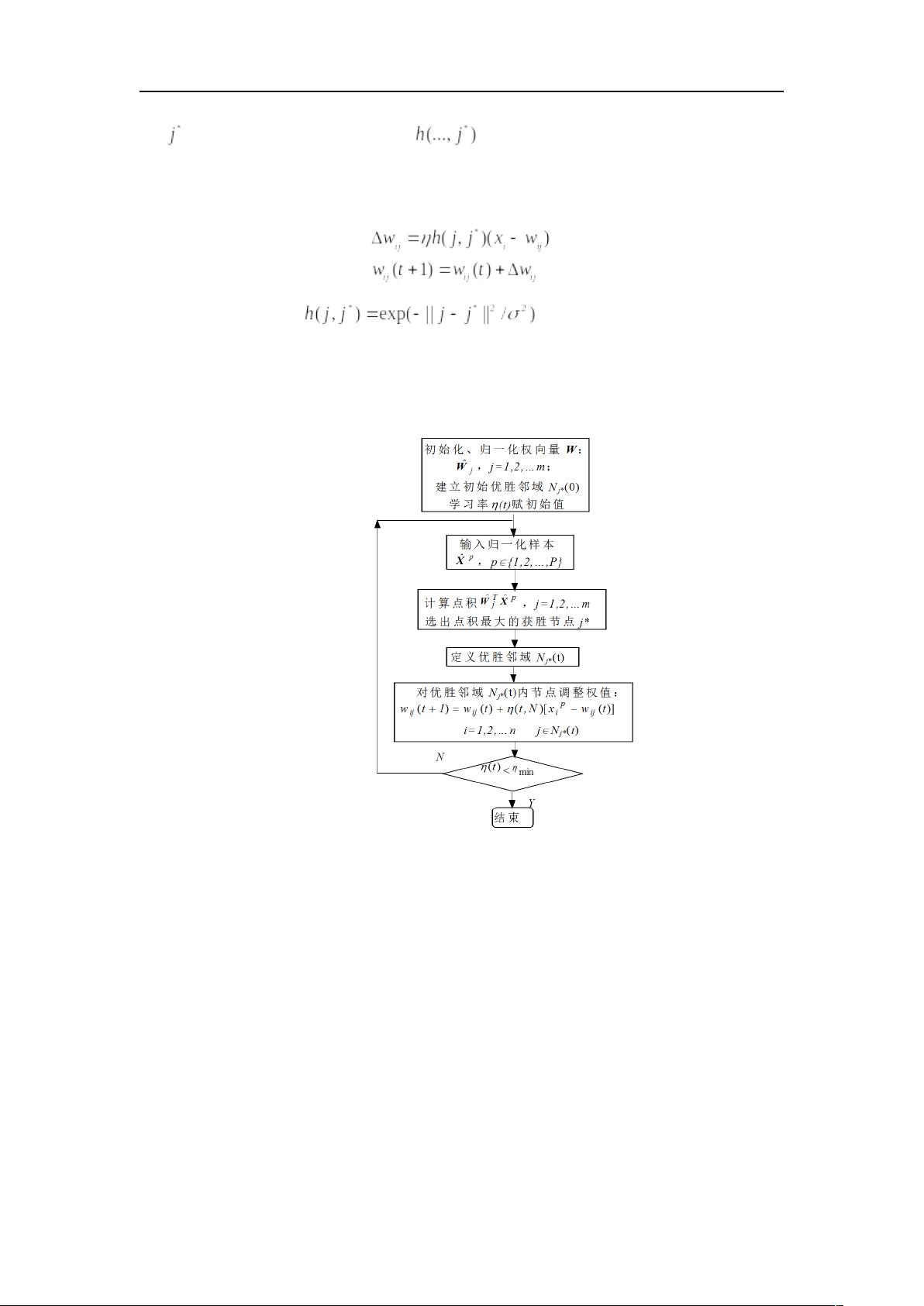

请描述自组织算法的计算步骤,给出训练算法的框图。

(1) 计算步骤:

Step1:网络初始化——通常采用随机初始化方法;

Step2:输入向量;

Step3:计算映射层的权重向量和输入向量的距离:

Step4:计算并选择与权重向量的距离最小的神经元,将其确定为胜出神经

2

#04

元( ),并给出其邻接神经元集合 。

Step5:调整权重。胜出神经元和其邻接神经元的权重,按下式更新:

其中,邻域函数 。

Step6:检查是否达到预先设定的要求。若达到要求则算法结束;否则返回

Step2,进入下一轮学习。

(2) 训练算法框图:

图 1 自组织算法的训练框图

3.

拟考虑对 400×400 大小的图像数据集运用卷积神经网络。假定共有 4 个卷

3

剩余18页未读,继续阅读

爱吃草莓的小团子

- 粉丝: 8

- 资源: 14

上传资源 快速赚钱

我的内容管理

收起

我的内容管理

收起

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

会员权益专享

最新资源

- stc12c5a60s2 例程

- Android通过全局变量传递数据

- c++校园超市商品信息管理系统课程设计说明书(含源代码) (2).pdf

- 建筑供配电系统相关课件.pptx

- 企业管理规章制度及管理模式.doc

- vb打开摄像头.doc

- 云计算-可信计算中认证协议改进方案.pdf

- [详细完整版]单片机编程4.ppt

- c语言常用算法.pdf

- c++经典程序代码大全.pdf

- 单片机数字时钟资料.doc

- 11项目管理前沿1.0.pptx

- 基于ssm的“魅力”繁峙宣传网站的设计与实现论文.doc

- 智慧交通综合解决方案.pptx

- 建筑防潮设计-PowerPointPresentati.pptx

- SPC统计过程控制程序.pptx

资源上传下载、课程学习等过程中有任何疑问或建议,欢迎提出宝贵意见哦~我们会及时处理!

点击此处反馈

安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功

评论0