PRML读书会讲解合集:机器学习深入解析

需积分: 10 194 浏览量

更新于2023-05-16

收藏 12.11MB PDF 举报

"PRML读书会合集打印版.pdf"

PRML(模式识别与机器学习)是一本被广泛赞誉的机器学习领域的经典教材,由一群IT行业的专家和学者共同参与的读书会进行了深入的学习和讨论。这个读书会的目的是通过轮流讲解的方式,帮助参与者理解和掌握书中的核心概念和算法。在这个过程中,他们对每一章的内容进行了详细的准备和讲解,确保内容既严谨又易于理解,部分章节甚至反复讲解,以达到最佳效果。

读书会的参与者包括了西安交通大学的常象宇博士、西北大学的planktonli老师、网神兄(微博名:@豆角茄子麻酱凉面)、戴玮博士和张巍博士,他们在机器学习和人工智能领域有着深厚的学术背景和实践经验。读书会的组织形式独特,采用轮流讲课的方式,并设置了主持人和机动队员,确保了活动的顺利进行。

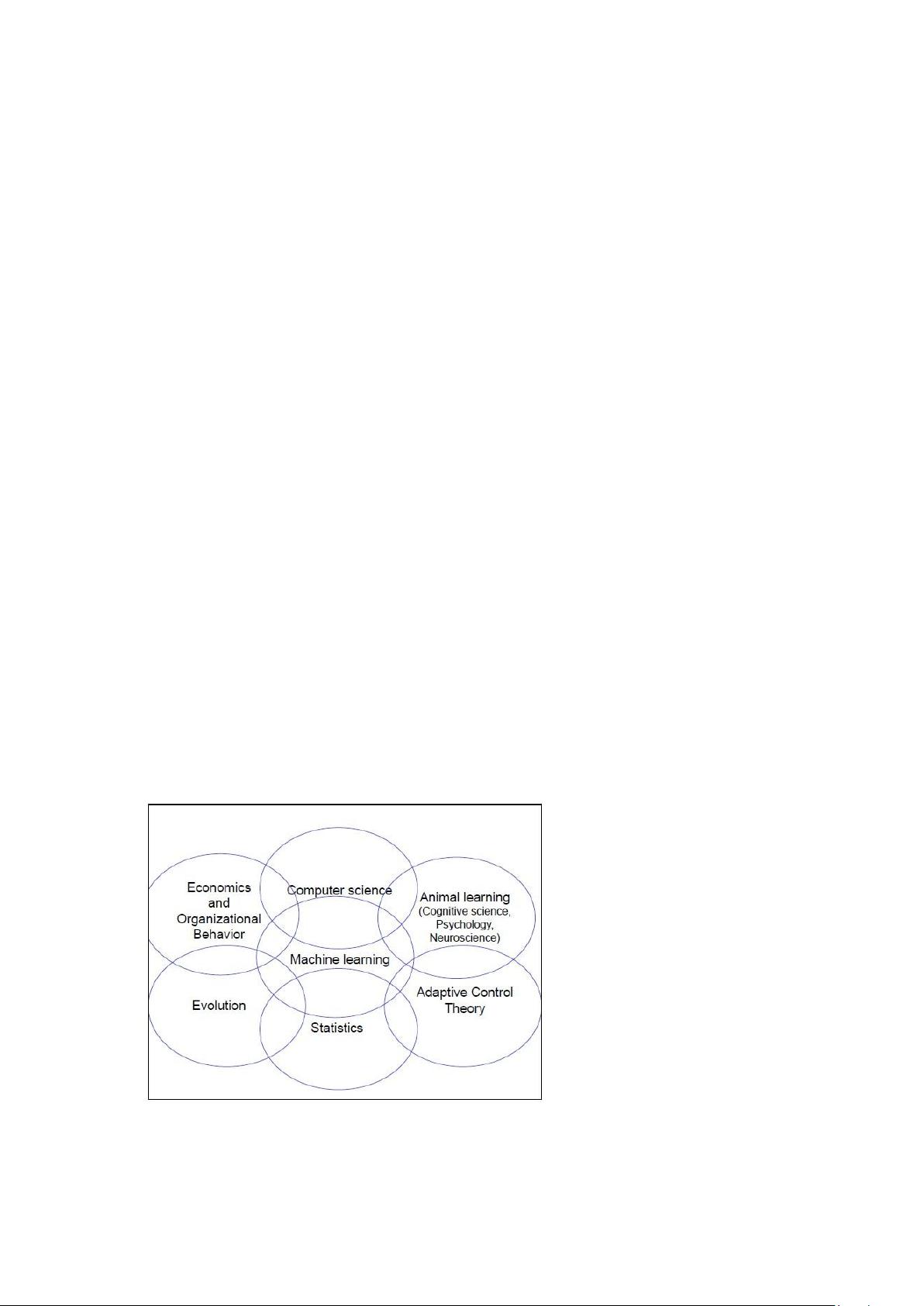

书中涵盖了许多关键主题。第一章由常象宇博士讲解,介绍了机器学习的基本概念、学习理论、模型选择以及维灾难问题。这部分是理解后续章节的基础,帮助读者建立起对机器学习的系统认知。

第二章涉及概率分布,重点讲解了贝塔分布、狄利克雷分布、高斯分布和指数族等基础知识,这些是许多机器学习算法的基础。由于其重要性,这一章的内容被反复讲解,直到满意为止。

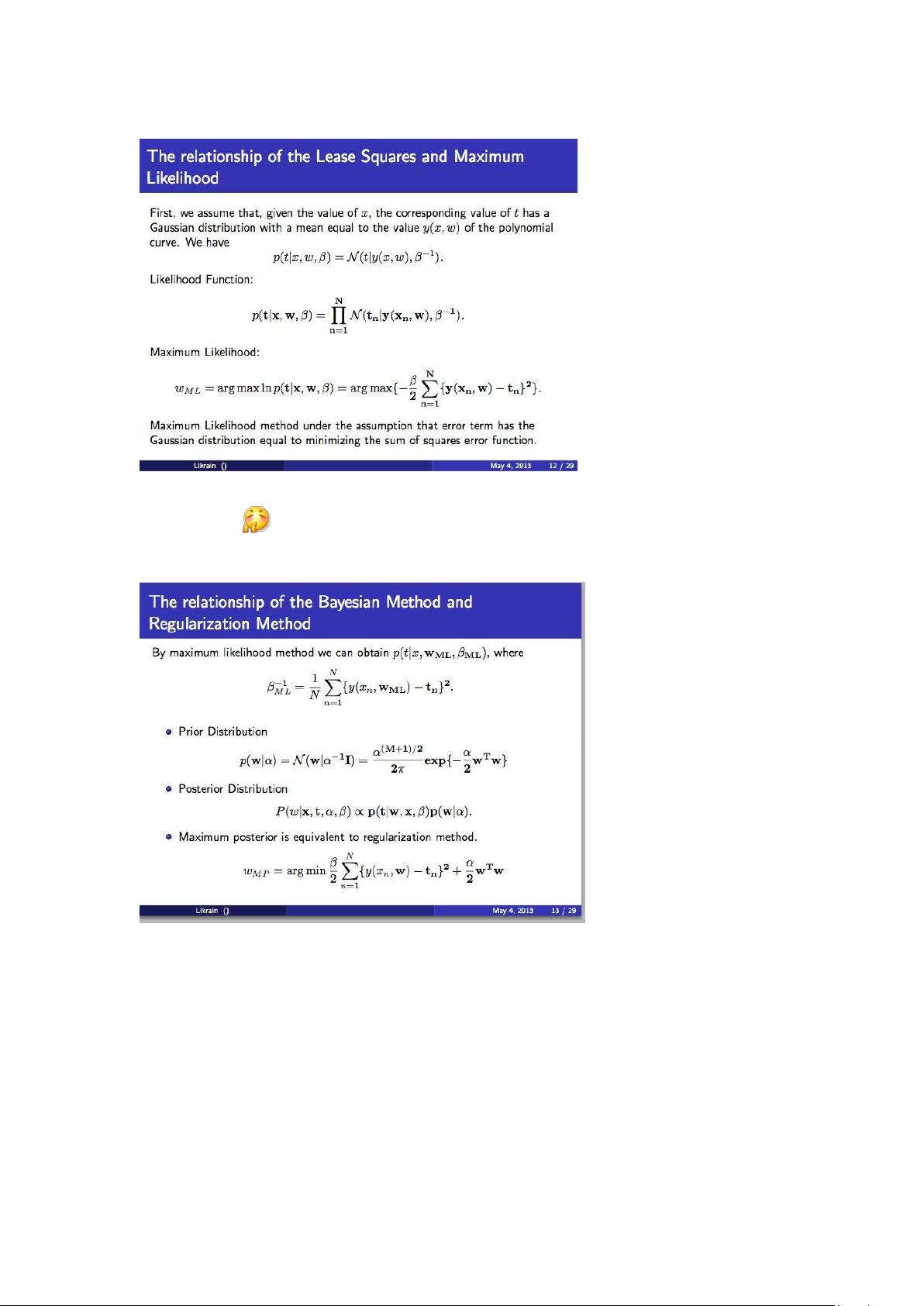

第三章和第四章由planktonli老师负责,分别讨论了回归和分类的线性模型。第三章探讨了线性基函数模型、正则化方法,以及贝叶斯线性回归与核函数的关系,为后续的高级话题奠定了坚实基础。第四章则深入了贝叶斯框架下的分类问题,包括Fisher线性判别、感知机、逻辑回归及其参数估计方法。

第五章由网神讲解神经网络,涵盖了神经网络作为回归和分类工具的训练目标函数、反向传播算法、正则化以及卷积网络等前沿内容,这些都是深度学习的核心组成部分。

第六章探讨了核方法,这是机器学习中一个强大的非线性建模工具,它允许在高维空间中进行复杂的数据分析,而无需直接处理高维数据。

整个读书会的过程不仅深化了参与者的理解,也为读者提供了一份宝贵的学习资料,这份合集记录了他们的研究成果和讨论,对于那些希望深入理解PRML这本书的读者来说,无疑是一份极具价值的学习资源。

2018-11-09 上传

2016-01-03 上传

2021-09-18 上传

2018-06-21 上传

2020-01-03 上传

2021-12-01 上传

weixin_43753316

- 粉丝: 0

- 资源: 7

最新资源

- TwitchAdBlock:在twitch.tv上阻止流式嵌入式广告

- 3x5-led-display:用于生日“卡”的非常简单的arduino代码,其中包括3x5的led阵列,它们会闪烁“生日快乐”

- cr6community.github.io:CR-6社区网站和知识库

- goodgame-empire-api

- gatsby-wp:用于 WordPress 的 GatsbyJS 样板

- Three.JS-Webpack-Boilerplate-v4:设置用于开发与Webpack一起运行的Three.JS站点的环境

- react-test-jest-enzyme:通过React,Redux,Hooks和上下文代码以及测试驱动开发提高技能

- 参考资料-基于51单片机的泵控马达恒速控制.zip

- durga:分布式p2p对象数据库

- SingleClick Cleaner-crx插件

- boom:整理网页并提高可读性

- 基于java的开发源码-mina高性能Java网络框架.zip

- pytorch-resnet-mnist:https

- ride-my-way:拼车应用程序,使驾驶员能够创建乘车要约,乘客可以加入可用的乘车要约

- MS4-handlettering-art-full-stack-website:https:ms4-lettering-design-e-shop.herokuapp.com

- Pytorch-LSGAN-MNIST:LSGAN的Pytorch实现用于生成MNIST图像