没有合适的资源?快使用搜索试试~ 我知道了~

首页基于Hive的搜狗日志分析

基于Hive的搜狗日志分析

需积分: 31 31 下载量 37 浏览量

更新于2023-05-28

评论 3

收藏 1.47MB DOCX 举报

这是我的一份课程作业,需要事先下载搜狗日志文件。有问题,可以问百度。里面也参考了其他博客主的文章,在最后有相关链接。

资源详情

资源评论

资源推荐

《基于 Hive 的搜狗搜索日志分析报告》

目录

一、 数据预处理...................................................................................................................................1

1.1 数据查看...................................................................................................................................1

1.2 数据扩展和过滤.......................................................................................................................3

1.3 数据加载...................................................................................................................................4

二、 基于 Hive 构建数据仓库.............................................................................................................7

2.1 创建数据仓库...........................................................................................................................7

2.2 随机抽样创建含有 200w 样本的外部数据表.........................................................................9

2.3 创建分区表.............................................................................................................................10

三、 数据分析.....................................................................................................................................12

3.1 条数统计.................................................................................................................................12

3.2 关键词分析.............................................................................................................................15

3.3UID 分析..................................................................................................................................20

3.4 用户行为分析.........................................................................................................................23

3.5 创建实时数据表.....................................................................................................................27

四、 其他数据操作.............................................................................................................................28

4.1 使用 Sqoop 将数据导入 MySQL..........................................................................................28

4.2 使用 Sqoop 将数据导入 HBase.............................................................................................31

4.3Mahout 聚类操作.....................................................................................................................33

4.5 使用 Mahout 对关键字进行聚类...........................................................................................36

五、 总结.............................................................................................................................................42

一、 数据预处理

1.1 数据查看

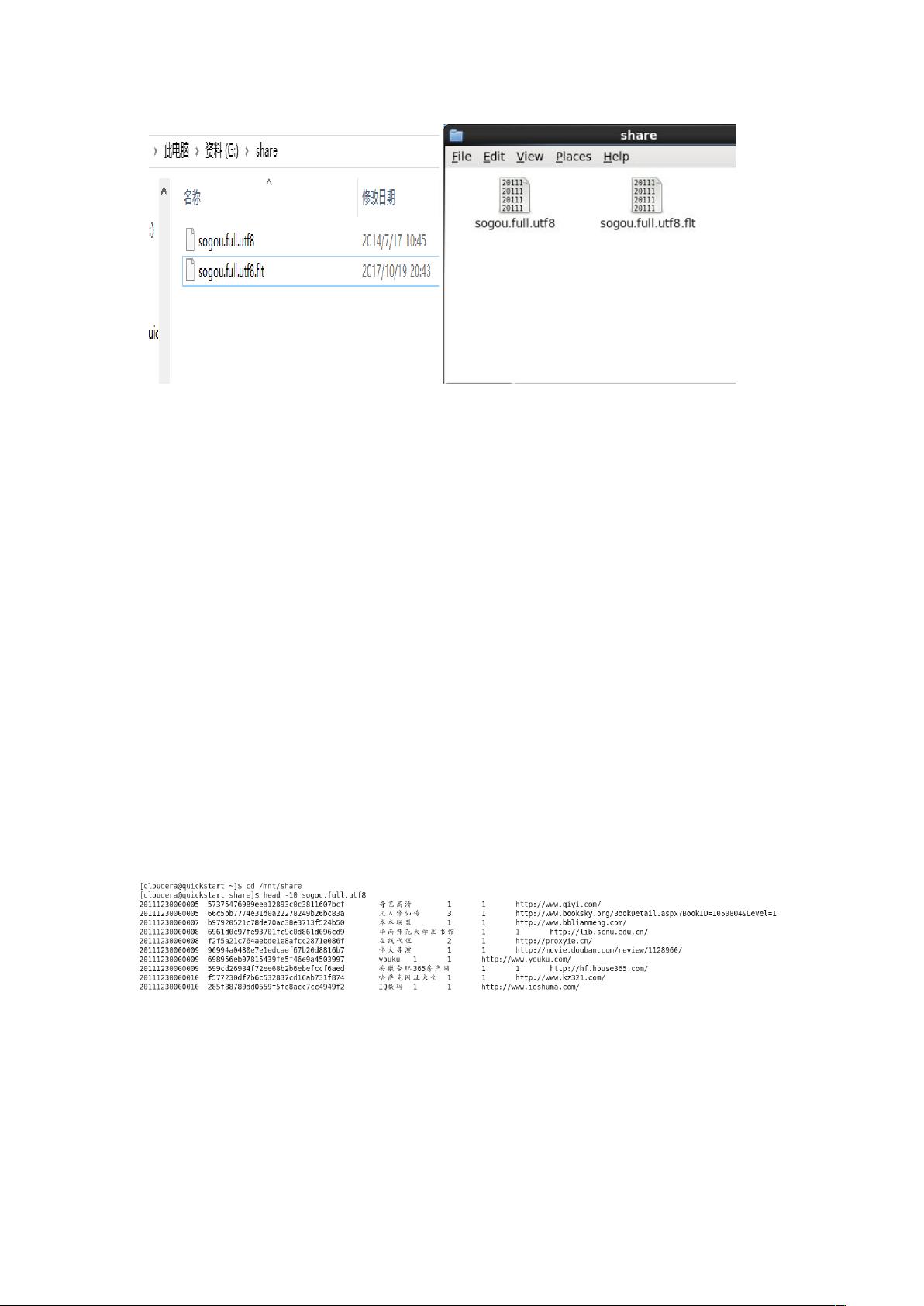

1.数据共享

源数据存放在 windows 系统的 G 盘的 share 文件夹中,可以在 Linux 系统中

使用共享文件夹的功能来共享数据。首先进入 root 根目录下执行 Linux 命令,

如下图所示:su root 命令进入根目录,密码是 cloudera。

然后虚拟机安装增强功能,在主机上固定分配一个文件夹作为共享文件夹,

即 G://share。在 Linux 系统中新建一个文件夹/mnt/share,用来作为共享的文件

夹。 执 行命 令 共享文 件夹: mount -t vboxsf share /mnt/share ,打开 Linux 下

的/mnt/share 文件夹发现文件已经实现共享。这里只使用了临时共享的命令,如

果想要永久共享,请自行百度。初始文件只有 sogou.full.utf8,sogou.full.utf8.flt

文件是数据扩展和过滤后的文件,数据扩展和过滤会在下文介绍。

1

2.查看数据

在 Linux 环境下查看数据。使用快捷键 ctrl+d,回到 hadoop 环境,执行

cd /mnt/share,进入源数据文件夹下执行命令:head -10 sogou.full.utf8,查看数

据的前十条。如下图所示,搜狗数据的格式为:访问时间、用户 ID 、[查询词]、

该 URL 在返回结果中的排名、用户点击的顺序号、用户点击的 URL。其中,

用户 ID 是根据用户使用浏览器访问搜索引擎时的 Cookie 信息自动赋值,即同

一次使用浏览器输入的不同查询对应同一个用户 ID。

如果数据中的中文显示乱码,请先检查 Linux 系统是否安装中文语言包,

如未安装,在联网环境下执行命令:yum groupinstall chinese-support,安装中文

2

语言包,重启虚拟机或重启命令框后重新查看数据。

查看数据行数,执行命令:wc –l sogou.full.utf8,一共有 4 千多万条数据。

具体的数据分析会在下文介绍。

1.2 数据扩展和过滤

源数据中数据的访问时间是形如 20111230000007 的字符串型,为了分析数

据需要将其分割成 2011、11、23、00,分别是年、月、日、时。在 Linux 环境

下可以使用 awk 命令实现。awk 是一个强大的文本分析工具,相对于 grep 的查

找,sed 的编辑,awk 在其对数据分析并生成报告时,显得尤为强大。简单来说

awk 就是把文件逐行的读入,以空格为默认分隔符将每行切片,切开的部分再

进行各种分析处理。对源数据进行拓展,将时间字段拆分并拼接,添加年、月、

日、小时字段,执行命令:

awk -F '\t' '{print $0"\t"substr($1,1,4)"\t"substr($1,5,2)"\t"substr($1,7,2)"\t"substr($1,9,2)}'

sogou.full.utf8 > sogou.full.ext,数据量比较大,运行需要一段时间,可以一边等一边做些其

他的事情。数据扩展结果如下图所示:

3

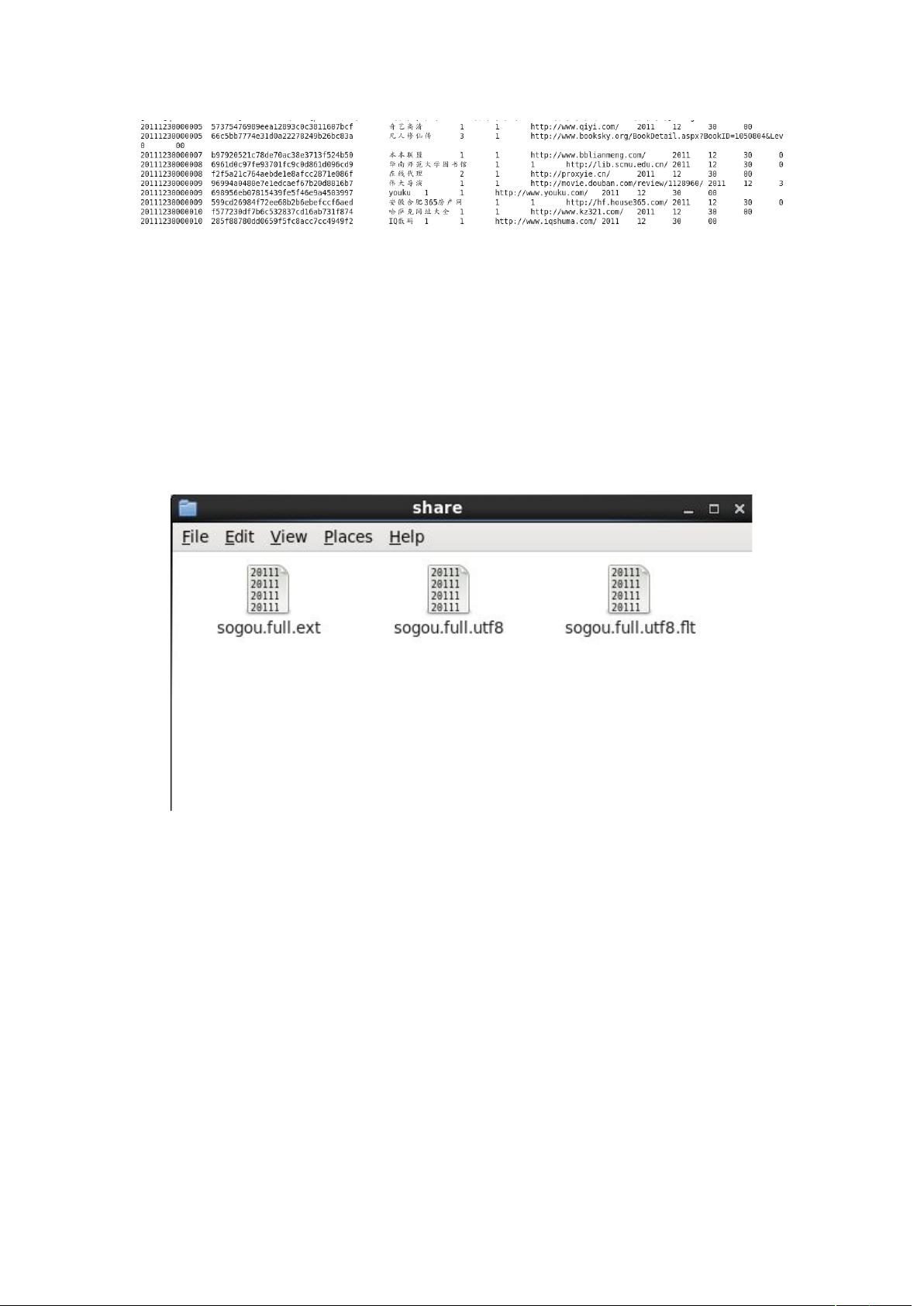

数据扩展之后及进行数据过滤,过滤第 2 个字段(UID)或者第 3 个字段

(搜索关键词)为空的行(需要用第 2 步数据扩展的结果)执行命令:awk -F

"\t" '{if($2 != "" && $3 != "" && $2 != " " && $3 != " ") print $0}' sogou.full.ext >

sogou.full.utf8.flt,如下图所示,最后文件夹中会有三个文件:

1.3 数据加载

接下来将数据加载到 HDFS 上面。首先要在 HDFS 上新建一个文件夹存放

加载的数据,这里直接将过滤后的文件 sogou.full.utf8.flt 加载到 HDFS 上。新建

文件夹,执行命令:hdfs dfs -mkdir -p /sogou/20171026。数据加载执行命令:

4

剩余43页未读,继续阅读

战战兢兢

- 粉丝: 6

- 资源: 3

上传资源 快速赚钱

我的内容管理

收起

我的内容管理

收起

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

会员权益专享

最新资源

- RTL8188FU-Linux-v5.7.4.2-36687.20200602.tar(20765).gz

- c++校园超市商品信息管理系统课程设计说明书(含源代码) (2).pdf

- 建筑供配电系统相关课件.pptx

- 企业管理规章制度及管理模式.doc

- vb打开摄像头.doc

- 云计算-可信计算中认证协议改进方案.pdf

- [详细完整版]单片机编程4.ppt

- c语言常用算法.pdf

- c++经典程序代码大全.pdf

- 单片机数字时钟资料.doc

- 11项目管理前沿1.0.pptx

- 基于ssm的“魅力”繁峙宣传网站的设计与实现论文.doc

- 智慧交通综合解决方案.pptx

- 建筑防潮设计-PowerPointPresentati.pptx

- SPC统计过程控制程序.pptx

- SPC统计方法基础知识.pptx

资源上传下载、课程学习等过程中有任何疑问或建议,欢迎提出宝贵意见哦~我们会及时处理!

点击此处反馈

安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功

评论0