人工智能驱动的课堂行为识别:融合姿态估计与目标检测提升教学效率

版权申诉

本研究聚焦于"融合人体姿态估计和目标检测的学生课堂行为识别"这一主题,主要背景是随着教育领域的数字化转型,学习分析技术在提高教育质量和教学效果中扮演了关键角色。传统的课堂行为评估方式效率低下,而人工智能的发展提供了新的可能,即通过计算机视觉技术自动分析学生的行为模式,以提升教育的智能化水平。

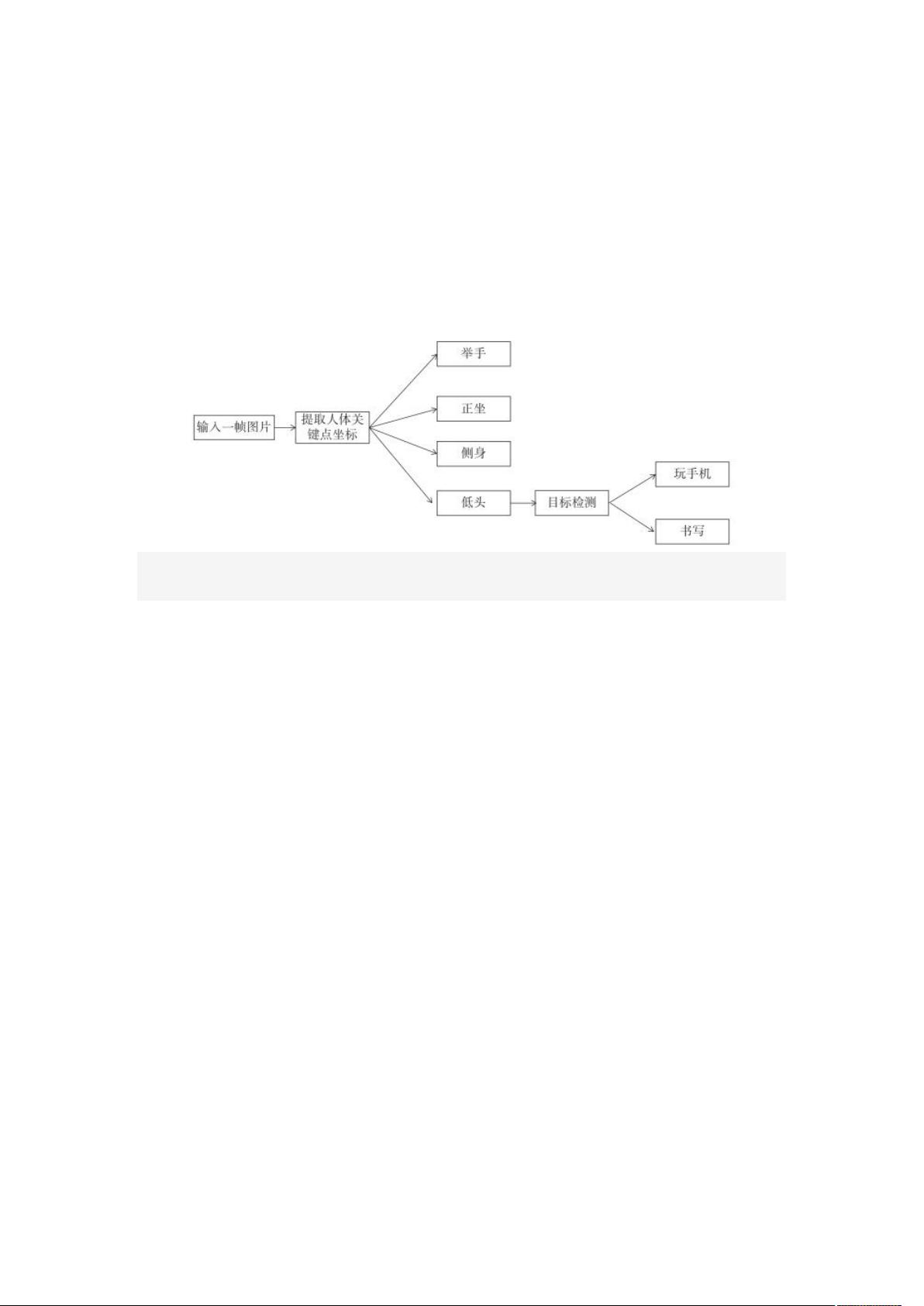

研究者针对课堂环境中的学生行为识别提出了多阶段的方法。首先,利用OpenPose人体关键点检测算法处理视频数据,通过提取学生的关键点信息,构建姿态分类器,可以精确识别出学生低头、正坐、侧身和举手等基本行为。这些行为反映了学生的基本注意力集中程度。

然而,由于课堂环境中存在遮挡和行为多样性,如玩手机和书写等,这些问题对行为识别提出了挑战。针对手机和书写行为,文章强调了手部区域的重要性,因为这两种行为的手部动作特征与骨骼关键点关联度不高。因此,研究者采用模型剪枝的YOLOv3算法加速手部检测,并结合人体姿态信息,构建级联分类网络,实现了这两种行为的实时检测。

文献综述部分提到,人体行为根据复杂程度可分为姿态、个体动作、交互动作和团体活动四类。姿态是最基础的移动,如举手、站立,个体动作则是多个姿态的组合,比如跑步或跳高。交互动作则涉及到人与人、人与物之间的互动,如学生使用手机或者书写,这些行为识别需要更精细的技术处理。

本文的创新之处在于通过深度学习方法,结合多模态信息,不仅提高了学生课堂行为的识别精度,还实现了实时性,这对于教育数据分析和个性化教学有着实际应用价值。通过对真实课堂视频数据的实验验证,研究证明了所提方法的有效性和实用性,有望推动未来教育领域对学生课堂行为的深入理解和精准管理。

点击了解资源详情

点击了解资源详情

点击了解资源详情

2023-02-23 上传

2022-11-03 上传

2022-11-19 上传

2022-11-12 上传

罗伯特之技术屋

- 粉丝: 4452

- 资源: 1万+

最新资源

- JSON check, Mac OS X json check tool, 苹果桌面操作系统 json 文本格式检测和编辑工具

- MythStreamTV-开源

- oplss-15-notes:GitBook提供有关OPLSS15程序的注释

- dad_latex_

- JAVA网络通信系统的研究与开发(源代码+论文+开题报告).rar

- 基于C++实现的药房管理系统(源码+课设+截图)

- html5-canvas-2d-grid-layout:一个简单的网格模型系统,用于在HTML画布中绘制形状-开源

- Multiconvert-开源

- AD元件库3D模型开关.zip

- KaTeX-jq:小巧的 jQuery KaTeX 插件

- FastPHPWeb:用PHP扩展Web服务器的快速方法

- Cours Optim1_Genetic-algorithm_

- NorthNotch Software Widgets Library:窗口小部件库包含WinAPI的GUI窗口小部件的c ++类。-开源

- 行业文档-设计装置-教学多用三角板.zip

- mapgis6.7及电子狗,考古专用

- 基于C++和Python的O-CNN论文代码设计源码