基于TVM的AI模型在寒武纪芯片上的适配与优化

需积分: 0 85 浏览量

更新于2024-06-30

收藏 1.71MB DOCX 举报

"这篇毕业论文主要探讨了基于TVM的人工智能模型适配系统的设计与实现,重点关注在寒武纪思元芯片上的应用。作者刘杭达通过改进TVM,实现了深度学习模型到BANG C代码的自动化转换,以适应MLU270芯片,减少了人工转换的工作量,并进行了性能测试与比较。"

正文:

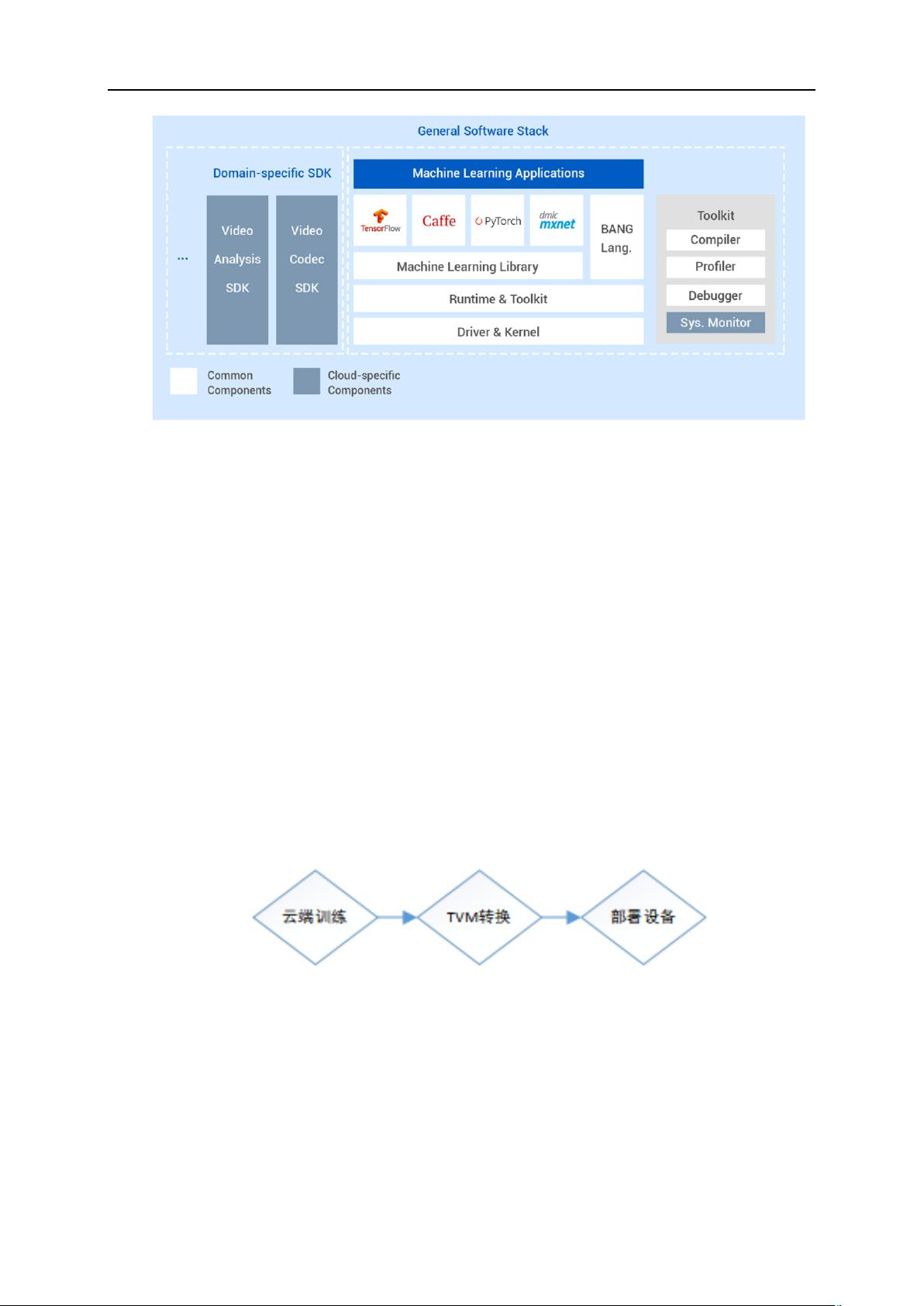

本文的研究核心在于解决人工智能模型在国产深度学习处理器——寒武纪思元芯片上的适配问题。TVM(TensorVirtualMachine)是一个开源的深度学习编译框架,它提供了一种端到端的优化方法,能够跨多个硬件平台高效部署深度学习模型。寒武纪思元芯片作为专用的深度学习处理器,具有高性能和低功耗的特点,但在模型部署时,由于硬件平台的多样性,往往需要进行复杂的模型转换与适配。

论文首先介绍了TVM和寒武纪思元芯片的基础知识,包括它们在人工智能领域的角色和重要性。TVM通过其低级中间表示(TIR)模型,允许开发者优化模型以适应特定硬件。而寒武纪思元芯片则为AI计算提供了专门的硬件加速能力。

在需求分析后,论文提出了一个包含三个关键功能模块的系统架构:生成MLU模型、唤醒MLU设备和转换BANG C代码。BANG C是一种针对寒武纪芯片的编程语言,用于实现高效的硬件计算。通过改进TVM,论文实现了将TIR模型优化并转换为BANG C代码,从而使得模型可以直接在MLU270芯片上运行。

实施过程中,作者阅读了TVM的源代码,理解了其内部机制,并参考了寒武纪的相关研究,以确保模型转换的准确性和效率。通过编写设备配置文件和代码生成器,自动化流程大大简化了模型适配的过程。

在测试阶段,以矩阵运算为例,作者比较了自动优化生成的MLU模型与手动编写的BANG C代码在MLU270上的运行效果。结果表明,自动优化不仅提高了模型部署的效率,而且保证了模型在硬件上的正确运行,降低了开发成本。

总结来说,这篇论文的贡献在于提出了一套针对寒武纪思元芯片的智能模型适配解决方案,通过TVM的优化与自动化转换,提升了模型在边缘计算设备上的部署速度和运行效率。这一成果对于未来更多国产深度学习芯片的适配工作具有重要的参考价值,也为实际边缘智能计算应用提供了有效的优化策略。

2022-08-08 上传

2022-08-08 上传

2024-11-26 上传

2024-11-26 上传

2024-11-26 上传

2024-11-26 上传

Period熹微

- 粉丝: 30

- 资源: 307

最新资源

- JHU荣誉单变量微积分课程教案介绍

- Naruto爱好者必备CLI测试应用

- Android应用显示Ignaz-Taschner-Gymnasium取消课程概览

- ASP学生信息档案管理系统毕业设计及完整源码

- Java商城源码解析:酒店管理系统快速开发指南

- 构建可解析文本框:.NET 3.5中实现文本解析与验证

- Java语言打造任天堂红白机模拟器—nes4j解析

- 基于Hadoop和Hive的网络流量分析工具介绍

- Unity实现帝国象棋:从游戏到复刻

- WordPress文档嵌入插件:无需浏览器插件即可上传和显示文档

- Android开源项目精选:优秀项目篇

- 黑色设计商务酷站模板 - 网站构建新选择

- Rollup插件去除JS文件横幅:横扫许可证头

- AngularDart中Hammock服务的使用与REST API集成

- 开源AVR编程器:高效、低成本的微控制器编程解决方案

- Anya Keller 图片组合的开发部署记录