Spark数据倾斜解决方案:优化策略与实战

113 浏览量

更新于2024-08-29

收藏 3.48MB PDF 举报

"本文主要探讨了Spark数据倾斜的问题,包括其定义、原因和解决策略。数据倾斜是指在并行处理的数据集中,某些分区的数据量远超其他分区,导致处理速度严重不平衡,成为性能瓶颈。文章指出,数据倾斜往往源于Stage内部Task处理数据量的不均等,以及数据源本身的分布问题。对于如何缓解或消除数据倾斜,文章提到了从源头避免数据倾斜,例如在使用Kafka作为数据源时,确保Producer使用合理的Partitioner来保证数据平衡。"

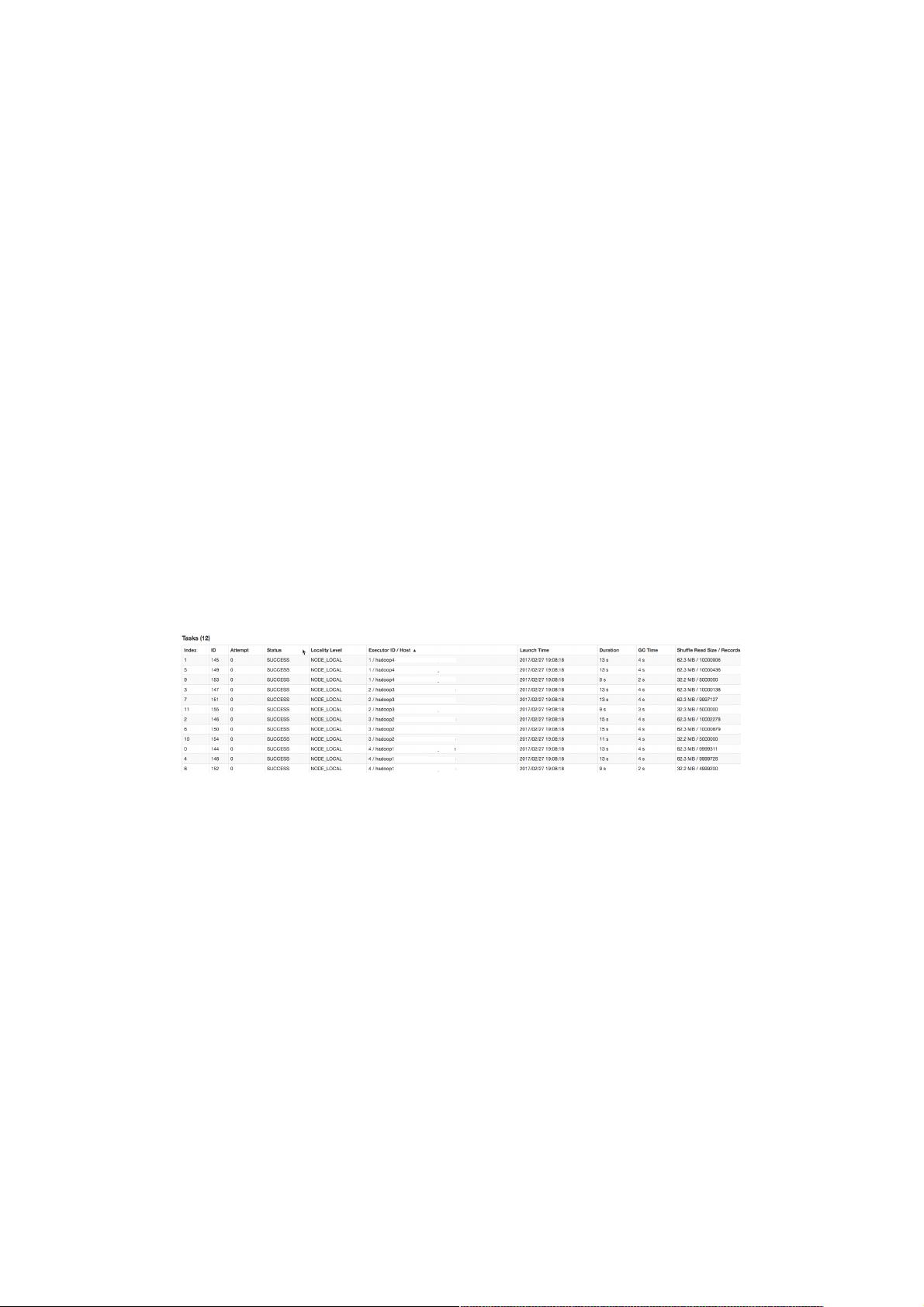

在Spark作业中,数据倾斜是一个严重的性能问题,它会导致部分Task处理时间过长,从而影响整个Stage乃至Job的执行效率。这种情况通常是由于数据在分区(Partition)间的分布不均匀造成,比如某个Partition承载的数据量过大,使得处理这个Partition的Task耗时过长。Spark的并行处理机制决定了一个Stage中耗时最长的Task将决定该Stage的总体执行时间。

造成数据倾斜的原因主要有两方面:

1. 数据源本身的分布不均:例如,当从HDFS或Kafka读取数据时,如果数据在这些存储系统的分区之间分布不均,那么Spark在读取时也会遇到类似问题。特别是对于Kafka,每个Partition对应Spark的一个Task,因此Kafka Partition的均衡至关重要。

2. Shuffle操作后的数据分布:Spark作业中,Shuffle操作可能导致数据重新分配到新的Partition,如果这个过程没有做好,可能会加剧数据倾斜。

解决数据倾斜的方法主要包括:

1. 预处理数据:在数据加载到Spark之前,可以先在数据源端进行预处理,例如,通过哈希或范围分区等方式确保数据相对均匀地分布在各个分区。

2. 调整Partition数量:增加Partition数量可以降低单个Partition的数据量,但过多的Partition会增加任务调度的开销,因此需要找到合适的平衡点。

3. 使用自定义Partitioner:根据业务需求定制Partitioner,确保数据按照特定规则分布,减少倾斜可能性。

4. 处理倾斜键:对于特定的关键值(key)导致的倾斜,可以采用采样、聚合小文件、动态调整Partition大小等方法来处理。

5. 使用Spark的Coalesce或Repartition操作:在不影响作业逻辑的前提下,适当时候可以使用这两个操作来优化数据分布。

在实际应用中,需要结合业务需求和集群资源情况,综合运用上述方法来有效解决Spark的数据倾斜问题。同时,监控和日志分析也是发现和诊断数据倾斜的重要手段,通过监控任务执行时间和数据分布,可以及时发现并调整作业参数,优化性能。

268 浏览量

316 浏览量

270 浏览量

154 浏览量

268 浏览量

146 浏览量

270 浏览量

290 浏览量

点击了解资源详情

weixin_38579899

- 粉丝: 2

最新资源

- HTC G22刷机教程:掌握底包刷入及第三方ROM安装

- JAVA天天动听1.4版:证书加持的移动音乐播放器

- 掌握Swift开发:实现Keynote魔术移动动画效果

- VB+ACCESS音像管理系统源代码及系统操作教程

- Android Nanodegree项目6:Sunshine-Wear应用开发

- Gson解析json与网络图片加载实践教程

- 虚拟机清理神器vmclean软件:解决安装失败难题

- React打造MyHome-Web:公寓管理Web应用

- LVD 2006/95/EC指令及其应用指南解析

- PHP+MYSQL技术构建的完整门户网站源码

- 轻松编程:12864液晶取模工具使用指南

- 南邮离散数学实验源码分享与学习心得

- qq空间触屏版网站模板:跨平台技术项目源码大全

- Twitter-Contest-Bot:自动化参加推文竞赛的Java机器人

- 快速上手SpringBoot后端开发环境搭建指南

- C#项目中生成Font Awesome Unicode的代码仓库