卷积神经网络(CNN)原理与应用

需积分: 0 128 浏览量

更新于2024-08-05

收藏 437KB PDF 举报

"卷积神经网络1"

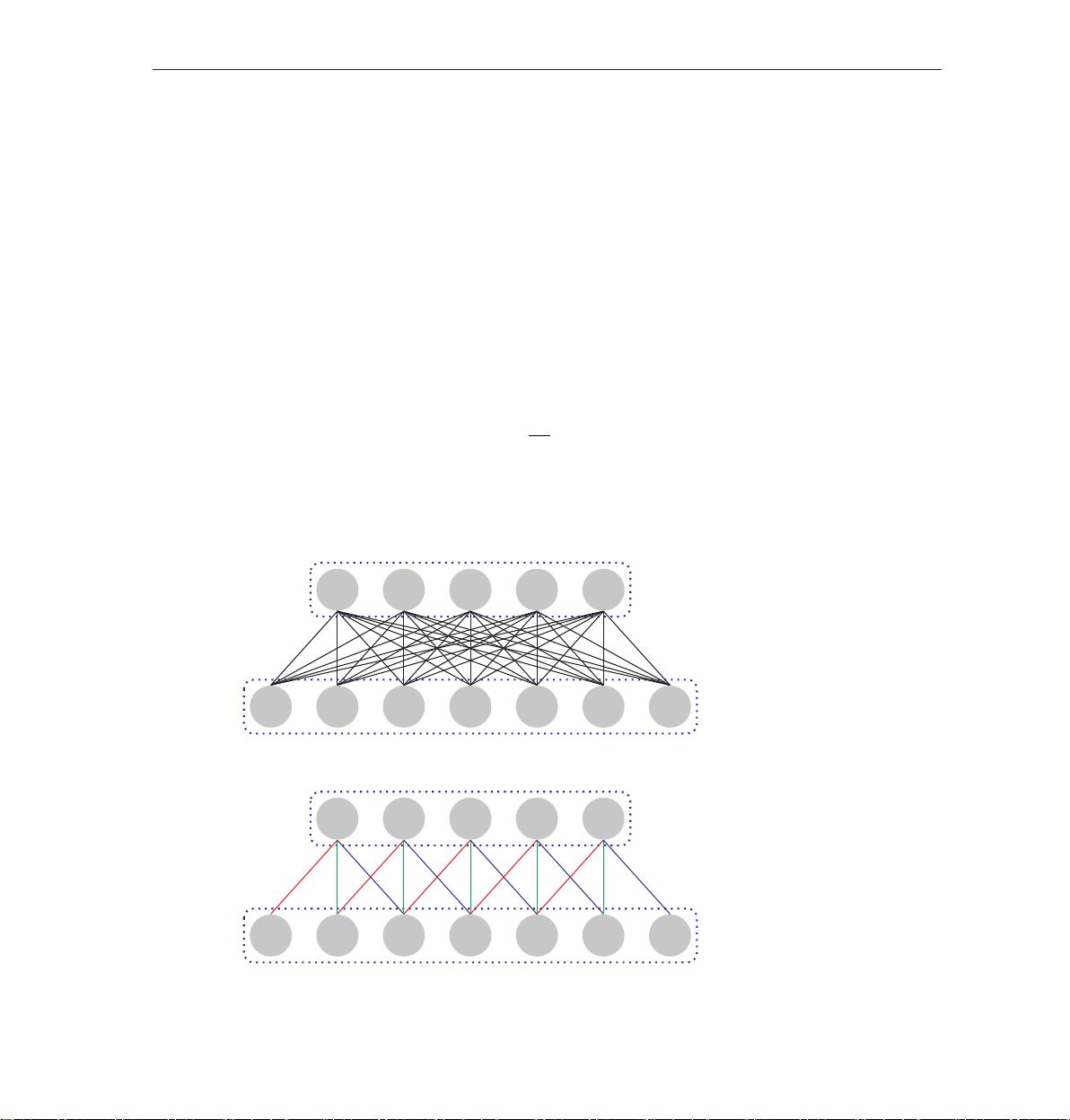

卷积神经网络(CNN)是深度学习领域用于图像处理的关键模型,它解决了传统全连接前馈神经网络在处理图像时的两大问题。首先,CNN通过引入卷积层避免了参数爆炸。在全连接网络中,如果输入图像较大,如100×100×3,每个隐藏层神经元都需要与所有输入像素相连,导致大量参数。这不仅使网络训练变得极其缓慢,还容易引发过拟合。而在CNN中,卷积层的神经元只与其感受野内的输入像素相连,大大减少了所需的参数数量。

其次,CNN通过卷积层和池化层自然地处理图像的不变性。卷积层的神经元感受野对应于图像的一部分,可以检测特定的特征,如边缘、颜色或纹理,而不关心这些特征在图像中的精确位置。这模拟了生物视觉系统中的局部不变性,使得网络对图像的平移、缩放和旋转具有一定的鲁棒性。此外,池化层进一步降低了对位置的依赖,通过下采样减少了计算量并增强了模型的泛化能力。

CNN的结构通常包括卷积层、激活函数(如ReLU)、池化层、归一化层以及全连接层。卷积层通过共享权重的滤波器(或卷积核)对输入图像进行扫描,生成特征图。滤波器在图像上滑动,其每个位置的输出称为特征映射,反映了输入图像在该位置的特定特征。滤波器的权重在训练过程中更新,以优化对特定任务的性能。

池化层则通过采样技术(如最大池化或平均池化)减小特征图的尺寸,保持关键特征的同时减少计算负担。归一化层如局部响应归一化或批量归一化,有助于加速训练过程并提高模型的稳定性。

新知机(Neocognitron)是Kunihiko Fukushima在1980年提出的早期CNN模型,它是受到生物视觉系统中简单细胞和复杂细胞概念的启发。简单细胞对特定方向的边缘敏感,而复杂细胞则对运动的方向敏感。这种层次化的结构使得新知机能够逐步提取图像的复杂特征,尽管当时没有反向传播算法,但这一概念为后续的CNN发展奠定了基础。

随着时间的推移,CNN在图像分类、目标检测、语义分割等任务中取得了显著的成功,并在计算机视觉领域成为主流模型。如今的深度CNN往往结合残差网络、注意力机制等创新结构,进一步提升了模型的性能和效率。

2023-07-26 上传

2019-05-09 上传

2021-09-16 上传

2022-08-03 上传

2022-08-03 上传

2022-08-03 上传

2023-07-26 上传

2019-05-09 上传

2021-09-16 上传

文润观书

- 粉丝: 31

- 资源: 317

最新资源

- IEEE 14总线系统Simulink模型开发指南与案例研究

- STLinkV2.J16.S4固件更新与应用指南

- Java并发处理的实用示例分析

- Linux下简化部署与日志查看的Shell脚本工具

- Maven增量编译技术详解及应用示例

- MyEclipse 2021.5.24a最新版本发布

- Indore探索前端代码库使用指南与开发环境搭建

- 电子技术基础数字部分PPT课件第六版康华光

- MySQL 8.0.25版本可视化安装包详细介绍

- 易语言实现主流搜索引擎快速集成

- 使用asyncio-sse包装器实现服务器事件推送简易指南

- Java高级开发工程师面试要点总结

- R语言项目ClearningData-Proj1的数据处理

- VFP成本费用计算系统源码及论文全面解析

- Qt5与C++打造书籍管理系统教程

- React 应用入门:开发、测试及生产部署教程