深度学习理论基础解析:从神经网络到梯度下降

需积分: 10 138 浏览量

更新于2024-07-10

收藏 2.64MB PDF 举报

"深度学习理论基础.pdf"

深度学习作为人工智能领域的一个关键分支,其理论基础主要涉及计算能力、大数据以及特定的算法,特别是人工神经网络。在这个理论框架中,深度学习可以比喻为汽车,其中算法是汽车的引擎,指的是深度学习的核心——深度神经网络;大数据则是汽车的燃料,为模型训练提供必要的数据输入;而计算力则相当于汽车的轮子,包括CPU、GPU、TPU等硬件设备,它们加速了模型的训练和推理过程。

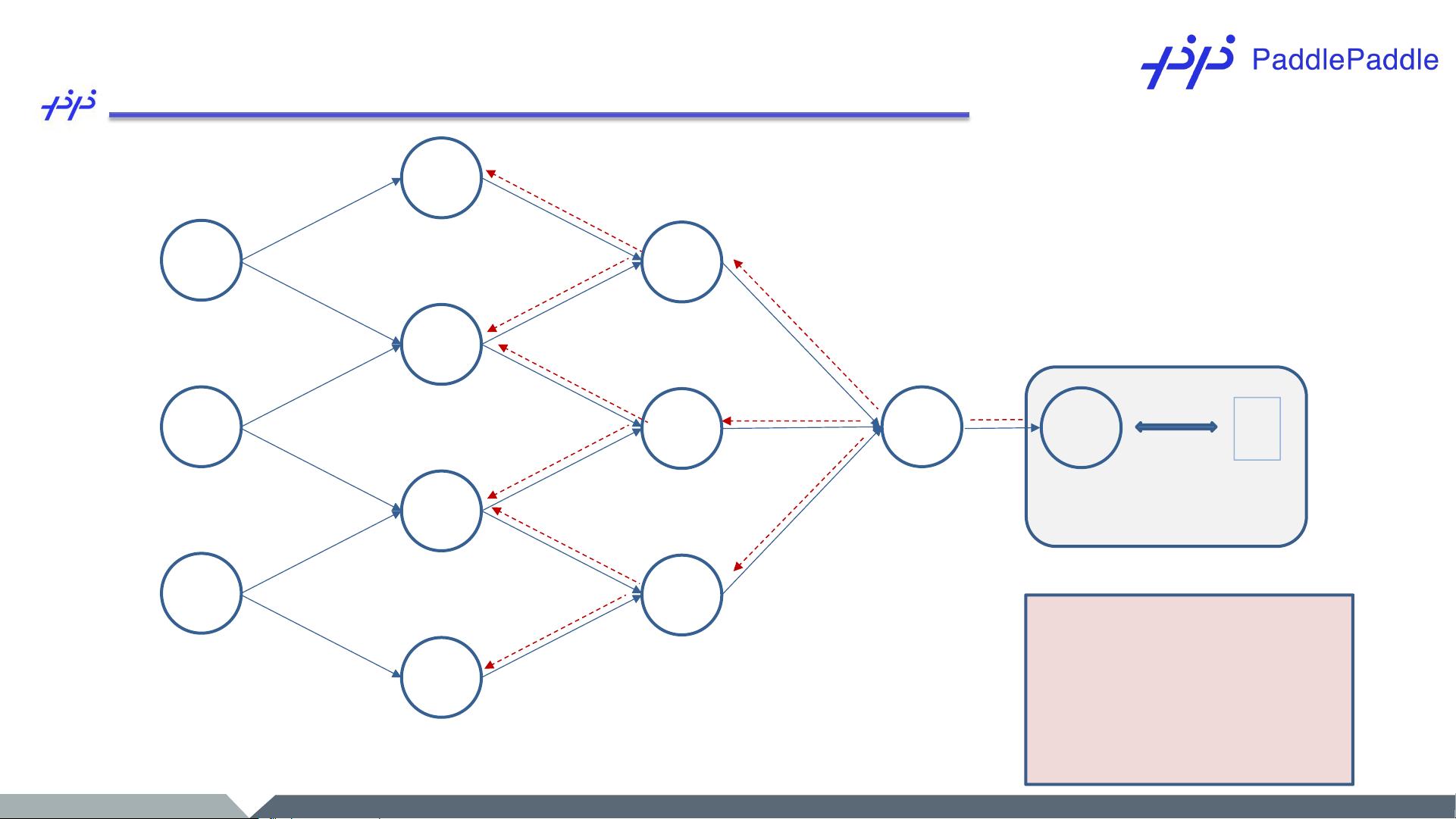

人工神经网络(ANN)是深度学习的基础,灵感来源于生物神经网络。神经网络由许多个简单的单元,即神经元或感知机组成。单个感知机是最简单的神经网络形式,它接收输入信号并产生输出。通过将多个感知机层层堆叠,就形成了多层感知机模型,也即深度神经网络。这些网络通常包含输入层、隐藏层和输出层,其中每个神经元都与下一层的所有神经元完全连接,这种结构称为全连接层。

在训练神经网络时,主要有三个关键步骤:正向传播、反向传播和梯度下降。正向传播是指从输入数据开始,通过网络的各层计算直至得出预测输出的过程。计算图是一种直观表示计算过程的方法,它将变量和运算关系可视化,帮助理解神经网络的运行机制。

反向传播是训练过程中计算损失并优化权重的过程。它利用链式法则计算损失函数对网络参数的偏导数,以便进行梯度下降。梯度下降是优化算法,用于调整网络的权重和偏置,使其在损失函数上达到最低点。这一过程中,学习率是一个重要的超参数,它控制着参数更新的速度。梯度下降有多种变体,如批量梯度下降、随机梯度下降和小批量梯度下降,分别对应不同的数据采样策略。

在神经网络中,激活函数如sigmoid、ReLU和Leaky ReLU等负责引入非线性,使得网络能够学习更复杂的模式。同时,损失函数(如均方误差、交叉熵等)衡量模型预测与实际结果的差距,是优化目标。

总结来说,深度学习理论基础涵盖了神经网络的构建、训练和优化过程,涉及计算图、激活函数、损失函数、反向传播算法和梯度下降等核心概念。这些知识对于理解和实现高效的人工智能系统至关重要。

103 浏览量

2021-10-08 上传

2023-09-13 上传

2023-07-28 上传

2023-07-05 上传

2023-10-30 上传

2023-07-05 上传

2023-06-20 上传

2023-12-30 上传

sjyzhaoj

- 粉丝: 0

- 资源: 5

最新资源

- 磁性吸附笔筒设计创新,行业文档精选

- Java Swing实现的俄罗斯方块游戏代码分享

- 骨折生长的二维与三维模型比较分析

- 水彩花卉与羽毛无缝背景矢量素材

- 设计一种高效的袋料分离装置

- 探索4.20图包.zip的奥秘

- RabbitMQ 3.7.x延时消息交换插件安装与操作指南

- 解决NLTK下载停用词失败的问题

- 多系统平台的并行处理技术研究

- Jekyll项目实战:网页设计作业的入门练习

- discord.js v13按钮分页包实现教程与应用

- SpringBoot与Uniapp结合开发短视频APP实战教程

- Tensorflow学习笔记深度解析:人工智能实践指南

- 无服务器部署管理器:防止错误部署AWS帐户

- 医疗图标矢量素材合集:扁平风格16图标(PNG/EPS/PSD)

- 人工智能基础课程汇报PPT模板下载