卷积神经网络基础:二维互相关与LeNet解析

6 浏览量

更新于2024-08-30

收藏 343KB PDF 举报

"本文主要介绍了卷积神经网络(CNN)的基础知识,特别是二维互相关运算以及如何实现一个简单的二维卷积层。通过Python代码示例,深入理解CNN的核心概念,包括卷积核、滤波器、偏置以及卷积运算过程。此外,还展示了如何使用卷积核检测图像的边缘。"

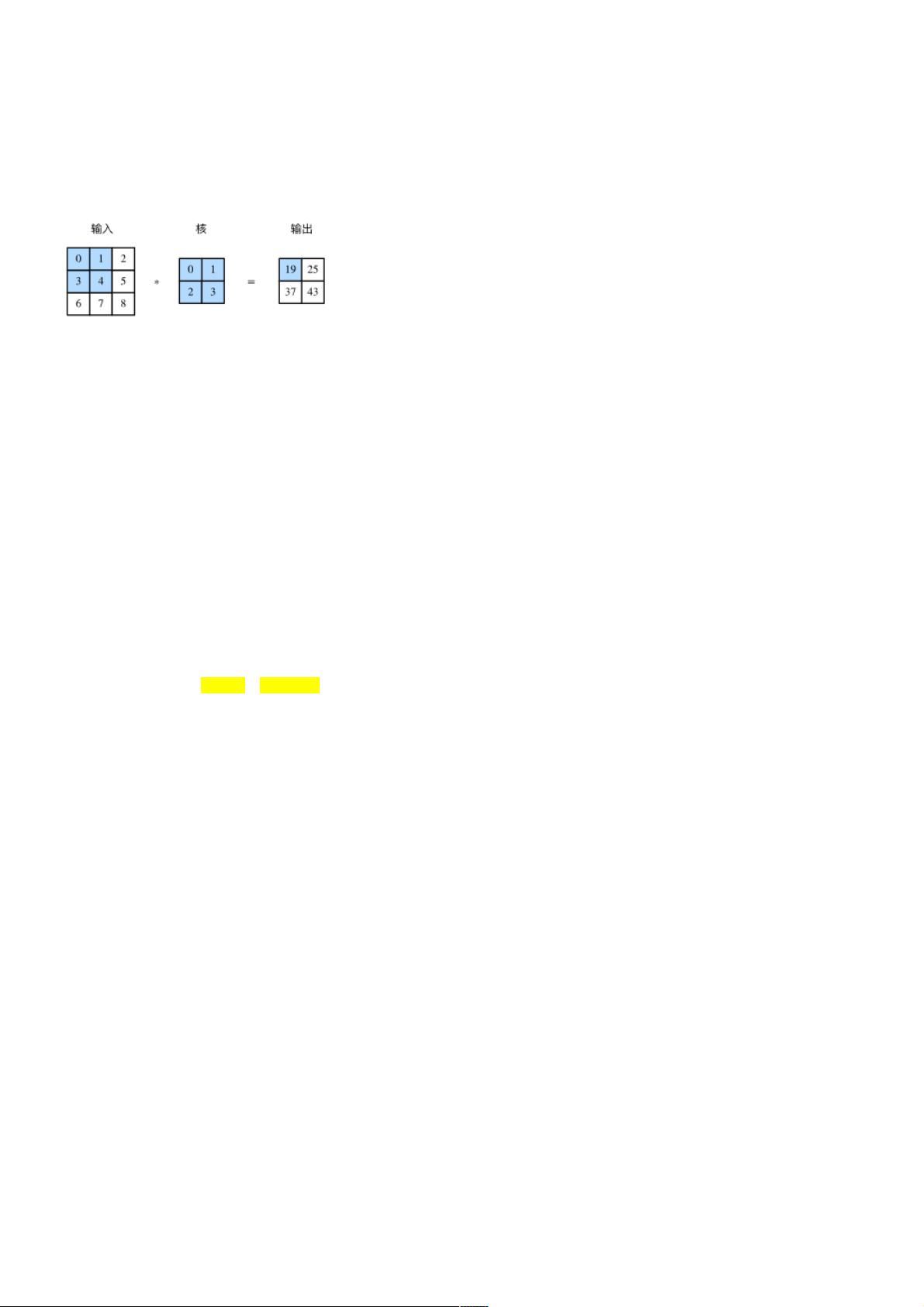

卷积神经网络(CNN)是深度学习领域的重要组成部分,尤其在图像处理和计算机视觉任务中表现出色。其核心操作是卷积,即二维互相关运算。在这个运算中,输入是一个二维数组(例如,图像的像素值),而卷积核(或称为滤波器)是一个小的二维矩阵,用于对输入进行扫描和分析。卷积核在输入数组上滑动,对于每个位置,它与输入子数组按元素相乘并求和,得到输出数组中对应位置的元素。这个过程有助于提取输入数据的特征,如边缘、纹理等。

在Python中,我们可以使用`torch.nn`模块中的`nn.Module`来定义一个简单的二维卷积层。卷积层的参数包括卷积核权重和偏置项。在`forward`函数中,卷积操作通过调用自定义的`corr2d`函数完成,然后加上偏置项得到最终的输出。

示例中还展示了一个简单的应用,即使用卷积核检测图像的边缘。这里创建了一个简单的图像`X`,并用一个特定的卷积核`K`对其进行卷积。卷积核的大小和形状会影响边缘检测的效果。在训练过程中,通过梯度下降更新卷积核的权重,以优化边缘检测的能力。

卷积神经网络如LeNet,AlexNet等,进一步扩展了这个基本概念,通过堆叠多个卷积层、池化层和全连接层,形成可以处理复杂图像识别任务的深层结构。这些网络在图像分类、物体检测等领域取得了显著的成就,并且是现代深度学习框架的基石。

总结起来,卷积神经网络通过卷积运算和滤波器来提取图像特征,其在图像处理任务中的强大能力源于其能够自动学习到的特征表示。了解并掌握CNN的基本原理和实现方式对于任何希望在深度学习领域有所作为的人来说都是至关重要的。

2021-02-05 上传

2021-05-18 上传

2021-01-13 上传

2021-03-11 上传

2021-05-29 上传

2015-10-16 上传

2017-10-29 上传

weixin_38663544

- 粉丝: 4

- 资源: 969

最新资源

- Python Django 深度学习 小程序

- react-phone-store

- WWDC_SwiftUI_Videos

- Pokedex-PokeAPI

- 计算机软件-编程源码-2万字库的拼音首字母查询,纯pb代码.zip

- Shape-List-Application:这是我 Java 课程的最后一个项目

- pcurl:pcurl是解析curl命令的库,弥补go生态链的一块空白[从零实现]

- hugegraph-computer:大规模图形计算

- Aliexpress的夜间模式-crx插件

- Java框架

- mongoose-data-migrate:使用猫鼬的node.js数据迁移框架

- FireStorm-Bluetooth:CS294 的蓝牙应用程序。 用于发现 BLE 设备并从 firestorm 和其他 BLE 设备接收 RSSI 值

- odsceast2021:R中的现代机器学习代码

- PHPEMS在线模拟考试系统 v6.1

- 电子功用-无氮气保护的电子束固化的涂料油墨、制备及固化方法

- portfolio-final:投资组合的最终版本,包括表格