深度学习基石:感知机与多层前馈神经网络解析

需积分: 10 47 浏览量

更新于2024-07-09

收藏 1.5MB PDF 举报

该文件是一份关于神经网络,特别是前馈网络的学习资料,由陈少波主讲,涵盖了机器学习的基础概念,包括感知机和多层感知机的介绍,以及神经网络的历史发展。内容涉及梯度下降法及其变体,以及神经网络的结构和激活函数。

神经网络是机器学习中的一个重要组成部分,它受到生物学中神经系统的启发,由大量简单的元素(神经元)通过相互连接形成一个大规模并行的网络。在这个网络中,每个神经元都有一定的适应性,权重和阈值是神经网络学习过程中获取知识的关键。

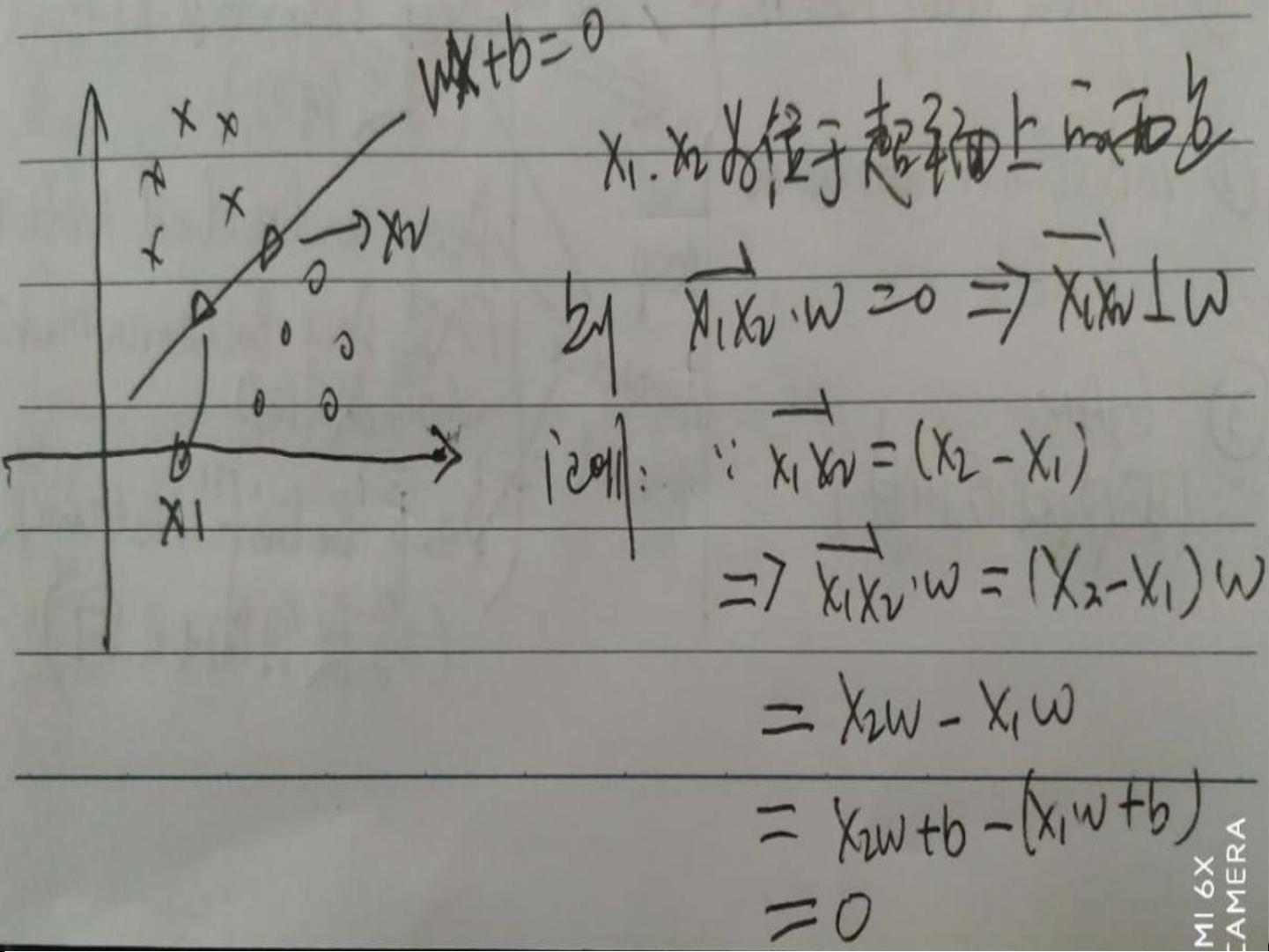

感知机是神经网络的最早形式之一,它能处理线性可分的问题。感知机有两种理解方式,一是作为线性分类器,二是通过函数距离和几何距离的概念来解释其工作原理。在训练过程中,感知机通常使用梯度下降法来更新权重,以最小化损失函数。梯度下降法有几种变体,包括随机梯度下降,它们在优化过程中各有优缺点。

多层感知机(MLP)是解决非线性问题的神经网络,尤其在处理异或问题时展现出其能力。MLP 区别于单层感知机,因为它包含至少一层隐藏层,这使得它可以学习更复杂的函数关系。激活函数在神经网络中起到关键作用,理想的激活函数应该是阶跃函数,但实际上由于其不连续性和不光滑性,通常使用Sigmoid函数或其他平滑的激活函数,如ReLU。

前馈网络是神经网络的一种类型,其特点是信息流从输入层单向传递到输出层,没有反馈循环,这使得计算过程更加直接和易于理解。在前馈网络中,神经元按照层次排列,每一层的神经元只与上下相邻层的神经元相连,这种结构允许网络学习复杂的非线性映射。

文件还概述了神经网络的历史发展,从1940年代的萌芽期到现代的深度学习繁荣期,期间经历了多次起伏,反映出科学发展的周期性特点。最后,资料强调了神经网络作为一门学科的广泛性和与机器学习的交集,并提醒读者要有耐心和决心,因为科学的进步往往需要时间的积累。

总结来说,这份资料提供了关于神经网络基础理论的深入理解,包括感知机、前馈网络、多层网络的结构以及优化算法,同时穿插了神经网络历史发展的重要里程碑,对于学习和理解神经网络的初学者来说是一份宝贵的资源。

2024-07-28 上传

qq_38256030

- 粉丝: 0

- 资源: 19

最新资源

- 收集的vc button 按钮源代码,仿iphone界面

- 易语言标签批量打印源码.zip

- GIMworld一键集运插件-crx插件

- react-webpack-boilerplate

- adb命令读/写操作: 可以嵌入到代码中执行

- rest-delphi:API分离和Delphi XE10 usando框架马

- 宁德新能源科技-电子签章.zip

- 跨时钟域问题解决方法.rar

- LeetCode:解决LeetCode的问题

- 基于大语言模型的交互式视频检索引擎,使用python+Django框架实现的

- HSTimestamp:这是一个库。 关于时间戳。 您可以使用它来获取当前时间戳,并获得有关time-ago的功能。

- 通用adb调试工具下载

- CS1699-Deliverable3:皮特 CS 1699 - 可交付成果 #3

- VC++动态设置窗体内文字的颜色

- AGBooks:教科书分发解决方案

- libqtcp:通过网络提供通信的库-开源