决策树在关键短语抽取中的应用与性能提升

需积分: 10 170 浏览量

更新于2024-08-13

收藏 342KB PDF 举报

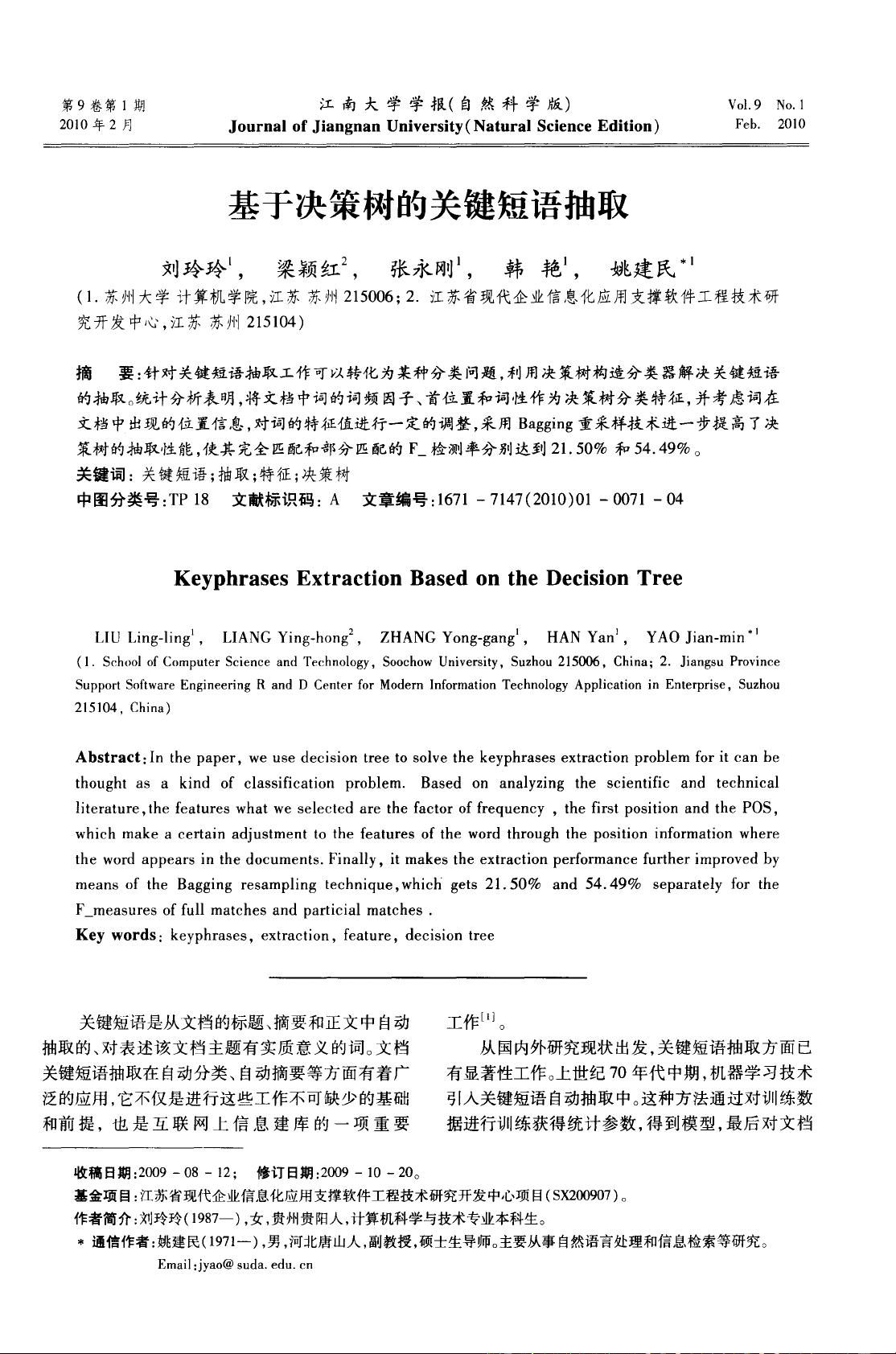

"基于决策树的关键短语抽取 (2010年),刘玲玲,梁颖红,张永刚,韩艳,姚建民"

本文是2010年发表在《江南大学学报(自然科学版)》的一篇研究论文,主要探讨了如何运用决策树算法来解决关键短语抽取的问题。关键短语抽取是从文本中自动提取出能代表文档主题的核心词汇或短语,这一任务在信息检索、文本摘要和知识挖掘等领域具有重要意义。作者提出将此问题转化为一个分类问题,通过构建决策树模型来识别文档中的关键短语。

在该研究中,作者采用了以下策略来构建决策树分类器:

1. 特征选择:选取文档中词的词频因子、首位置和词性作为分类特征。词频因子反映了词在文档中的重要性,首位置可能意味着这个词在文档主题中的突出程度,而词性信息则有助于理解词的语法角色和语义含义。

2. 位置信息:考虑到词在文档中的出现位置,这可能影响其是否为关键短语。例如,出现在标题或段落开头的词更有可能是关键短语。

3. 特征值调整:根据词的上下文和位置信息,对特征值进行适当调整,以增强特征的区分度,提高分类效果。

4. Bagging重采样技术:采用Bagging(Bootstrap Aggregating)方法,通过从原始数据集中抽样创建多个子集,训练多个决策树并集成,以提高模型的稳定性和泛化能力。这种方法有助于减少过拟合,提升抽取性能。

实验结果显示,运用以上策略的决策树模型在完全匹配和部分匹配的F_检测率上表现优秀,分别达到了21.50%和54.49%。这个结果表明,尽管这些指标可能在现代标准下显得较低,但相对于2010年的技术水平,这是一个显著的成就,证明了决策树在关键短语抽取中的有效性和潜力。

这篇论文提供了关于如何利用决策树算法进行关键短语抽取的一种早期尝试,它强调了特征选择和位置信息的重要性,并展示了集成学习方法在改善模型性能方面的价值。这些方法对于后续的研究和发展奠定了基础,启发了更多针对文本分析和信息抽取的机器学习方法。

2009-09-03 上传

2019-08-22 上传

2022-06-26 上传

2019-07-22 上传

393 浏览量

点击了解资源详情

点击了解资源详情

点击了解资源详情

weixin_38565818

- 粉丝: 3

- 资源: 956

最新资源

- 构建基于Django和Stripe的SaaS应用教程

- Symfony2框架打造的RESTful问答系统icare-server

- 蓝桥杯Python试题解析与答案题库

- Go语言实现NWA到WAV文件格式转换工具

- 基于Django的医患管理系统应用

- Jenkins工作流插件开发指南:支持Workflow Python模块

- Java红酒网站项目源码解析与系统开源介绍

- Underworld Exporter资产定义文件详解

- Java版Crash Bandicoot资源库:逆向工程与源码分享

- Spring Boot Starter 自动IP计数功能实现指南

- 我的世界牛顿物理学模组深入解析

- STM32单片机工程创建详解与模板应用

- GDG堪萨斯城代码实验室:离子与火力基地示例应用

- Android Capstone项目:实现Potlatch服务器与OAuth2.0认证

- Cbit类:简化计算封装与异步任务处理

- Java8兼容的FullContact API Java客户端库介绍