理解循环神经网络:GRU与LSTM模型解析

78 浏览量

更新于2024-08-30

收藏 149KB PDF 举报

本文主要介绍了循环神经网络(RNN)中的两种重要模型:门控循环单元(GRU)和长短期记忆网络(LSTM),以及深度循环神经网络和双向循环神经网络的概念,并提供了GRU的代码示例。

循环神经网络(RNN)是一种能够处理序列数据的神经网络结构,它在处理时间序列数据时面临梯度消失或爆炸的问题,这限制了它对长期依赖关系的捕获能力。为了解决这个问题,人们提出了门控机制的循环神经网络模型。

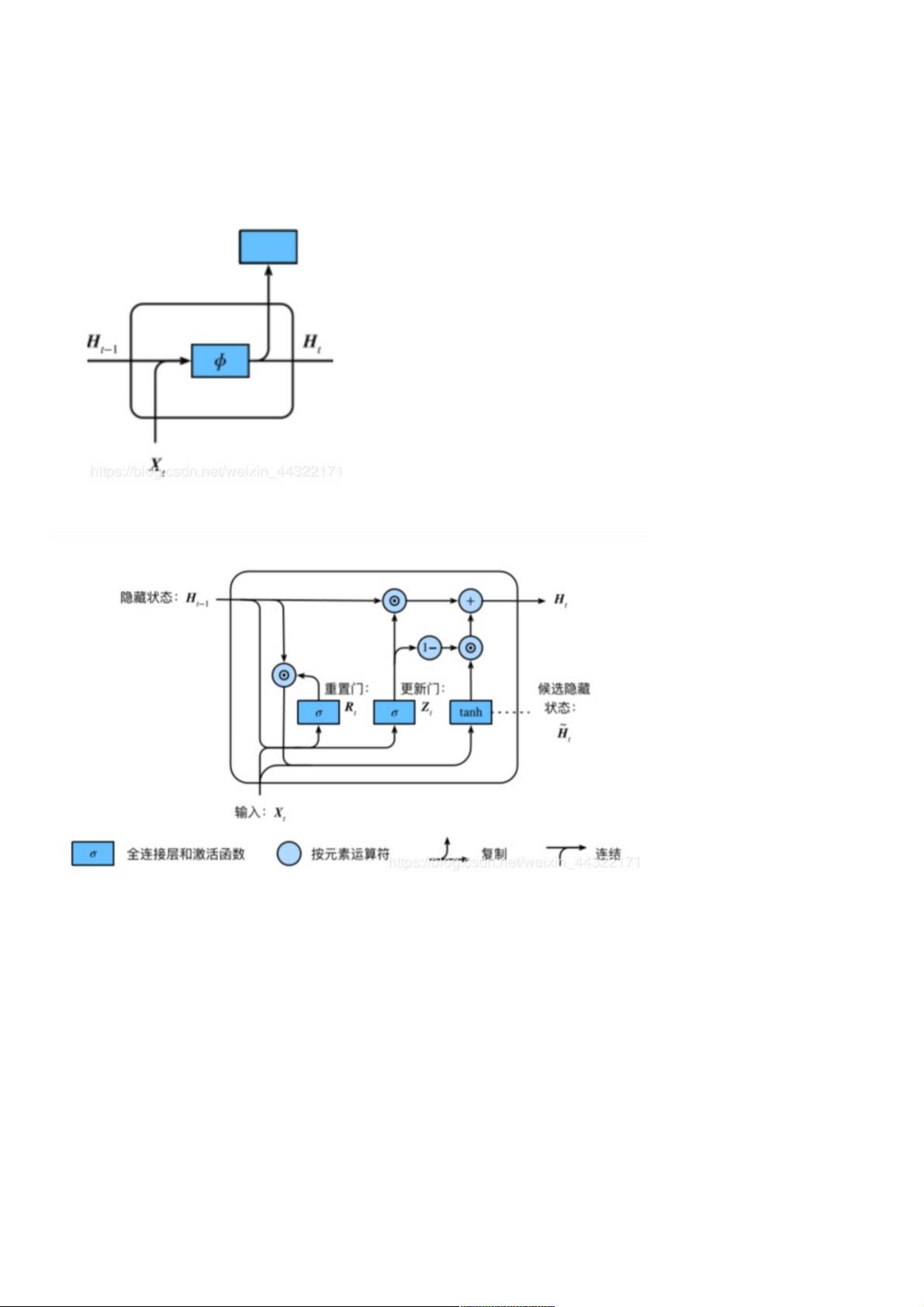

门控循环单元(GRU)是RNN的一种变体,它通过引入重置门(Reset Gate)和更新门(Update Gate)来改善传统RNN的缺陷。重置门允许模型忽略短期的无关信息,而更新门则帮助模型记住长期的上下文信息。GRU的计算过程包括以下几个步骤:

1. 通过重置门Rt来决定如何融合历史信息Ht-1和当前输入Xt。

2. 通过更新门Zt来决定新状态Ht与旧状态Ht-1的混合程度。

3. 计算候选隐藏状态H˜t,这是当前输入和部分历史信息的组合。

4. 最终状态Ht是通过更新门和旧状态的线性组合得到的,使得模型能够灵活地保留或丢弃过去的状态信息。

长短期记忆网络(LSTM)则是另一种门控RNN,它引入了遗忘门(Forget Gate)、输入门(Input Gate)和输出门(Output Gate)。遗忘门用于控制前一时间步的记忆细胞Ct-1,决定保留多少旧信息;输入门用来控制当前时间步的输入如何影响记忆细胞;输出门则控制从记忆细胞到隐藏状态的传递。LSTM的计算流程涉及多个门的控制,有效地解决了长期依赖问题,使得网络能够学习更复杂的序列模式。

深度循环神经网络(Deep RNN)是通过堆叠多个RNN层来增强模型的表示能力,每个时间步的输出会作为下一层的输入,从而增加了模型的非线性表达力。

双向循环神经网络(Bidirectional RNN)结合了两个方向的RNN,一个向前传播处理序列,另一个向后传播。这样可以从前后两个方向捕获序列信息,提高了模型对序列中依赖关系的理解。

GRU的代码示例展示了如何在PyTorch中实现GRU模型,其中包含了加载数据、定义模型、训练模型等基本步骤。

总结起来,循环神经网络的这些模型通过不同的门控机制优化了对序列数据的学习,增强了对长期依赖关系的捕捉能力,广泛应用于自然语言处理、语音识别、时间序列预测等领域。

2022-07-14 上传

2021-01-07 上传

点击了解资源详情

点击了解资源详情

点击了解资源详情

点击了解资源详情

点击了解资源详情

点击了解资源详情

weixin_38599412

- 粉丝: 6

- 资源: 930

最新资源

- diagwiz:ASCII图作为代码

- userscripts:一些改善UI的用户脚本

- bsu:FAMCS BSU(专业计算机安全)上用于大学实验室的资料库

- krip:彻底的简单加密,在后台使用WebCrypto

- 费用追踪器应用

- 111.zip机器学习神经网络数据预处理

- 财务管理系统

- NNet:用于手写识别的神经网络

- 加州阳光咖啡书吧创业计划书.zip

- Pricy - Amazon Price Watch-crx插件

- AMONG_py-0.0.3-py3-none-any.whl.zip

- MIUI12.5-其他:MIUITR Beta其他语言翻译

- SnowCat:薛定谔的猫

- AMD-1.2.1-py3-none-any.whl.zip

- Slider popover(iPhone源代码)

- 实现一个3D转盘菜单效果