元学习驱动的视觉目标跟踪:在线自适应与高效鲁棒性提升

62 浏览量

更新于2024-06-20

收藏 1.73MB PDF 举报

元跟踪器:视觉对象跟踪中的在线自适应,基于Meta学习的快速鲁棒方法

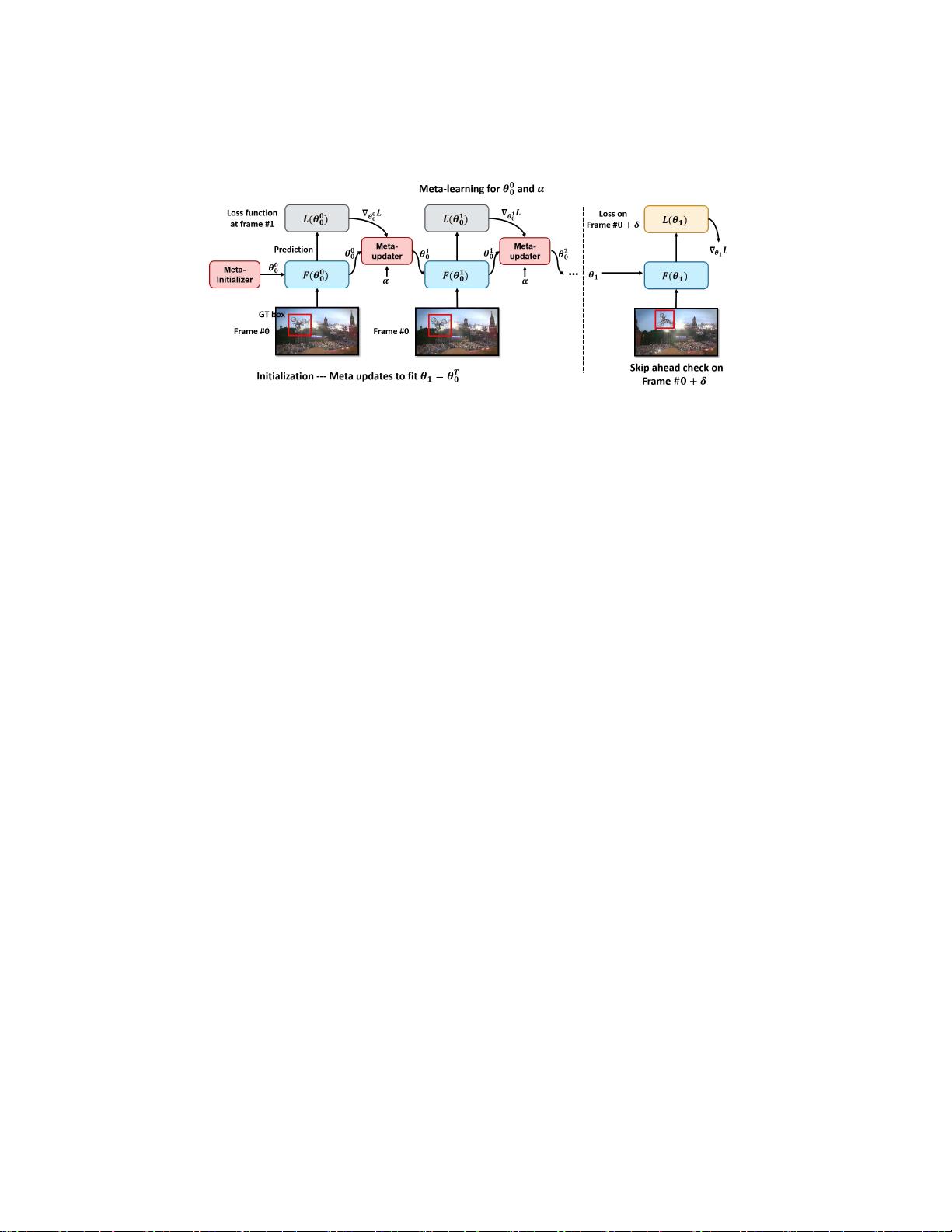

元跟踪器是一种创新的视觉目标跟踪技术,旨在解决传统对象跟踪中面临的挑战,如实例级区分、背景杂波干扰和目标外观变化等问题。本文的核心贡献是提出了一种离线Meta学习框架,它能够在深度网络中集成目标驱动的学习,从而实现对目标的快速、鲁棒的在线自适应。

传统的在线自适应方法,如基于DCF(判别相关滤波器)或二元分类器的跟踪器,会在序列的第一帧中初始化目标模型,然后随着帧的推进逐步调整。然而,这些方法往往容易受到背景噪声、目标部分遮挡或形状变化的影响。元学习的引入则提供了一个新的解决方案,它通过对深度网络进行离线预训练,使得网络能够专注于学习那些在未来帧中对目标识别有用的特征,同时避免过拟合背景细节。

Meta学习在此场景下扮演了关键角色,它模拟了人类学习的过程,即深度网络通过学习一系列样本(包括目标和非目标的图像)来形成一种“通用模板”,当面对新的追踪场景时,能迅速调整以适应目标的变化。这种方法通过限制元学习过程中的迭代次数,显著加快了网络的在线适应速度,使得元跟踪器在保持准确性的同时,展现出更高的实时性能。

作者们将这种方法应用到了两个高性能的跟踪器上:基于检测的MDNet[1]和基于相关性的CREST[2],并在OTB2015[3]和VOT2016[4]这两个标准的视觉对象跟踪基准上进行了实验验证。结果显示,经过Meta学习优化后的跟踪器在速度、精度和鲁棒性方面都有显著提升,证明了元跟踪器的有效性和实用性。

这项工作突破了传统的在线自适应策略,通过Meta学习实现了深度网络的高效调整,为视觉对象跟踪领域的研究开辟了新的方向,提升了跟踪性能并促进了实时应用的发展。访问[https://github.com/silverbottlep/metatrackers](https://github.com/silverbottlep/metatrackers)获取相关代码,进一步了解这一创新技术的实现细节和应用场景。

2025-01-04 上传

2025-01-04 上传

2025-01-04 上传

2025-01-04 上传

2025-01-04 上传

cpongm

- 粉丝: 5

- 资源: 2万+

最新资源

- IP网络设计系列之-基本原则

- Guice的用户手册

- JavaScript弹出窗口DIV层效果代码

- MCTS 70-431 中文题库

- Foundations.of.F.Sharp.May.2007

- linux 服务器的安设置

- javascript浮动div,可拖拽div,遮罩层(div和iframe实现)

- 自动化 C++程序设计.pdf

- 高质量 C++ 和 C 编程指南.pdf

- 163邮箱客户端的设置详细说明

- 多线程编程指南.pdf

- 运用Asp.Net Mobile Controls 开发面向移动平台的Web Application

- 电脑主板知识.pdf

- Welcome to Protected Mode

- WAP中实现数据库附件下载

- C和C++ 嵌入式系统编程.pdf