深度解析:多层递归神经网络与LSTM在图像captioning中的应用

PDF格式 | 1.42MB |

更新于2024-08-28

| 7 浏览量 | 举报

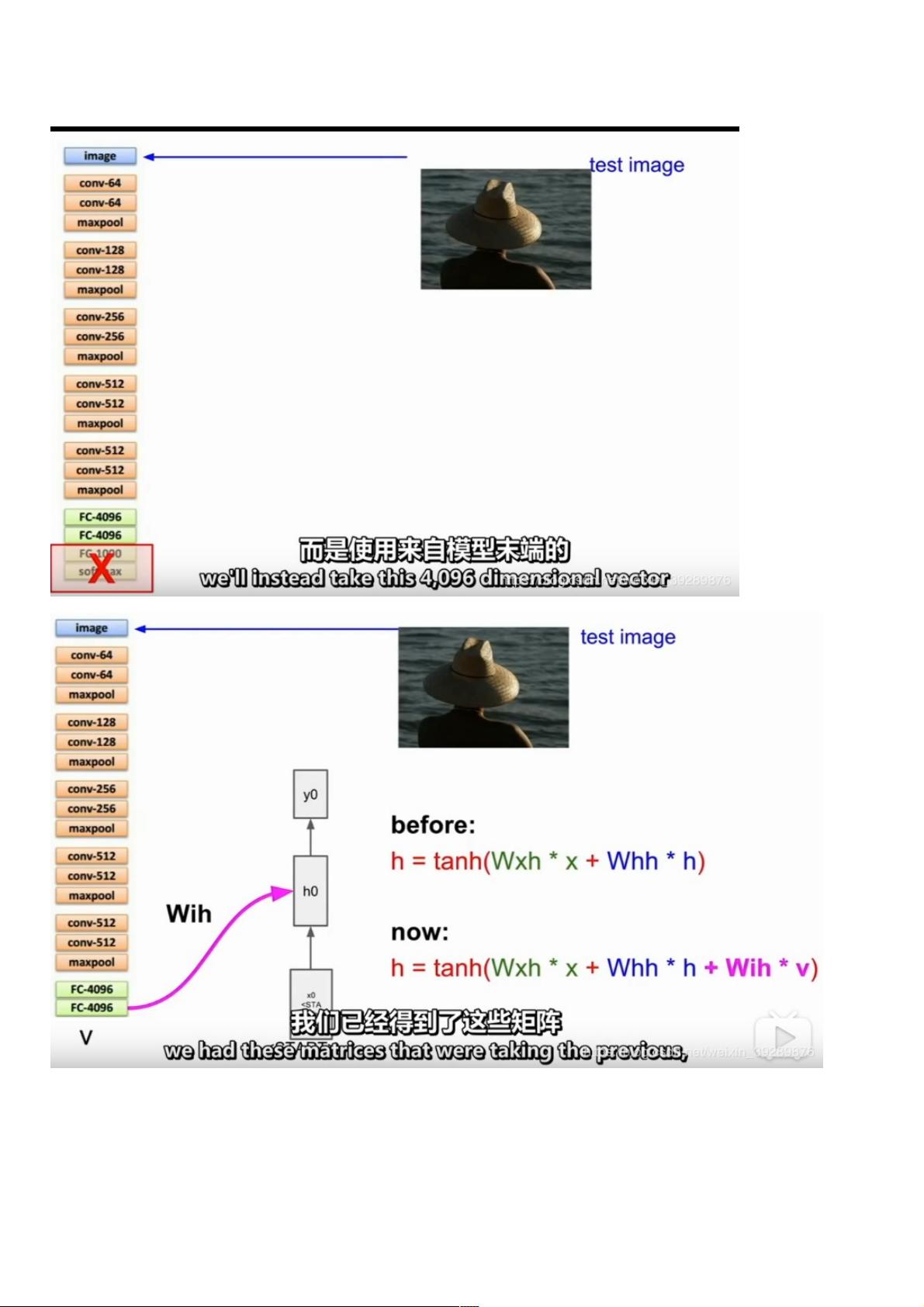

本文主要探讨了图像描述(Image Captioning)和视觉问题(Visual Question Answering)领域的技术,特别是使用深度学习中的多层递归神经网络(RNN),尤其是长短期记忆网络(LSTM)。文章首先介绍了如何通过卷积神经网络(CNN)处理图像,提取出4096维的特征向量,这些向量被用于表示图像内容,并作为递归神经网络的输入。

在递归神经网络中,关键的是理解初始输入,它引导网络开始生成文本。一种策略是引入一个独立的权重矩阵,以融合图像信息到文本生成过程中。这种结构允许生成连贯的句子,当遇到特定停止标记时,自动终止生成过程。

文章深入解析了多层递归神经网络,如LSTM,它采用三层循环结构,每层生成一系列隐藏状态。第一层处理输入,随后的层次逐级递进,通过反向传播算法调整权重,确保梯度能够有效地在时间步之间传递。然而,由于RNN中的梯度问题,如梯度消失和梯度爆炸,LSTM引入了门控机制,包括输入门、遗忘门和输出门,它们能更好地控制信息的流动,防止梯度问题。

在LSTM中,每个时间步都会更新两个隐藏状态:一个简单的隐藏状态ht和一个细胞状态ct,后者能够长期保存信息。这样,LSTM解决了递归神经网络在处理长序列时的梯度问题,使得网络能够在复杂的视觉任务中保持稳定性能。

总结来说,本文重点在于阐述如何运用多层递归神经网络,特别是LSTM,来处理图像描述和视觉问题,通过优化权重整合和梯度管理,有效地解决长序列问题,提升模型的准确性和稳定性。

相关推荐

weixin_38641366

- 粉丝: 4

最新资源

- 昆仑通态MCGS嵌入版_XMTJ温度巡检仪软件包解压教程

- MultiBaC:掌握单次与多次组批处理校正技术

- 俄罗斯方块C/C++源代码及开发环境文件分享

- 打造Android跳动频谱显示应用

- VC++实现图片处理的小波变换方法

- 商城产品图片放大镜效果的实现与用户体验提升

- 全新发布:jQuery EasyUI 1.5.5中文API及开发工具包

- MATLAB卡尔曼滤波运动目标检测源代码及数据集

- DoxiePHP:一个PHP开发者的辅助工具

- 200mW 6MHz小功率调幅发射机设计与仿真

- SSD7课程练习10答案解析

- 机器人原理的MATLAB仿真实现

- Chromium 80.0.3958.0版本发布,Chrome工程版新功能体验

- Python实现的贵金属追踪工具Goldbug介绍

- Silverlight开源文件上传工具应用与介绍

- 简化瀑布流组件实现与应用示例