深度解析ORB_SLAM:代码实现与原理详解

需积分: 11 7 浏览量

更新于2024-07-20

收藏 758KB PPTX 举报

ORB-SLAM(Oriented FAST and Rotated BRIEF)是一种高效且广泛应用于视觉SLAM(Simultaneous Localization And Mapping,同时定位与建图)的视觉SLAM系统,由冯兵等人在2016年提出。这个算法专注于实时性能,并在具有挑战性的环境中表现出色,如光照变化、运动模糊和纹理稀疏的场景。

该系统的输入主要包括摄像头捕获的图像以及时间戳,这些数据经过传感器融合处理,结合了来自摄像头的内参(包括焦距、光心等已校准参数)。ORB-SLAM要求保持相机的zoom稳定,focus尽量不变,因为图像尺寸会影响内参的计算,如果需要对采集图像进行缩放,内参需要相应调整。

算法的核心模块有四个线程:

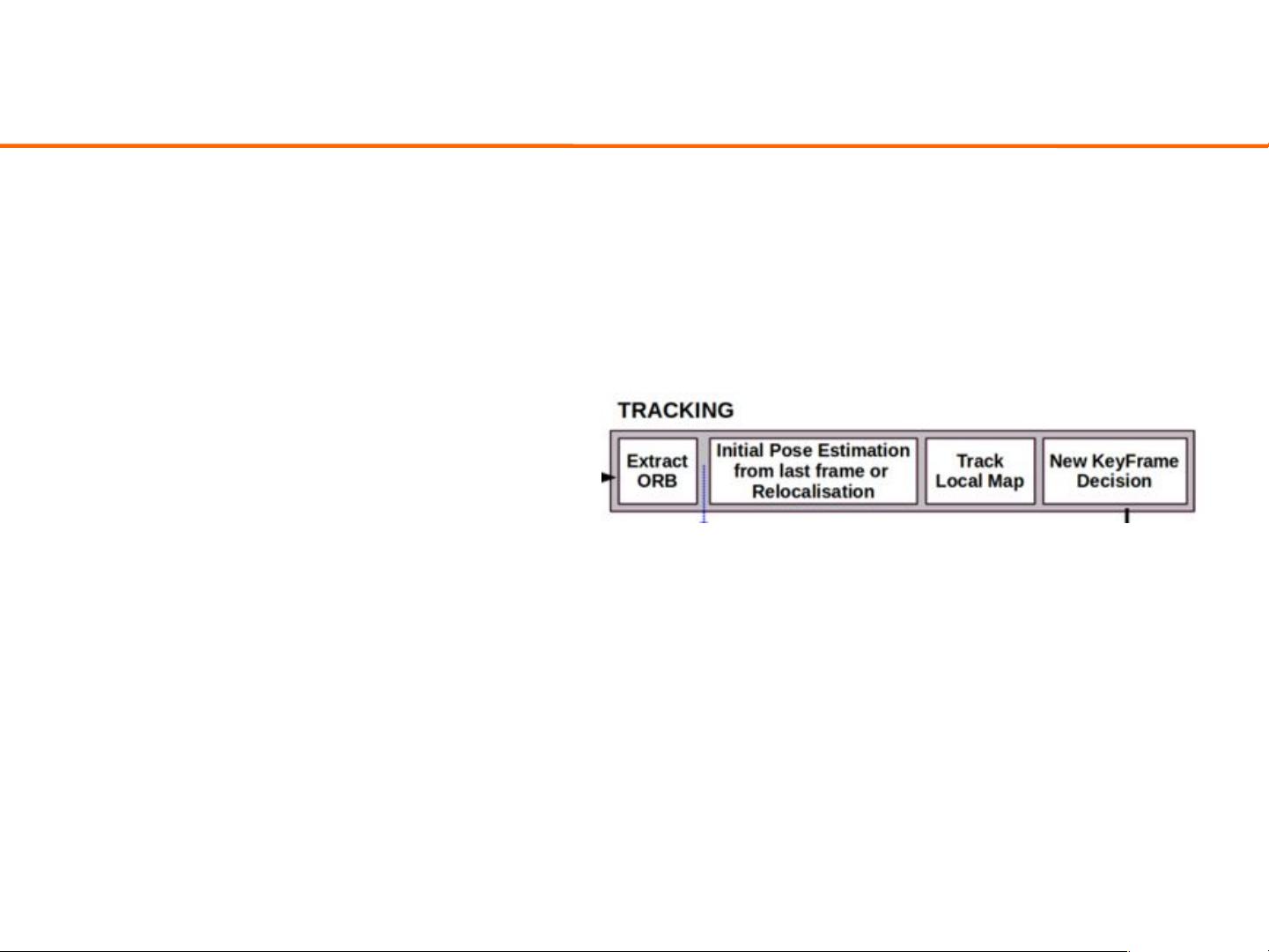

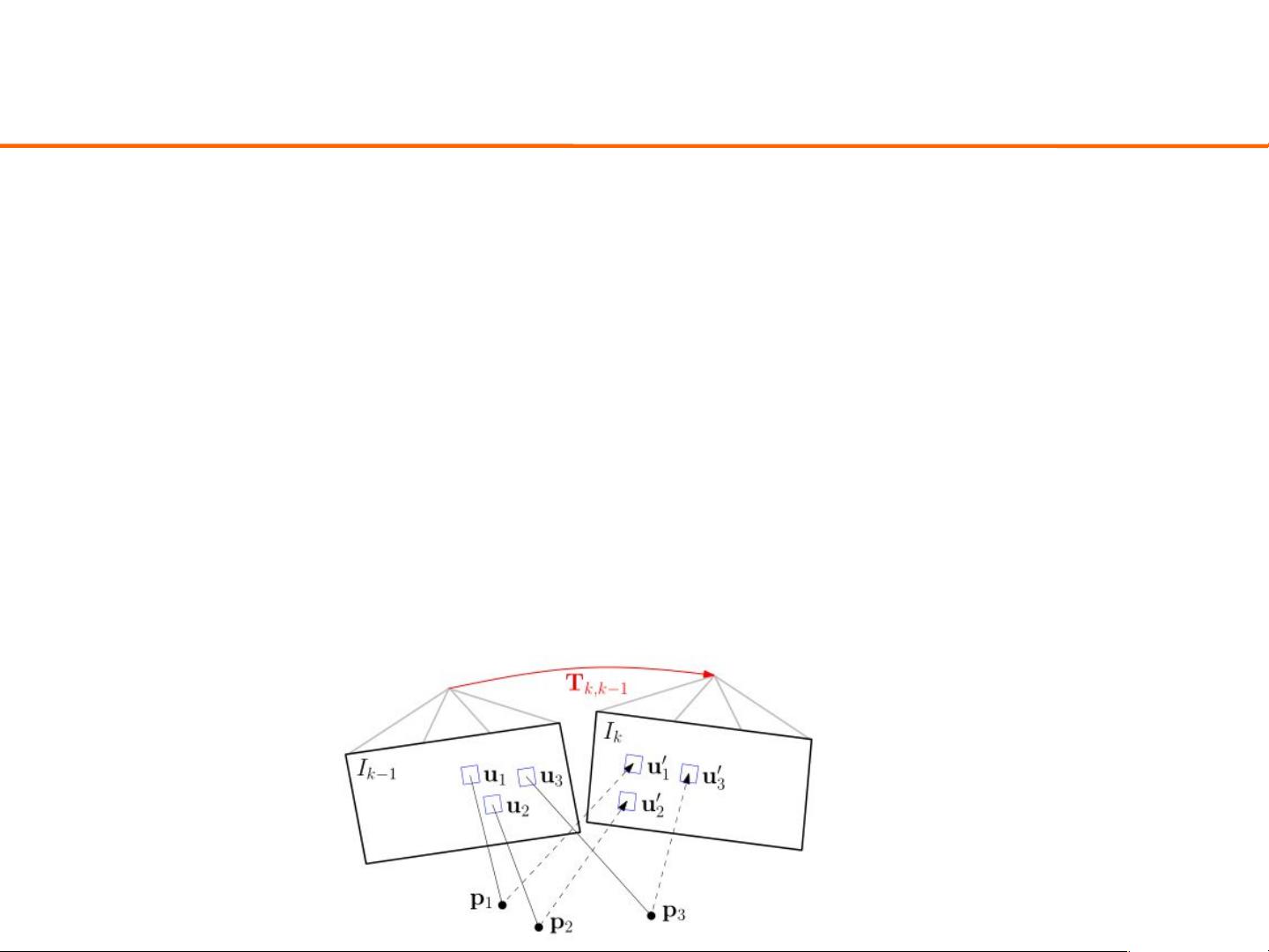

1. **Tracking**:负责实时追踪每一帧的相机位姿,通过ORB特征检测和匹配来估计当前帧与之前帧之间的运动。它首先进行初始化,然后进行跟踪,包括参考关键帧跟踪、运动模型跟踪和与局部地图的关联。此外,ORB-SLAM还实现了自动初始化功能,通过共面和非共面约束关系的处理,确定更精确的3D点位置。

2. **LocalMapping**:当积累足够的特征和运动信息时,该线程会寻找关键帧,用于创建新的局部地图,进一步细化环境模型。

3. **LoopClosing**:此线程负责检测并处理循环闭合(loop closure),即识别出之前已经探索过的区域,从而修正先前估计的位姿,提高全局地图的精度。

4. **Viewer**:负责实时显示和渲染重建的地图,以便用户观察和理解SLAM过程。

在ORB-SLAM中,帧(Frame)是数据处理的基本单元,它包含了图像数据、相机内参、特征数据和相机姿态信息。特征(Feature)则扮演着关键角色,它封装了关键点(keypoint)和描述符(descriptor),连接帧和关键帧,同时也与地图中的关键点(MapPoint)一对一对应。这样,通过特征匹配和跟踪,ORB-SLAM能够建立起帧之间的空间关系,并逐渐构建出完整的环境地图。

ORB-SLAM算法利用ORB特征的稳健性和效率,通过多线程并行处理,实现在视觉SLAM中的实时性能,尤其适合于需要高实时性或资源受限的机器人导航和自主驾驶等领域。通过理解其核心模块、数据结构和约束优化策略,开发者可以更好地应用和定制这一先进的视觉定位和建图技术。

2018-05-08 上传

155 浏览量

2021-03-19 上传

2024-01-14 上传

2021-02-22 上传

2024-02-21 上传

165 浏览量

2021-08-13 上传

jay463261929

- 粉丝: 123

- 资源: 1

最新资源

- qt-ultralight-browser:基于Qt Ultralight Webview的超轻量级Web浏览器,由Ultralight HTML渲染器提供支持

- Hackaton

- makeepub:帮助从 HTML 文件生成 EPUB 书籍的工具

- brownfield-site-collection:收集棕地网站的shapefile

- 闪烁电路.zip西门子PLC编程实例程序源码下载

- java

- 行业分类-设备装置-同步体.zip

- mod_jdc-开源

- COMP7940-Chatbot

- github-jobs:完全功能重新设计Jobs.github.com

- portfolio-react

- Wild_boar_ENM:为南美野猪开发ENM

- 易语言聊天室管理工具源码-易语言

- 行业分类-设备装置-可调手动削笔器.zip

- sonicstage5.1-ha.zip

- Saunders_TiGram