信息论第五讲:变长编码与霍夫曼编码

需积分: 10 155 浏览量

更新于2024-07-29

收藏 470KB PDF 举报

"信息论 5讲 - 北京航空航天大学 201教研室 陈杰"

在信息论这一领域,我们主要探讨的是通信系统中的数学原理,由美国数学家C.E.香农在1948年的论文《A Mathematical Theory of Communication》中奠定了基础。信息论的研究内容涵盖了以下几个核心概念:

1. **信源与信息量**:信源是信息的产生者,可以是人、设备或其他数据生成实体。信息量通常用熵(Entropy)来衡量,表示信源符号的不确定性。熵越大,信息量越多。

2. **信道与信道容量**:信道是信息传输的媒介,它可能受到噪声、干扰等因素的影响。信道容量是指在给定的误码率下,信道能传输的最大信息速率,由香农第二定理定义。

3. **信源与信道间统计匹配**:为了高效传输,信源编码要根据信道特性进行优化,使得传输效率最大化。

4. **信源与信道编码定理**:这两个定理分别阐述了如何通过编码技术在信源端压缩信息,以及在信道端对抗噪声。香农第一定理(信源编码定理)说明了无损压缩信息的极限;而信道编码定理则指出在有噪声的信道上,存在一种编码方式,使得信息能够以接近信道容量的速率无错误地传输。

在本课程的第五讲中,重点讨论了信源编码:

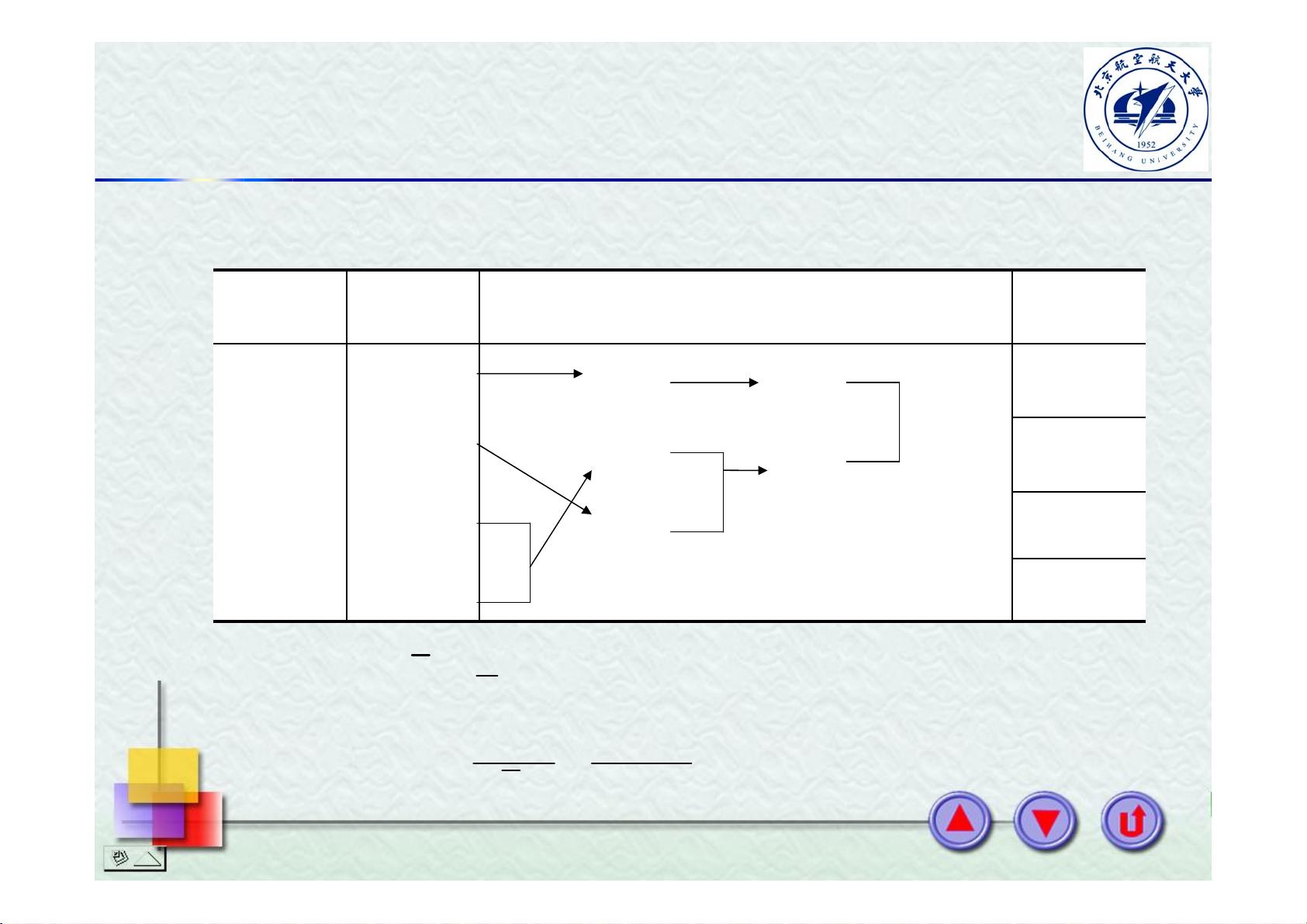

- **编码器**:将信源符号转换为码符号的过程,如分组码,要求编码具有奇异性(非奇异),唯一可译性(编码与解码一一对应),以及即时码(编码后的码字立即发送)。

- **香农编码**:一种基本的变长编码方法,旨在通过更短的码字编码高概率的符号,以降低平均码长。

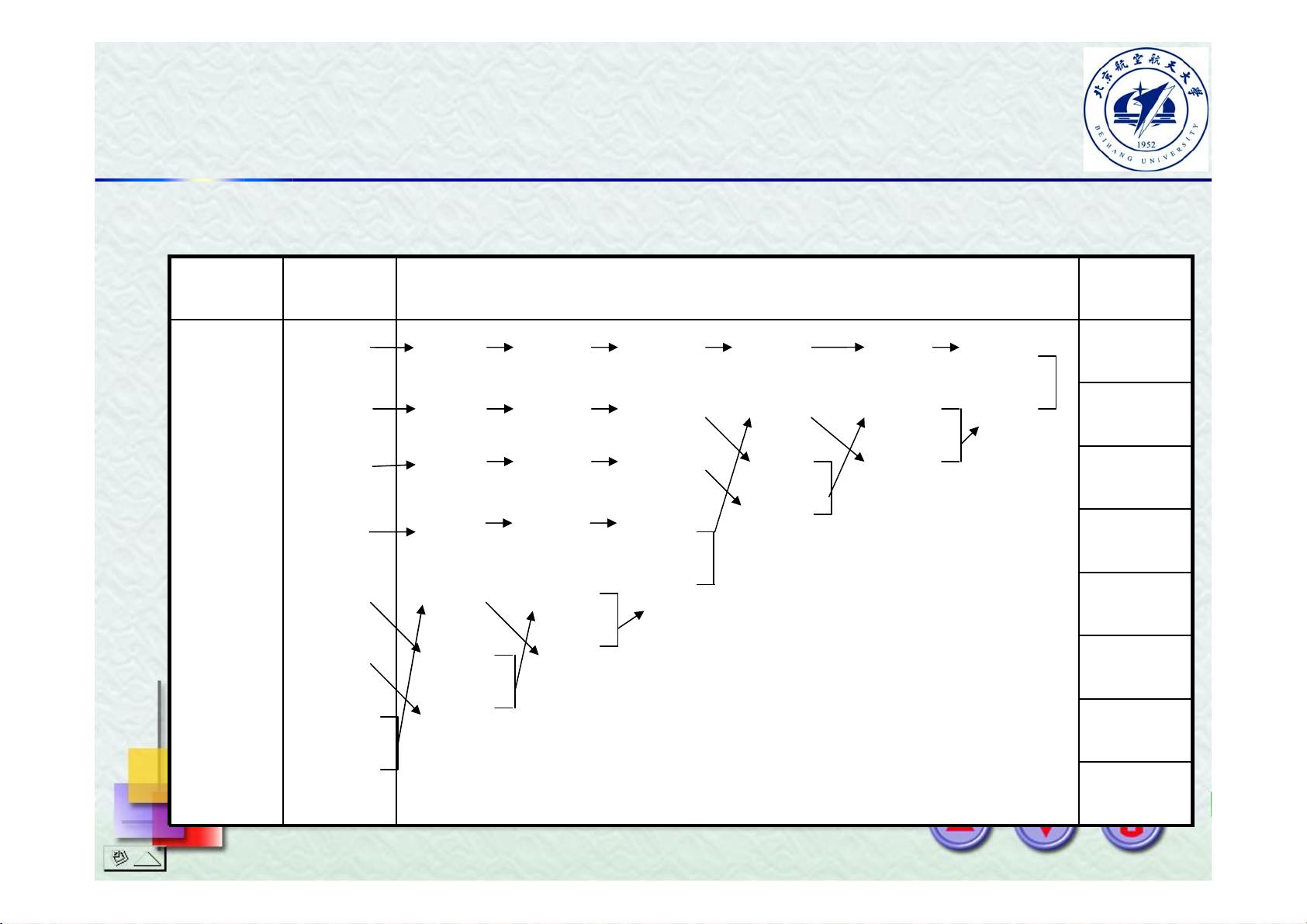

- **Huffman编码**:作为最佳码(紧致码),Huffman编码是一种基于概率的前缀编码,确保没有码字是其他码字的前缀,从而避免解码歧义。它的构建基于最小带权路径长度算法。

- **Fano编码**:另一种变长编码方法,适用于概率分布不均匀的信源。

- **变长信源编码方法的应用**:通过具体的例子展示了如何为离散无记忆信源设计霍夫曼编码,并计算编码效率(码率R与信源熵HS的关系)。

例如,在例5.2中,一个离散无记忆信源有五个符号,每个符号的概率不同。通过霍夫曼编码,我们可以为每个符号分配不同的码字,使得频繁出现的符号码字较短,不常出现的符号码字较长。这样,编码效率可以提高,信源的信息传输速率得以优化。

信息论是理解和设计高效通信系统的关键,通过对信源和信道的深入分析,我们可以更好地理解信息的压缩、传输和恢复过程,为实际通信技术提供理论支持。

2019-06-01 上传

2011-09-27 上传

2021-01-05 上传

2023-10-26 上传

2023-09-16 上传

2023-05-30 上传

2023-02-06 上传

2023-07-29 上传

2023-10-21 上传

RedskyDeng

- 粉丝: 1106

- 资源: 22

最新资源

- SSM Java项目:StudentInfo 数据管理与可视化分析

- pyedgar:Python库简化EDGAR数据交互与文档下载

- Node.js环境下wfdb文件解码与实时数据处理

- phpcms v2.2企业级网站管理系统发布

- 美团饿了么优惠券推广工具-uniapp源码

- 基于红外传感器的会议室实时占用率测量系统

- DenseNet-201预训练模型:图像分类的深度学习工具箱

- Java实现和弦移调工具:Transposer-java

- phpMyFAQ 2.5.1 Beta多国语言版:技术项目源码共享平台

- Python自动化源码实现便捷自动下单功能

- Android天气预报应用:查看多城市详细天气信息

- PHPTML类:简化HTML页面创建的PHP开源工具

- Biovec在蛋白质分析中的应用:预测、结构和可视化

- EfficientNet-b0深度学习工具箱模型在MATLAB中的应用

- 2024年河北省技能大赛数字化设计开发样题解析

- 笔记本USB加湿器:便携式设计解决方案