ConMatch 7

基于

弱

增广图像输出的置信度估计

α

(

r

)作为非参数和参数方法中的锚点。

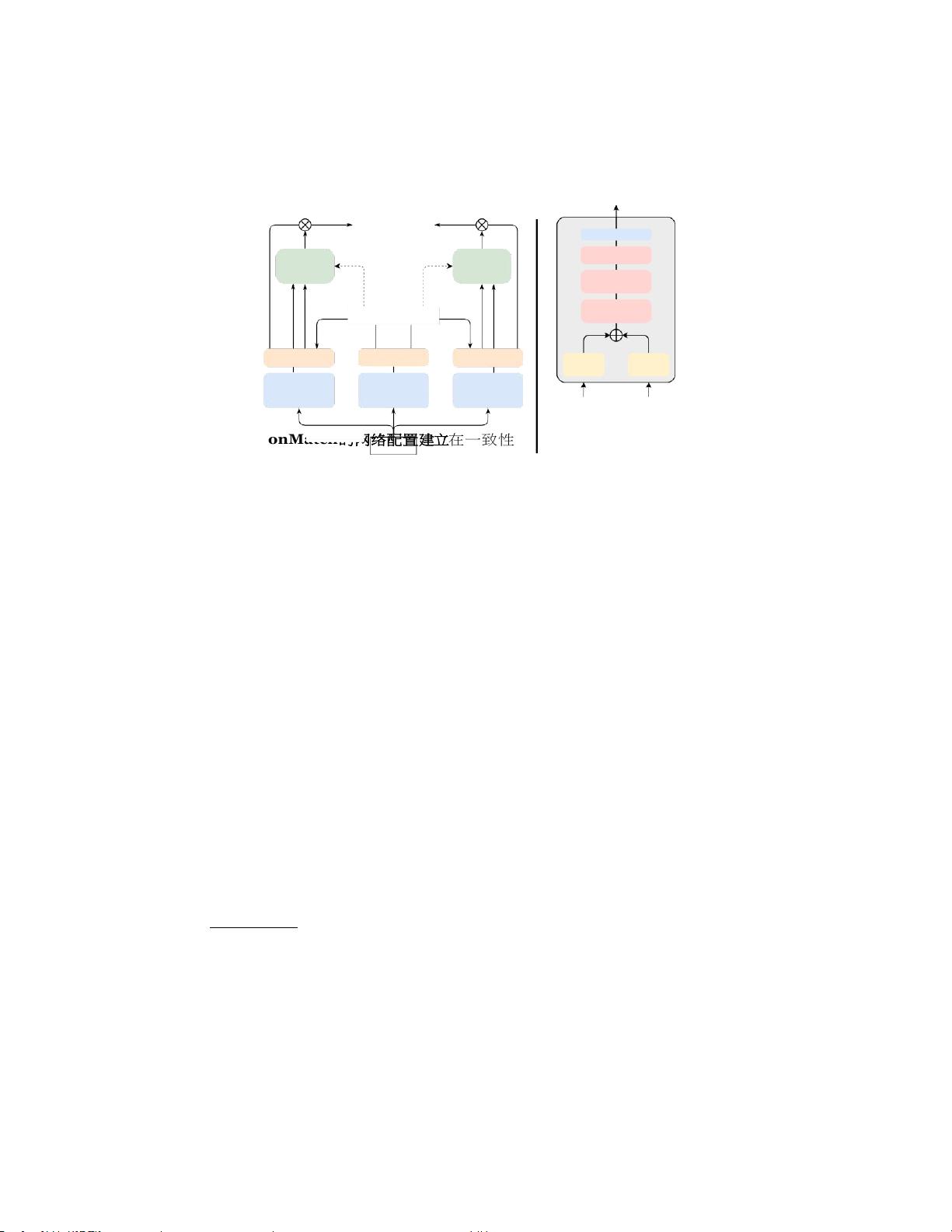

我们的ConMatch概述如图2所示。具体地说,

强

增强图像有两个分支

(称为强分支),

弱

增强图像有一个分支(称为弱分支).类似于现有的

半监督表示学习方法[47,54,58],我们尝试在一对强分支和弱分支之间

应用一致性损失。但是,针对半监督学习,我们提出了两个强分支之间

的置信度引导的一致性正则化损失

L

ccr

,使得

L

ccr

=

c

i

(

r

)

H

(

q

i

(

r

)

,

p

m ode l

(

y

|

Aj

(

r

);

θ

))

+

cj

(

r

)

H

(

q

j

(

r

)

,

p

m

ode l

(

y

| A

i

(

r

);

θ

))

,

(3)

其中,

Qi

(

r

)

和

Qj

(

r

)

表示

从

p

_m_de_l

(

y

)生成的伪标签,

|A

i

(

r

);

θ

)

和

p

mode l

(

y

|

Aj

(

r

);

θ

),

分别

为

:

c

i

(

r

)

和d

c

j

(

r

)

表示

q

i

(

r

)

和

q

j

(

r

)的估计置信度。

我们

提出

的

损失函数与

传统

的

自

监督表示学

习损失

函数

不同

,因为一致性应用于类似于[47,58]的logit级别(而

不是特征级别),并通过估计的置信度进行调整。然而,与[42,

47,52,54,58]不同的是,我们可以

通过考虑两个强增强视图来学

习更好的特征表示,同时提高

半监督学习性能。应该注意的是,这

个简单的损失函数可以与任何半监督学习器结合[47]第58话:你是

谁?

为了

测量

置信度

ci

(

r

)

和

cj

(

r

),

我们提出了两种

基于非参数和

参数方法的置信度估计。在下文中,我们将详细解释如何测量这些置

信度。

3.3

测量置信度:非参数方法

现有的半监督学习方法[30,44,47]选择了具有高置信度的未标记样本作

为训练目标(即,伪标签);这可以被视为熵最小化的一种形式[19]。众

所周知,为这种手工制作的置信度估计设置适当的阈值是不平凡的,因

此,基于置信度的策略通常遭受伪标签探索和取决于阈值的准确性之间

的困境[1,34]。

在我们的框架中,如果简单地使用传统的手工方法[30,44,47],则

从强分支估计伪标签的置信度可能会受到类似的限制。为了克服这个问

题,我们提出了一种新的方法

来

测量

置信度,

ci

(

r

)

和

cj

(

r

),

基于

强

增强图像和

弱

增强图像的输出之间的

相似性

基于强增强图像和弱增强

图像的logit或概率之间的相似性可以直接用作置信度估计的假设,我们

提出了度量每个强分支损失的置信度的方法