TensorFlow实现的注意力机制详解

需积分: 10 63 浏览量

更新于2024-07-14

收藏 2.1MB PDF 举报

"这篇文档是关于使用TensorFlow实现注意力机制(Attention Mechanisms)的详细教程,作者Keon Kim,发布于2016年8月26日。文档涵盖了基本的注意力机制及其在编码解码模型中的应用,还讨论了注意力机制的一个变种——指针网络(Pointer Networks)及其实现。"

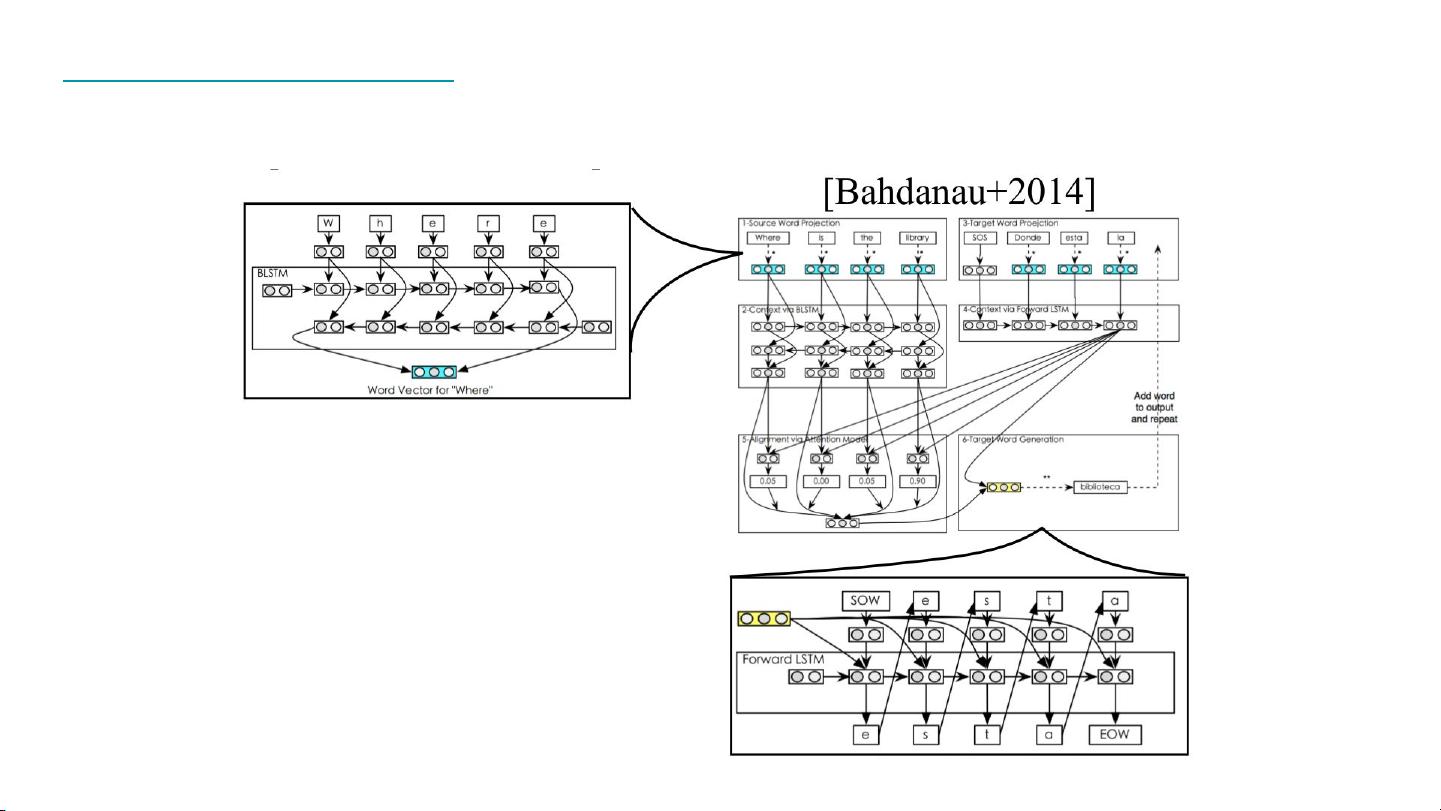

在深度学习中,注意力机制(Attention Mechanisms)已经成为序列到序列建模的重要组成部分,尤其是在自然语言处理(NLP)任务中,如机器翻译和语音识别。传统的RNN(循环神经网络)或LSTM(长短期记忆网络)模型中,编码器会将输入序列压缩成一个固定长度的向量,然后解码器依赖这个向量来生成输出序列。然而,这样的模型可能会丢失部分重要信息,特别是在长序列中。

注意力机制解决了这个问题,它允许解码器在生成每个输出时动态地关注输入序列的不同部分,而不仅仅是依赖最后一个编码状态。具体来说,注意力机制通过加权平均的方式生成一个上下文向量(ct),这个上下文向量是输入序列的各个部分(由隐藏状态h表示)经过加权后的结果。权重是通过softmax函数计算得出,确保了权重的归一化。这样,生成的输出yt就不仅仅依赖最后的编码状态,而是依据当前需要关注的输入部分。

文档中提到了两种类型的注意力机制:

1. **基础的注意力机制**:在这种机制中,解码器在每个时间步都会根据当前的隐藏状态计算注意力权重,并对编码器的所有隐藏状态进行加权求和,形成上下文向量,然后用这个上下文向量和解码器的状态一起预测下一个输出。

2. **指针网络(Pointer Networks)**:这是注意力机制的一种变体,其创新之处在于输出可以直接从输入序列中“指”出来,而不是通过隐层状态生成。在指针网络中,解码器可以“指向”输入序列中的特定位置作为输出,特别适合处理序列中的位置依赖问题,如解决排序问题或文本生成。

TensorFlow是一个强大的开源库,广泛用于构建和训练各种深度学习模型,包括注意力机制。文档的后半部分很可能是详细解释如何在TensorFlow中实现这两种注意力机制,包括理论解析和代码实现,对于开发者来说是一份宝贵的参考资料。

通过学习这篇文档,读者不仅可以理解注意力机制的基本原理,还能掌握在实际项目中利用TensorFlow实现这些机制的技能,从而提升模型的性能和效率。

2022-03-30 上传

2022-06-30 上传

2020-11-21 上传

2011-03-23 上传

2019-05-20 上传

2017-12-06 上传

2021-08-22 上传

105 浏览量

2010-09-23 上传

illool

- 粉丝: 1

- 资源: 11

最新资源

- 高清艺术文字图标资源,PNG和ICO格式免费下载

- mui框架HTML5应用界面组件使用示例教程

- Vue.js开发利器:chrome-vue-devtools插件解析

- 掌握ElectronBrowserJS:打造跨平台电子应用

- 前端导师教程:构建与部署社交证明页面

- Java多线程与线程安全在断点续传中的实现

- 免Root一键卸载安卓预装应用教程

- 易语言实现高级表格滚动条完美控制技巧

- 超声波测距尺的源码实现

- 数据可视化与交互:构建易用的数据界面

- 实现Discourse外聘回复自动标记的简易插件

- 链表的头插法与尾插法实现及长度计算

- Playwright与Typescript及Mocha集成:自动化UI测试实践指南

- 128x128像素线性工具图标下载集合

- 易语言安装包程序增强版:智能导入与重复库过滤

- 利用AJAX与Spotify API在Google地图中探索世界音乐排行榜