深度学习:CNN架构分析与优化

需积分: 10 36 浏览量

更新于2024-07-18

收藏 6.98MB PDF 举报

"CNN INTRODUCTION——分析与优化卷积神经网络架构硕士论文,作者Martin Thoma,卡尔斯鲁厄理工学院(FZI)计算机科学研究所,2017年8月"

这篇硕士论文深入探讨了卷积神经网络(CNN)的架构分析与优化,非常适合初学者。卷积神经网络是深度学习领域中的核心模型,广泛应用于图像识别、图像分类、物体检测等视觉任务。论文由Martin Thoma撰写,并得到了R. Dillmann教授和J. M. Zöllner教授的评审。

在论文中,作者可能涵盖了以下关键知识点:

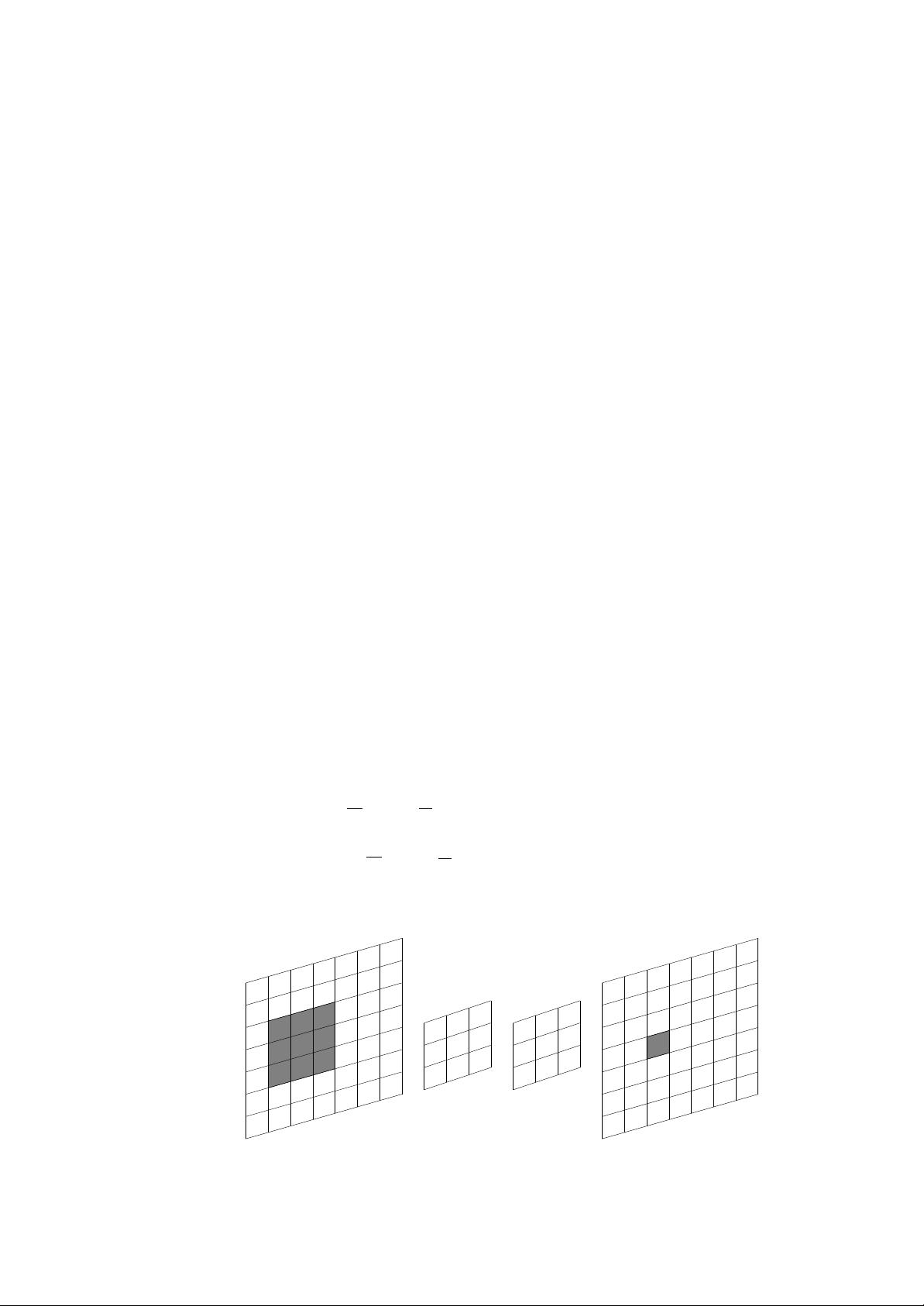

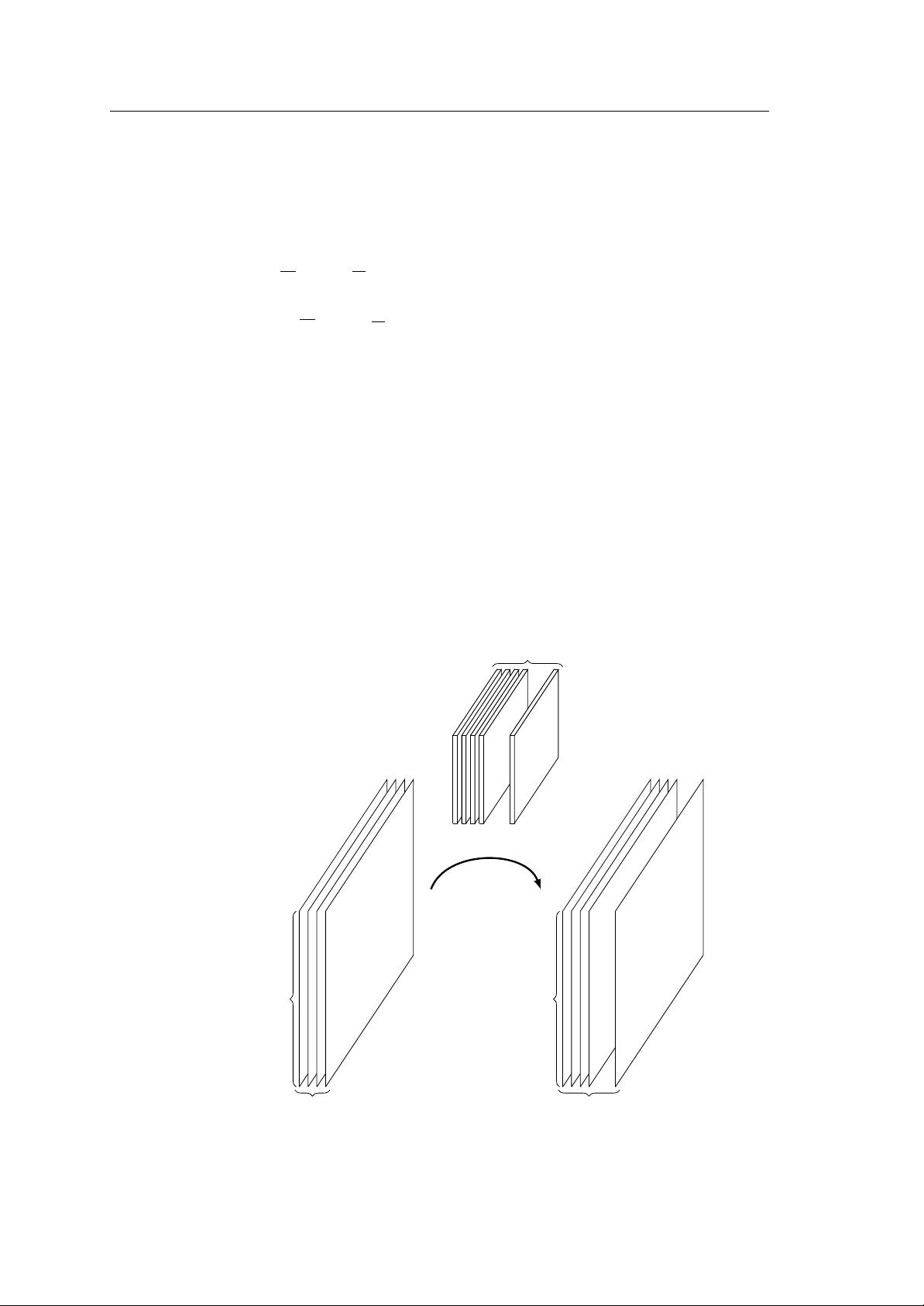

1. **卷积层的理解**:CNN的核心是卷积层,它通过滤波器(或称卷积核)对输入图像进行扫描,提取特征。论文可能详细解释了卷积层的工作原理,包括权值共享、局部连接和池化操作。

2. **激活函数**:激活函数如ReLU、Leaky ReLU、Sigmoid和Tanh在CNN中起到非线性转换的作用,增加了模型的表达能力。论文可能分析了不同激活函数的优缺点及适用场景。

3. **池化层**:池化层用于减小数据尺寸,降低计算复杂度,同时保持关键特征。常见的是最大池化和平均池化,论文可能会讨论它们的作用和影响。

4. **全连接层**:在卷积层之后,通常会接全连接层进行分类或回归。论文可能分析了全连接层的设计选择,如层数、神经元数量等。

5. **超参数优化**:论文可能会涉及如何调整学习率、批量大小、优化器选择(如SGD、Adam)、正则化策略(L1、L2)等超参数,以提升模型性能。

6. **模型深度与宽度**:增加网络深度可以提高模型的复杂度,捕捉更复杂的特征,但可能导致过拟合。宽度则是指每个层次的神经元数量。论文可能探讨了深度和宽度之间的平衡。

7. **残差连接**:ResNet等现代架构引入了残差连接,解决深层网络训练中的梯度消失问题。这可能是论文研究的一部分。

8. **数据增强**:为了防止过拟合并增加模型泛化能力,数据增强技术(如旋转、平移、缩放等)被广泛应用。论文可能讨论了数据增强的方法和效果。

9. **模型压缩与量化**:为了在资源有限的设备上部署CNN,模型压缩(如剪枝、量化)是重要手段。论文可能涉及这些技术及其对性能的影响。

10. **实验设计与评估**:论文可能包含了多个CNN架构的实验对比,使用标准数据集(如MNIST、CIFAR-10、ImageNet)进行验证,并用精度、召回率、F1分数等指标评估结果。

通过阅读这篇论文,初学者将能系统地了解CNN的原理,以及如何通过架构调整来优化模型性能。此外,作者可能还提供了一些实用的建议和技巧,帮助读者在实际项目中应用这些理论知识。

2017-12-06 上传

2021-06-29 上传

2021-04-06 上传

2017-11-14 上传

2017-09-28 上传

2021-03-16 上传

2021-03-30 上传