机器学习实战:逻辑回归及其Python实现

147 浏览量

更新于2024-08-28

1

收藏 820KB PDF 举报

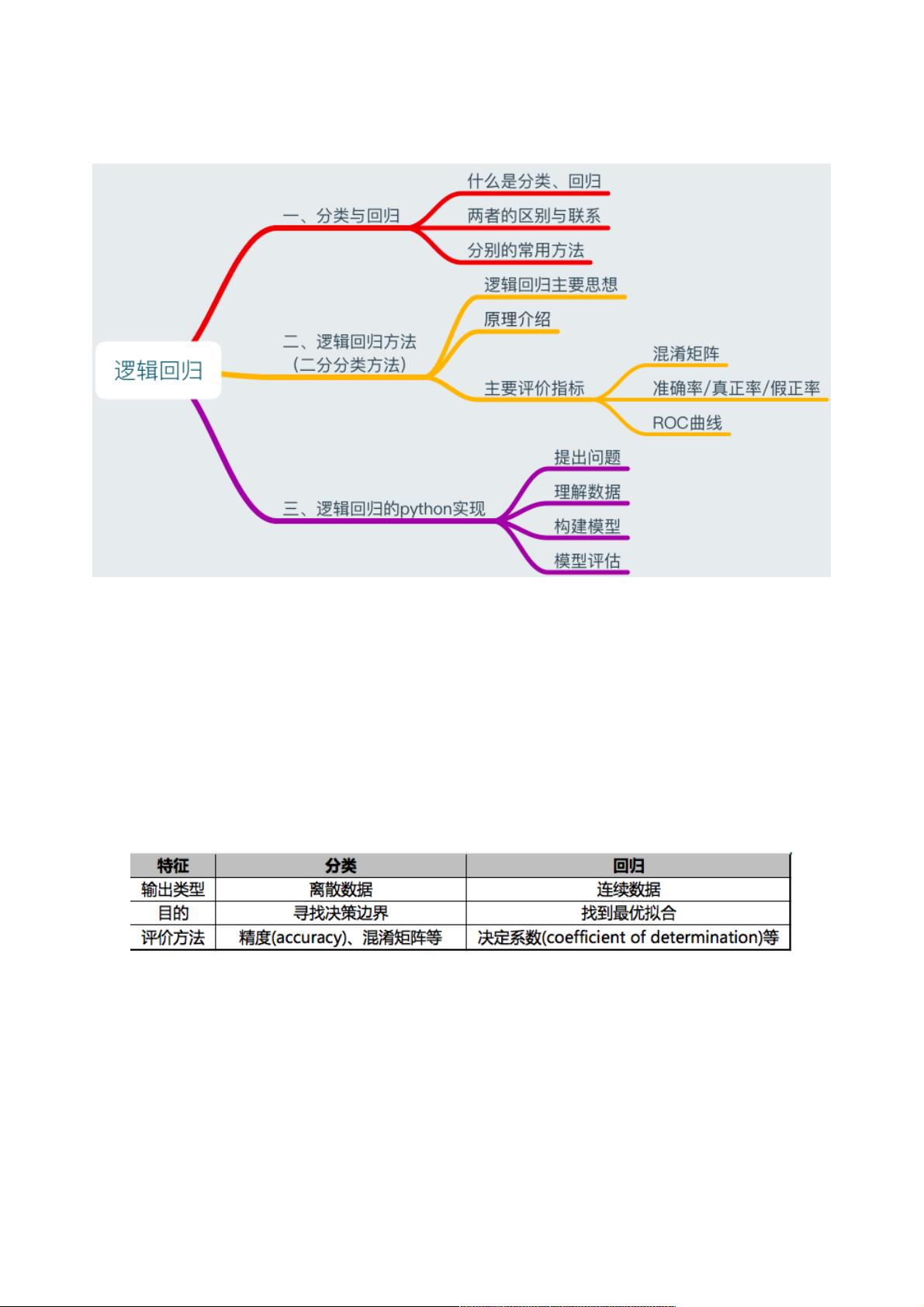

"本文介绍了机器学习中的两种重要方法——回归和分类,特别关注了逻辑回归分析在Python中的应用。文中详细阐述了分类与回归的区别与联系,以及常用的分类和回归算法。此外,还深入探讨了逻辑回归的基本原理和作用。"

在机器学习领域,回归和分类是两种基本的预测技术。回归主要用于处理输入和输出都是连续变量的问题,而分类则是针对输出变量为有限个离散值的情况。两者虽然目标不同,但在预测的本质上有所关联。分类模型可以看作是回归模型的特殊形式,通过对连续输出进行离散化处理,例如通过阈值划分。

逻辑回归是一种广泛应用的分类方法,特别是在二分类问题中。它使用线性回归的输出作为Sigmoid函数的输入,将连续值映射到(0,1)区间,从而形成一个概率预测。对于二分类问题,输出值大于0.5的样本被分配到一个类别,小于0.5的分配到另一个类别。对于多分类问题,可以采用多分类逻辑回归,如Softmax函数,将线性输出转化为每个类别的概率。

逻辑回归的原理主要包括以下几个步骤:

1. 建立决策边界:通过拟合一个回归方程(如线性方程W^X)来确定分类决策边界。

2. Sigmoid映射:将回归方程的连续输出通过Sigmoid函数转换,使得结果在0和1之间,便于进行概率解释。

3. 损失函数与优化:通常使用交叉熵损失函数,并通过梯度下降等优化算法调整权重W,以最小化预测与实际类别之间的差异。

4. 分类决策:基于Sigmoid函数的结果,设定阈值进行类别判断。

Python中,`sklearn`库提供了`LogisticRegression`模型,用于实现逻辑回归。用户可以调整参数,如正则化强度、优化算法、是否进行多分类等,以适应不同的问题需求。

除了逻辑回归,Python中还有多种用于分类和回归的算法。分类方法如决策树、随机森林、KNN、朴素贝叶斯、支持向量机等;回归方法包括线性回归、岭回归、Lasso回归以及多项式回归等。这些模型各有特点,适用于不同类型的预测任务。

在实际应用中,选择合适的模型通常需要考虑数据的特性和问题的需求。例如,如果数据具有线性关系且无明显离群点,线性回归可能是好的选择;当关系非线性或复杂时,决策树或神经网络可能更合适。同时,特征工程、超参数调优以及模型验证也是提高模型性能的关键步骤。

机器学习中的回归和分类是解决不同类型问题的核心工具。理解它们的区别与联系,以及如何利用如逻辑回归这样的算法进行预测,对于有效地运用机器学习至关重要。在Python中,强大的库和工具集使得实现这些算法变得简单易行,为数据科学项目提供了强大支持。

点击了解资源详情

点击了解资源详情

点击了解资源详情

2023-10-21 上传

2022-09-23 上传

2021-01-27 上传

2021-10-03 上传

2017-12-30 上传

2023-12-23 上传

weixin_38564003

- 粉丝: 6

- 资源: 923

最新资源

- DebugThugs:CSSI-CHI-2018最终项目,Blossom,Benny,Abenezer,Nora

- weixin062健身房私教预约系统+ssm(源码+部署说明+演示视频+源码介绍+lw).rar

- WeChat-OAuth:微信OAuth SDK

- Python库 | flask_session_captcha-1.2.1.tar.gz

- rbac:移动了https

- 订单管理系统易语言源码-易语言.zip

- agps.js:JavaScript 中的辅助 GPS

- 创业计划书-精品案例智慧城市商业计划书

- weixin015Vue(源码+部署说明+演示视频+源码介绍+lw).rar

- envoy:观看您的Clojure环境配置。

- JQ8900语音模块资料包

- 基于java实现的龙门物流管理系统(Ext+SSH+毕业设计)130221(源代码+使用说明+论文+毕业设计).rar

- Time:这是个日记APP

- matlab开发-Fortran95接口Matlabapi与其他.zip

- 行业分类-设备装置-多媒体应用中的快速调谐.zip

- DEM-BURGS:DEM BURGS-一个完整的应用程序,链接到MySQL数据库以显示nom可用的burgs,并允许用户nom或添加自己的burgs