LeNet深度解析:卷积神经网络进阶的5种模型

44 浏览量

更新于2024-08-28

收藏 732KB PDF 举报

在《动手学习深度学习》的系列教程中,章节2专门深入探讨了卷积神经网络(CNN)的进阶知识,特别是针对LeNet、AlexNet、VGG、NiN和GooLeNet这五种经典的CNN模型。本节重点关注了LeNet模型,它是CNN早期应用的一个里程碑,用于手写数字识别。

LeNet的设计旨在解决传统全连接层在处理图像数据时的局限性。全连接层的问题在于它不保留输入图像的空间结构,导致相邻像素在向量中距离较远,模型可能难以识别出这些像素之间的模式。此外,当输入图像尺寸较大时,全连接层会显著增加模型的参数数量,导致过大的模型规模和计算复杂度。

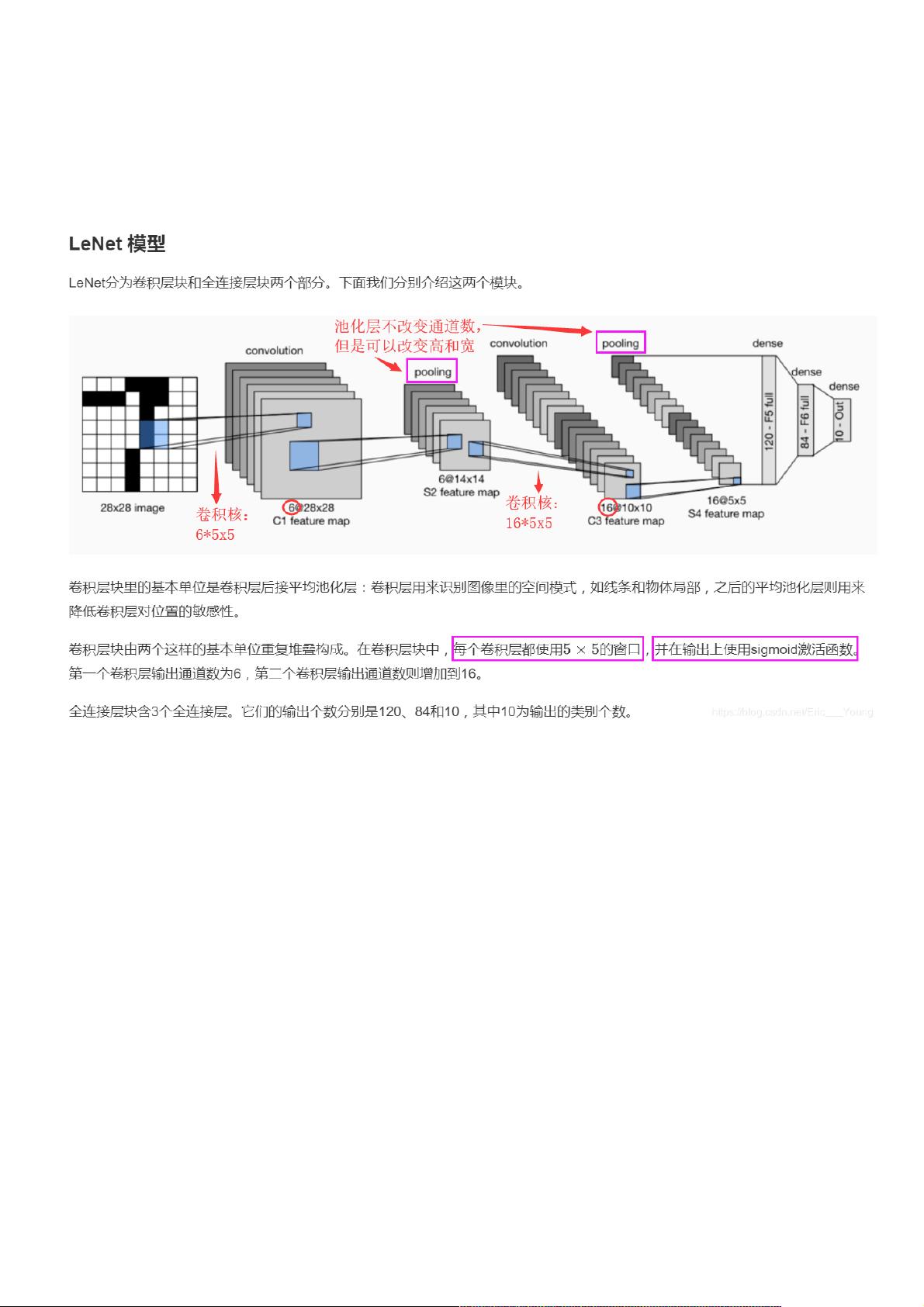

相比之下,卷积层的优势在于其局部连接和权重共享特性。卷积层通过固定大小的卷积核(如LeNet中的5*5)在输入上进行滑动计算,这样不仅保留了原始图像的尺寸,还能有效地减少参数数量。它通过检测图像的局部特征,如边缘、纹理等,使得模型对位置变化有较高的鲁棒性。在LeNet中,卷积层后面通常跟有激活函数(如sigmoid)和池化层(如平均池化),前者增强非线性表达,后者进一步减小数据维度并提高模型效率。

LeNet的结构主要由两部分组成:卷积层块和全连接层块。卷积层块包含一个基础单元,由卷积层、激活函数和池化层交替组成,用于提取和抽象图像特征。全连接层块则负责将卷积层的高维输出转换为分类决策,通过三个全连接层逐级减少节点数,最后输出层的10个节点对应于10个类别。

在实现LeNet时,作者利用了PyTorch库中的Sequential类,先定义了展平和重塑操作,然后构建了卷积层、Sigmoid激活和平均池化层,确保了模型的结构清晰。这些步骤展示了如何将理论知识转化为实际代码,以便于理解和实践。

LeNet作为早期CNN模型的代表,展示了卷积层在图像处理中的核心作用,并为后续更复杂的CNN架构奠定了基础。通过学习LeNet及其工作原理,读者可以深入理解CNN如何处理空间信息,以及如何设计和优化卷积神经网络结构。后续章节可能会探讨其他模型如何在LeNet的基础上进行改进和扩展,以适应更广泛的计算机视觉任务。

weixin_38648968

- 粉丝: 11

最新资源

- JFinal框架下MySQL的增删改查操作教程

- 掌握NetBpm工作流引擎源代码

- HTML编程:lofiLoops项目探索

- 亲测可用的2015年最新快递跟踪插件

- ACM计算几何与数据结构代码解析

- Cypress自动化测试示例与项目设置指南

- Django自定义用户模型:多用户类型支持与工具集

- Dev-Cpp 6.3版本源码压缩包解析

- C#图像压缩工具:轻松优化图片大小

- Eclipse常用JavaScript插件:jsEditor与jsEclipse评测

- Java实现的学生宿舍管理解决方案

- YoduPlayer:一款具备随机播放与皮肤选择的背景音乐播放器

- 学习Android开发,免费健康食物系统源码下载

- 《数据库系统概念》第五版答案解析

- 通过PHPstudy搭建鱼跃cms教程

- 深入理解TUXEDO中间件开发与配置指南