定制数据流AI芯片:CAISA架构的高效与应用

版权申诉

125 浏览量

更新于2024-06-29

收藏 14.04MB PDF 举报

“定制数据流AI芯片技术及应用”

在当前的AI时代,计算能力成为推动技术进步的关键因素,而定制数据流AI芯片正是为了满足这一需求而诞生的技术。AI计算芯片有三个核心要素:算力性价比、软件易用性和架构通用性。这些要素决定了芯片在实际应用中的效能和效率。

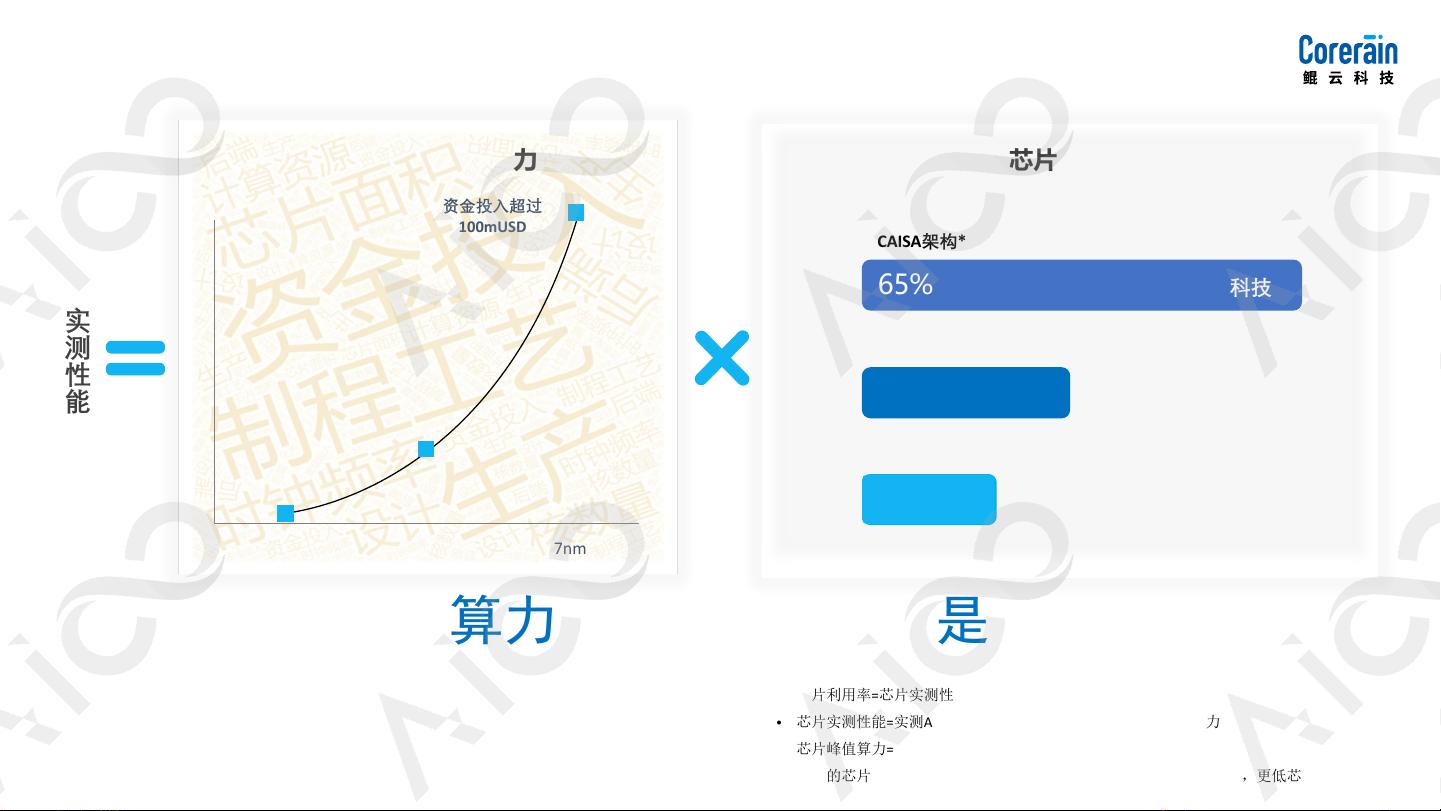

算力性价比是衡量芯片性能的关键指标,它由芯片实测性能与芯片峰值算力的比例决定。芯片利用率越高,意味着在相同成本下可以获得更高的实测性能,或者在达到相同性能时可以降低成本。例如,传统的Tensor架构和Matrix架构芯片利用率通常在20%-40%,而鲲云科技的CAISA架构实现了65%-95.4%的高利用率,显示了其在成本效益方面的优势。

CAISA(CustomAIStreamingAccelerator)架构是定制数据流技术的一大突破,它以高达95.4%的利用率实现了对硬件资源的极致利用,同时保持低至3毫秒的延迟,这使得它非常适合实时应用。CAISA架构的高通用性使其能支持多种主流深度学习算法,而且是基于计算机架构的源头性技术进行开发,增强了架构的通用性。

此外,CAISA架构的三大创新点包括:通用支持卷积神经网络(CNN)算法,时钟级精确的计算,以及流水线动态重组。这些特性确保了芯片能够灵活适应不断变化的AI算法需求。更重要的是,通过端到端自动化工具,算法可以自动化部署到芯片上,极大地提高了软件易用性。

全球首款数据流AI芯片CAISA,采用28纳米制程工艺,具有10.9TOPS的峰值算力,并支持INT8计算精度。这款芯片设计用于数据中心和边缘端的AI推断,能够在-40℃到125℃的温度范围内稳定工作。基于CAISA芯片,鲲云科技推出了如星空X3加速卡、星空X6A边缘小站和星空X9加速卡等一系列高性能计算平台,满足不同场景下的AI计算需求。

定制数据流AI芯片技术,特别是CAISA架构,通过优化芯片利用率、提高软件易用性和增强架构通用性,为AI领域的计算性能带来了革命性的提升,不仅在性能上实现了显著优化,还在成本控制和应用灵活性方面树立了新的标准。这种技术的应用将广泛覆盖从云端数据中心到边缘计算的各种场景,推动AI技术更深入地融入我们的日常生活和工作中。

点击了解资源详情

点击了解资源详情

点击了解资源详情

2021-07-26 上传

2021-10-26 上传

2019-07-27 上传

2021-07-26 上传

2021-07-10 上传

2021-10-25 上传

每天读点书学堂

- 粉丝: 1041

- 资源: 1万+

最新资源

- MATLAB实现小波阈值去噪:Visushrink硬软算法对比

- 易语言实现画板图像缩放功能教程

- 大模型推荐系统: 优化算法与模型压缩技术

- Stancy: 静态文件驱动的简单RESTful API与前端框架集成

- 掌握Java全文搜索:深入Apache Lucene开源系统

- 19计应19田超的Python7-1试题整理

- 易语言实现多线程网络时间同步源码解析

- 人工智能大模型学习与实践指南

- 掌握Markdown:从基础到高级技巧解析

- JS-PizzaStore: JS应用程序模拟披萨递送服务

- CAMV开源XML编辑器:编辑、验证、设计及架构工具集

- 医学免疫学情景化自动生成考题系统

- 易语言实现多语言界面编程教程

- MATLAB实现16种回归算法在数据挖掘中的应用

- ***内容构建指南:深入HTML与LaTeX

- Python实现维基百科“历史上的今天”数据抓取教程