机器学习入门:十大经典算法详解

版权申诉

92 浏览量

更新于2024-06-25

收藏 2.65MB PDF 举报

本文档是一份关于机器学习中十大常用算法的通俗易懂介绍,旨在帮助读者对这些算法有一个基本的认识,无需深入到复杂的编程或理论推导,而是通过图解方式展示算法的工作原理和应用场景。主要关注于分类问题,以下是详细介绍的几种算法:

1. 决策树:这是一种通过一系列问题对数据进行分类的方法,每个节点根据特征提出问题,数据根据答案沿着树结构向下流动,最终到达一个叶子节点,决定其类别。决策树是基于历史数据学习决策规则的模型。

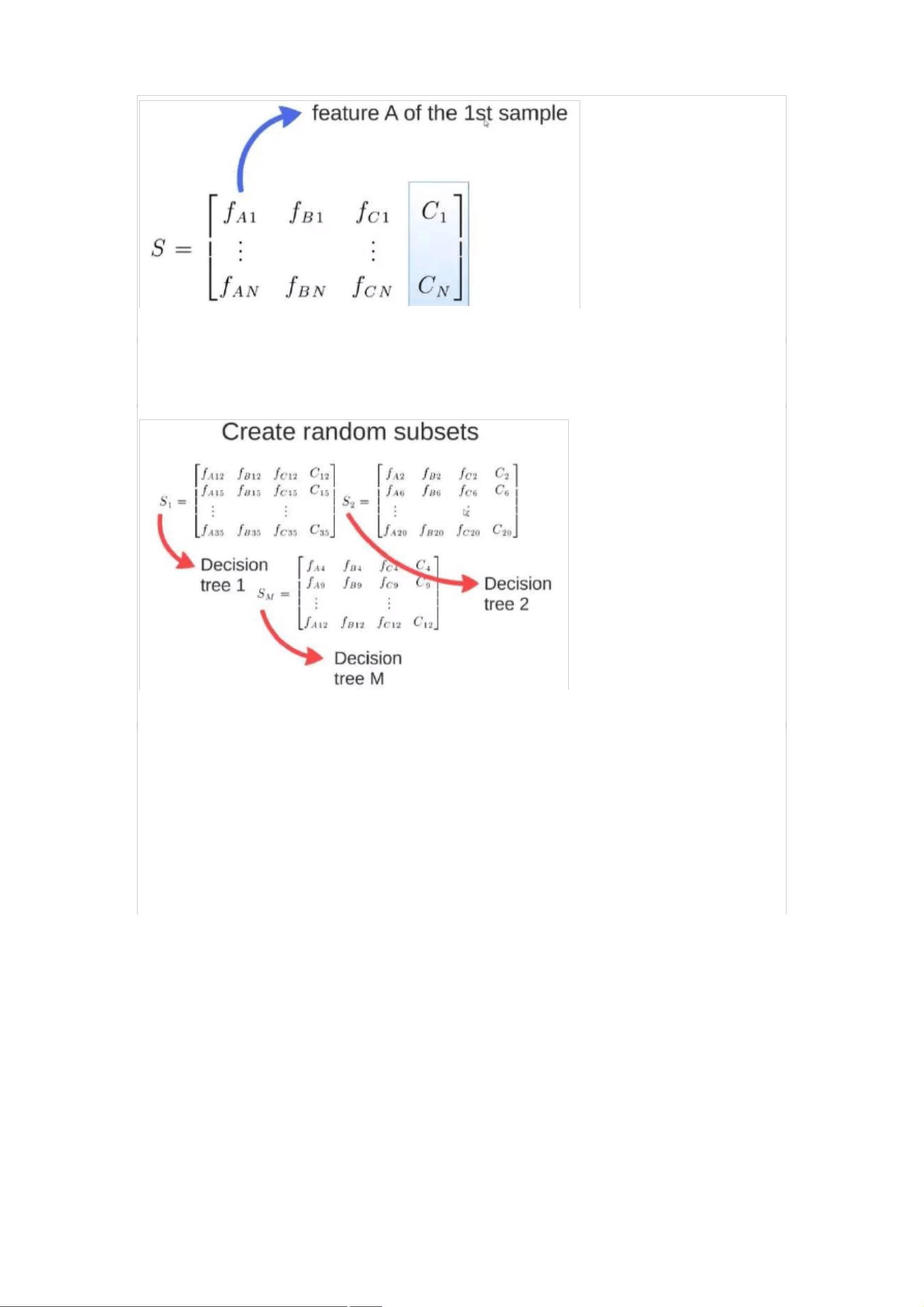

2. 随机森林:此算法由多个决策树组成,通过在源数据中随机选择部分样本和特征来创建多个子树。新数据通过所有子树的分类结果投票决定最终类别,增加了模型的稳定性和准确性。

3. 逻辑回归:用于处理概率预测问题,特别适用于目标变量需要满足0到1范围内的情况。逻辑回归通过指数函数确保输出大于0,同时利用除法和分母加1保证输出小于等于1,从而形成S型曲线模型。模型参数通过源数据训练得到。

4. 支持向量机 (SVM):这是一种二分类模型,目标是找到一个最优的超平面,使得两类数据点之间的间隔(称为margin)最大化。超平面被表示为一个线性方程,通过最小化误差边界,使得不同类别的数据点与超平面的距离尽可能远。

其他算法包括:

5. 朴素贝叶斯:基于贝叶斯定理的一种简单概率分类方法,假设特征之间相互独立,适用于文本分类等场景。

6. K最近邻算法 (KNN): 根据测试样本与训练集中其他样本的距离,将其归类为最接近的K个邻居所属的类别。

7. K均值聚类:一种无监督学习方法,将数据集划分为K个簇,每个簇包含距离最近的数据点。

8. AdaBoost算法:集成学习方法,通过动态调整各个弱分类器的权重,组合成强分类器,提高整体性能。

9. 神经网络:模仿人脑神经元结构的模型,可以解决复杂的非线性问题,通过多层节点和权重调整进行学习。

10. 马尔可夫链:用于处理序列数据的概率模型,常用于自然语言处理和推荐系统等领域。

这份文档提供了对以上算法概念的简明解释,但如需深入了解每个算法的细节,可能需要进一步阅读相关的深入教程或研究文献。

1768 浏览量

3478 浏览量

7013 浏览量

2023-05-31 上传

1939 浏览量

454 浏览量

2024-02-23 上传

2021-09-28 上传

2021-09-26 上传

hhappy0123456789

- 粉丝: 77

最新资源

- 89C51单片机控制的自动加料机系统设计

- DB2 730模拟题:查询优化与数据库管理基础

- STICS:SCSI-to-IP缓存加速存储区域网络

- iSCSI Extensions for RDMA: A Performance Enhancing Protocol Study

- iCache:一种提升iSCSI性能的缓存策略

- Inno Setup 5.0.7中文帮助:免费Windows安装程序制作利器

- Java面试必备:面向对象、String与Integer的区别

- 摄像机线性标定简化处理:考虑畸变的高效方法

- 企业数据保护存储:未来趋势与经济损失预防

- 优化MySQL性能:High Performance MySQL 第二版精华

- 嵌入式系统硬件构成详解与开发技术

- 8051单片机C编程实战指南

- Windows服务器从SAN启动技术详解

- GridView 删除操作与警告对话框实现

- 关键任务应用与存储整合服务管理的重要性

- 提升代码可读性:华为软件编程规范解析