"深度学习-从感知器到LSTM(目的是处理序列问题)"

本文旨在从基础知识开始,逐步讲解深度学习中的重要概念,最终引出LSTM,并将其应用于分词和词性标注任务。我们将从感知器出发,通过一系列概念的递进来理解深度学习的核心。

1. 感知器(Perception)

感知器是最早期的神经网络模型之一,它基于简单的线性分类。感知器的工作原理是通过调整权重来区分输入样本,以达到正确分类的目的。在训练过程中,如果样本被正确分类,则权重保持不变;反之,若分类错误,权重会根据一定的学习率和样本特征进行调整。尽管感知器无法解决非线性可分问题,如异或运算,但它为理解更复杂的神经网络打下了基础。

2. 全连接网络与线性单元

感知器是全连接网络的一个特例,其中每个神经元都与其他神经元相连。线性单元是感知器的基础,它们的激活函数通常是阶跃函数,简单地将输入转换为二进制输出。然而,这样的模型受限于线性可分性,无法处理更复杂的数据结构。

3. 梯度下降与反向传播

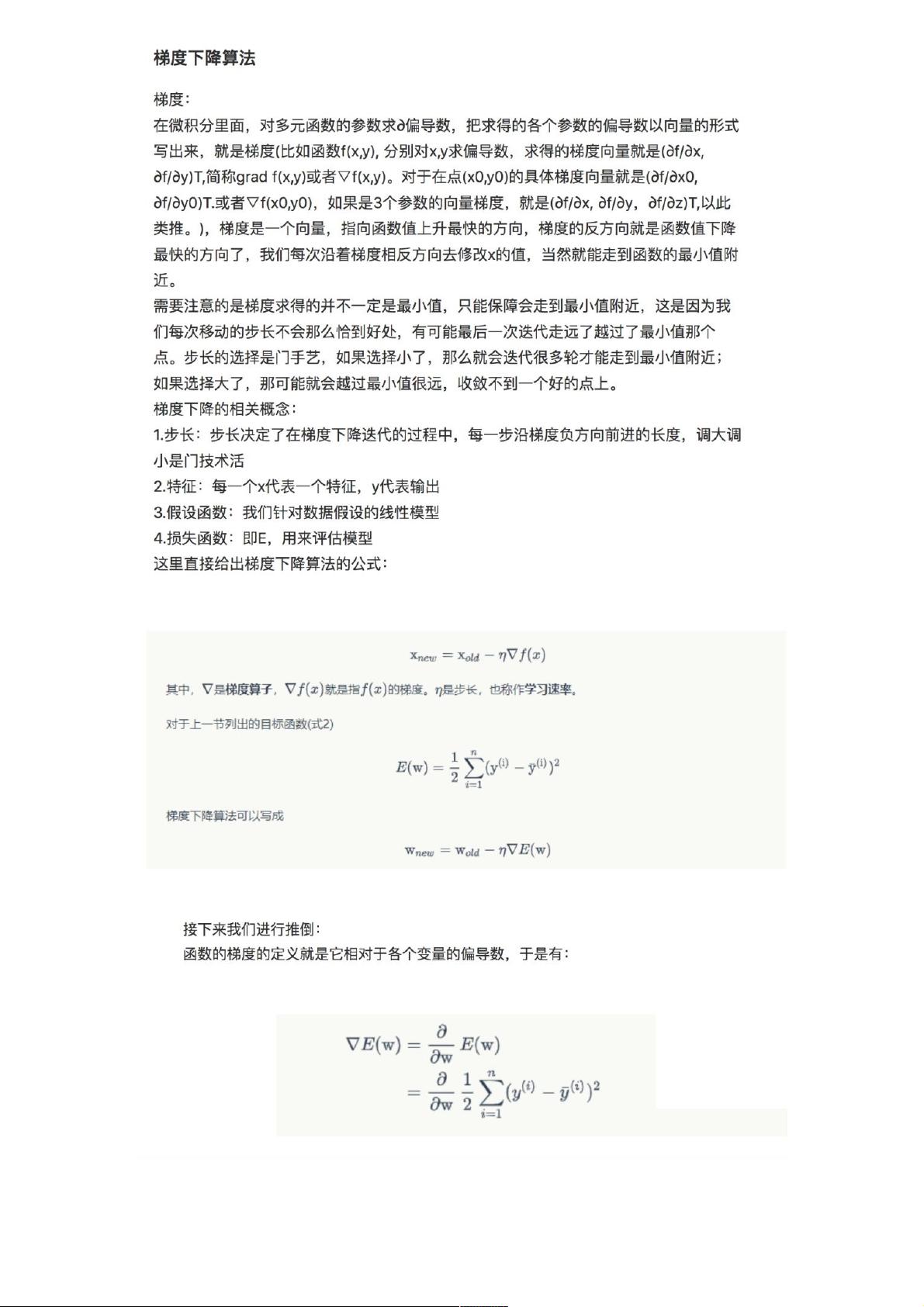

为了适应非线性问题,我们引入了更复杂的激活函数,如Sigmoid或ReLU,这导致了线性模型的扩展。梯度下降是优化权重的主要方法,通过计算损失函数相对于权重的梯度来更新权重。反向传播算法进一步发展了这一思想,它允许我们同时更新所有层的权重,使得网络能解决非线性问题。

4. 循环神经网络(RNN)

为了处理序列数据,如语言,我们使用循环神经网络。RNN的特点是其记忆单元,它们可以捕捉时间序列中的依赖关系。然而,标准RNN在长期依赖问题上存在梯度消失或爆炸的问题。

5. 长短期记忆网络(LSTM)

为了解决RNN的问题,LSTM网络被提出。LSTM包含门控机制,如输入门、遗忘门和输出门,它们有效地控制了信息流,避免了梯度消失,从而更好地处理长距离依赖。

6. LSTM-CRF

在词性标注等序列标注任务中,LSTM常与条件随机场(CRF)结合,形成LSTM-CRF模型。CRF允许考虑全局最优的标签序列,而不仅仅是单个时间步的预测,提高了序列标注的准确性。

总结来说,本文从最基础的感知器开始,逐步介绍了深度学习的关键概念,包括全连接网络、梯度下降、神经网络的反向传播,以及循环神经网络的演化,最终落脚在处理序列问题的LSTM和LSTM-CRF模型。通过这样的递进学习,读者可以逐步理解深度学习的内在逻辑,并掌握如何将这些知识应用到实际的序列处理任务中。