解析深度学习黑盒:CNN卷积层工作原理与设计揭秘

16 浏览量

更新于2024-08-30

收藏 2.37MB PDF 举报

本文是机器学习系列中的第12部分,专门讲解卷积神经网络(Convolutional Neural Network, CNN)的第二部分。在深度学习领域,由于模型复杂性高,许多人将CNN比喻为“黑盒子”,因为它在处理图像和数据时的内部工作原理不易直观理解。文章针对三个核心问题进行探讨:

1. **理解CNN的工作机制(What does CNN do?)**:作者首先强调,尽管CNN可能看起来像是个黑盒,但可以通过特定方式去分析。第一层的卷积核(filter)相对直观,每个3x3的滤波器对应于图像中的9个像素,可以直接观察其权重来理解它检测的特征。

2. **为何选择CNN(Why CNN?)**:文章提到,CNN之所以被选择,是因为它能够自动提取输入数据中的特征,并且对空间关系敏感。它在视觉任务中表现出色,如图像分类和识别。然而,为了保持“智能”(intelligence),CNN的深层次结构和抽象特征使得其决策过程难以完全理解,这正是其“黑盒”特性的一部分。

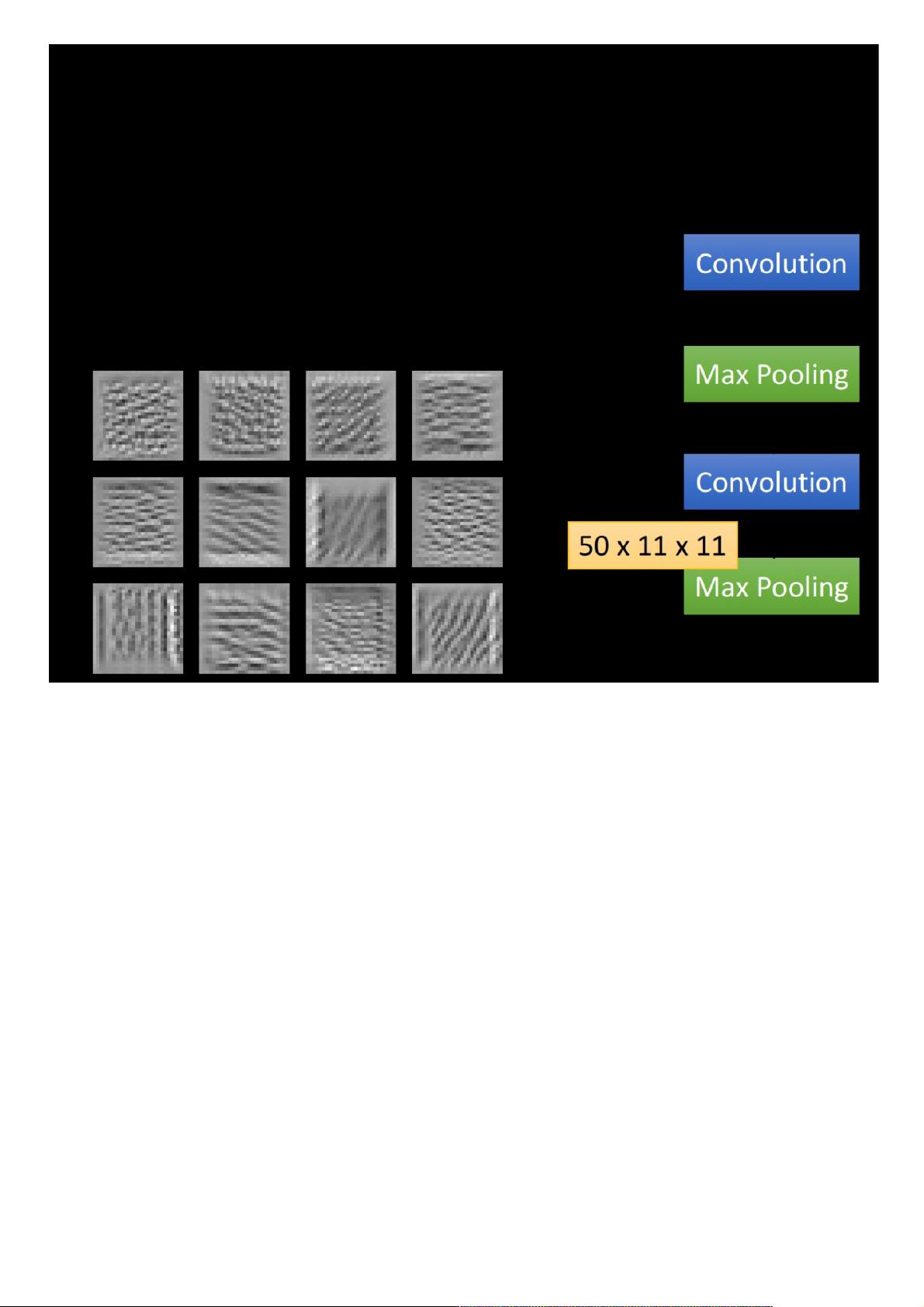

3. **设计CNN的策略(How to design CNN?)**:设计CNN时,需要考虑层数、滤波器数量、大小以及池化操作等因素。对于深层滤波器,它们处理的是经过前一层卷积和池化的特征图,这使得它们的解释更为复杂,因为每个滤波器看到的特征区域远大于单个像素。

4. **分析CNN的学习内容(What does CNN learn?)**:要理解深层滤波器的功能,可以通过观察它们输出的特征图来间接推断。例如,通过查看第k个滤波器输出的11x11矩阵,可以尝试理解它在图像中的响应模式,尽管具体功能可能不易直接解读。

本文旨在打破CNN的神秘感,提供一些基本的分析方法,帮助读者理解即使是最深层次的滤波器,也并非完全不可捉摸。通过这种分析,虽然不能完全揭示CNN的所有决策逻辑,但至少可以让我们对模型的部分运作有更深入的认识。

203 浏览量

203 浏览量

123 浏览量

2021-09-25 上传

2021-09-26 上传

166 浏览量

2011-07-01 上传

weixin_38537050

- 粉丝: 7

- 资源: 954

最新资源

- NCRE二级C语言程序设计辅导

- basic linux command

- Java笔试时可能出现问题及其答案.doc

- 同济大学线性代数第四版课后习题答案

- A Guide to MATLAB for Beginners and Experienced Users - Hunt Lipsman & Rosenberg

- Oracle9i:SQL Ed 2.0.pdf

- ejb3.0实例教程

- oracle-commands-zh-cn

- inno setup 脚本集

- IT服务能力成熟度模型

- PCB转原理图方法攻略

- PHP登录注册制作过程

- 硬件工程师手册_华为资料

- 神奇的-----ant的使用

- XILINXSPARTAN_start_kit_3manual.pdf

- R1762_R2632_R2700 RGNOS10.2配置指南_第一部分 基础配置指南