Coursera机器学习课程笔记:从线性回归到逻辑回归

需积分: 9 29 浏览量

更新于2024-07-25

收藏 2.46MB PDF 举报

"这是一份来自Coursera课程的机器学习笔记,由Andrew NG教授讲解,由Yuval W整理。笔记涵盖了机器学习的基础概念、监督学习、无监督学习、线性回归(包括单变量和多变量)、梯度下降、线性代数、逻辑回归以及正则化等内容。"

在《机器学习笔记》中,首先介绍了机器学习的基本定义。机器学习是人工智能的一个分支,其目标是让计算机通过经验学习和改进,而无需显式编程。笔记详细阐述了两种主要的学习类型:监督学习和无监督学习。

监督学习是机器学习中的一种常见方法,它涉及到通过已标记的训练数据来预测未知数据的输出。在笔记中,线性回归作为监督学习的一个例子被深入探讨。线性回归模型用于预测连续变量,其核心是模型表示、成本函数和梯度下降算法。模型表示是建立输入与输出之间关系的线性方程;成本函数衡量模型预测的误差;梯度下降是一种优化算法,用于最小化成本函数,以找到最佳的模型参数。

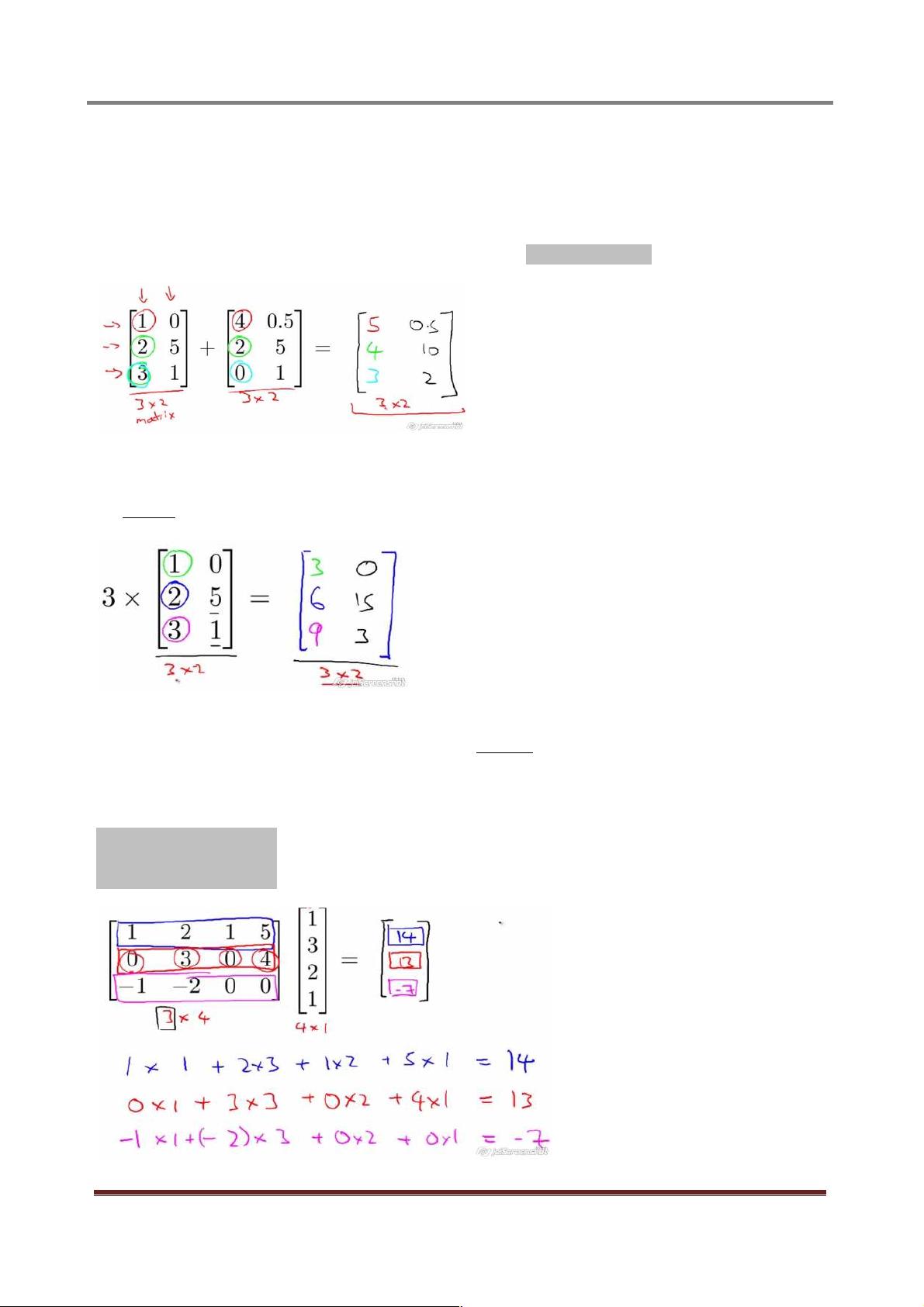

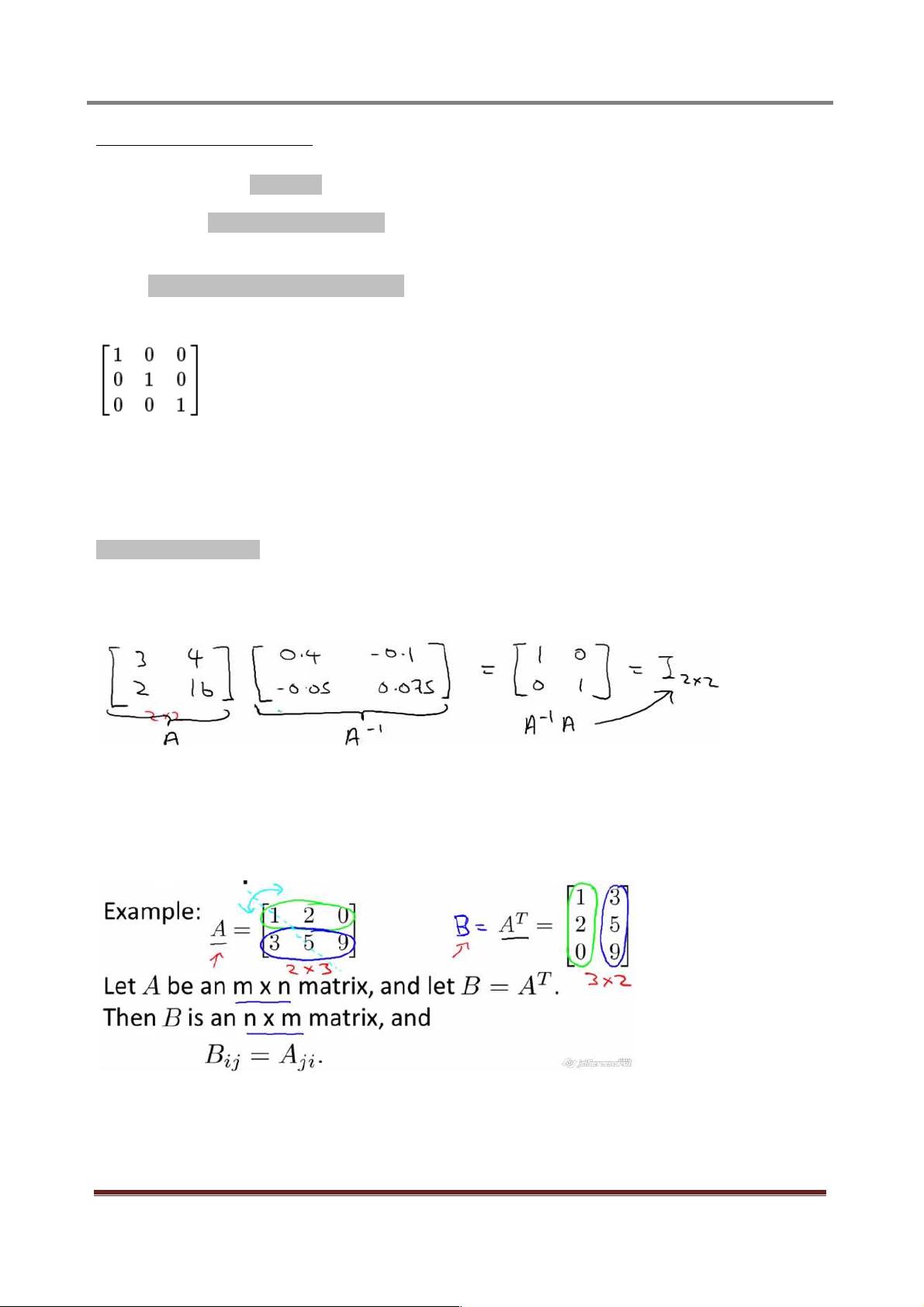

线性代数部分涵盖了矩阵的加法、标量乘法、矩阵向量乘法、矩阵矩阵乘法、矩阵的逆以及矩阵转置等基本概念,这些都是理解线性回归和后续高级机器学习算法的基础。

笔记接着讨论了多变量线性回归,增加了处理多个特征的能力。为了有效地应用梯度下降,进行了特征缩放和调整学习率的实践建议。此外,笔记还介绍了多项式回归,以处理非线性关系,并引入了正常方程,作为求解线性回归问题的另一种方法,它避免了迭代过程。

逻辑回归是用于分类问题的监督学习算法,笔记中详细描述了分类问题的建模、决策边界、成本函数以及多类分类。这里还涉及到了正则化,它是防止过拟合的重要技术,通过在成本函数中添加惩罚项来限制模型复杂度。

这份笔记提供了一个全面的机器学习入门指南,涵盖了从基础理论到实际应用的关键概念,适合对机器学习感兴趣的初学者和Coursera课程的学生参考学习。

2023-12-30 上传

124 浏览量

179 浏览量

CHENMING321

- 粉丝: 6

- 资源: 2

最新资源

- 电路板级的电磁兼容设计

- 计算机常用术语英汉互译

- Oracle 程序员开发指南

- 开发项目管理PPT,Project+Management+Of+RD

- Hacker Defender ROOKIT木马检测工具源码

- 3DGame.pdf

- ARM GEC2410实战手册

- 2 小时玩转 iptables 企业版 v1.5.4

- Apache2_httpd.conf_中文版

- Oracle DBA 心得

- Lucene in Action 中文版(PDF)

- IBM首席技术专家选择智慧的地球-IBM中国研究院院长李实恭博士

- JSF快速入门,简单应用

- Java的验证表单大全。

- GDB使用手册,初学者使用

- ajax开发简略,ajax的简略介绍及说明。