Journal of Frontiers of Computer Science and Technology 计算机科学与探索 2020, 1 4(3)

式中的求和部分等价于求解一次交叉相关。

b

为偏

差量,

Z

l

和 Z

l

表示第

l

层的卷积输入和输出,也

被称为特征图,

L

l

为 Z

l

的尺寸,这里假设特征图长

宽相同。

Zij

对应特征图的像素,

k

为特征图的通道

数,

f

、

s

和

p

是卷积层参数,对应卷积核大小、卷积步

长(strid e)和填充(padding)层数。

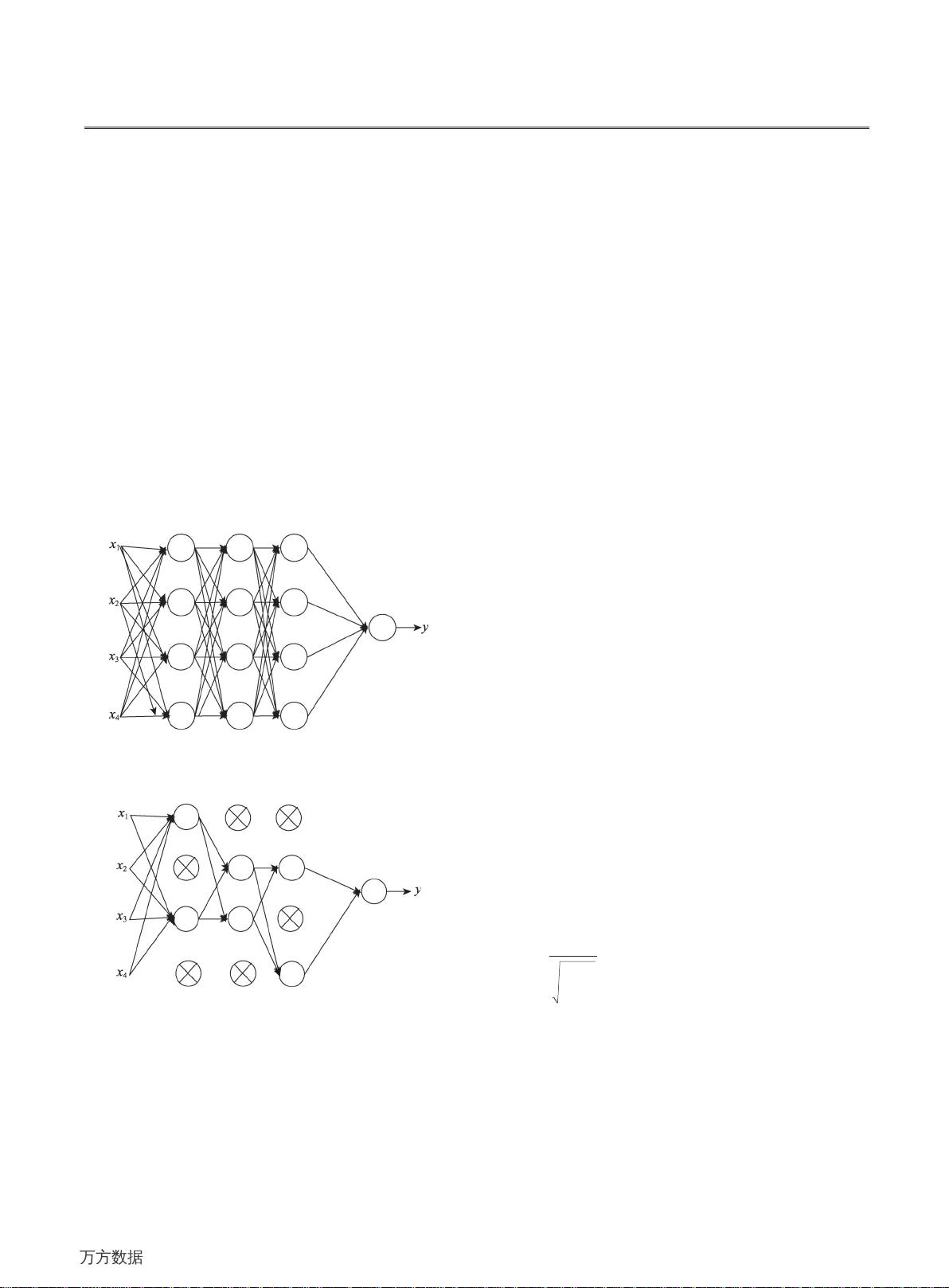

(2)dropout 正则化方法

dropout 层是通过遍历神经网络每一层的节点,

然后通过对该层的神经网络设置一个节点保留概率

p

,即该层的节点有

p

的概率被保留,

p

的取值范围

在 0 到 1 之间。通过设置该层神经网络的节点保留

概率,使得神经网络不会偏向于某一个节点(因为该

节点有可能被删除),从而使得每一个节点的权重不

会过大,来减轻神经网络的过拟合。标准网络如图 1

所示,带有 dropout网络的如图 2所示。

在训练模型阶段,训练网络的每个单元都要添

加 一 道 概 率 流 程 。 没 有 采 用 dropout 方 法 的 如 式

(2)。预测的时候,每一个单元的参数要预乘以

p

。

ì

í

î

ï

ï

Z

i

l

w

l

i

y

l

b

l

i

y

l

i

f z

l

i

(2)

采用 drop out 网络的如式(3)。

ì

í

î

ï

ï

ï

ï

ï

ï

ï

ï

r

l

j

Bernoullip

y

l

r

l

y

l

z

l

i

w

l

i

y

l

b

l

i

y

l

i

f z

l

i

(3)

(3)激活函数

ReLU 函数如式(4),当

x

<0 时,随着训练的推

进,部分输入会落入硬饱和区,导致对应权重无法更

新。故针对

x

<0 的硬饱和问题,采用 Leaky ReLU 函

数,函数如式(5)。

ReLUx

{

x

xx

(4)

LeakyReLUx

{

axx

xx

(5)

使用 Leaky ReLU 优于 ReLU 的优点是:ReLU 是

将所有的负值都设为零,相反 Leaky ReLU 中,

a

是一

个很小的常数,这样保留了一些负轴的值,使得负轴

的信息不会全部丢失。这就解决了 ReLU 函数进入

负值区间后,导致神经元不学习的问题。

2.2 局部特征提取

SIFT 特征在旋转、尺度缩放、亮度等情况下可以

保持不变性,因此对于每个图像,采用尺度不变特征

变换(SIFT)从人脸图像中提取关键点。定位关键点

后,利用关键点相邻的像素点计算网格的方向和大

小。为了识别主方向,建立梯度直方图。最后,SIFT

描述符通过将图像分割成 4×4 个正方形来确定。对

于每一个正方形中的 16 个方块,采用一个长度为 8

的向量来表示。通过合并所有的向量,得到每个关

键点的大小为 4×4×8=128 的特征向量,最后进行归一

化处理。如式(6)所示。

ì

í

î

ï

ï

ï

ï

ï

ï

ï

ï

W w

w

w

L l

l

l

l

j

w

j

i

w

j

j

(6)

3 CNN- SIFT-AVG 模型

3.1 CNN 网络模型结构

本文的网络模型结构的输入层是像素为 48×48

的灰度图像,即为 1 的单通道图像,故输入的图像维

度用 48×48×1 来表示。卷积层是一个 3×3 的过滤器

(filter),为了保持输入输出规格的空间大小不变,在

Fig.1 Sta ndard neural network

图 1 标准的神经网络

Fig.2 Part of temporarily deleted neurons

图 2 部分临时被删除的神经元

484