Android多媒体系统解析:OpenCore与框架结构

需积分: 10 10 浏览量

更新于2024-07-25

收藏 805KB PDF 举报

"09_Android的多媒体系统涵盖了多媒体系统的结构、各层次的解析以及核心组件OpenCore的介绍。"

在Android系统中,多媒体功能的实现是一个复杂而全面的体系,涉及多个层次和组件的协作。首先,让我们深入理解多媒体系统的结构。

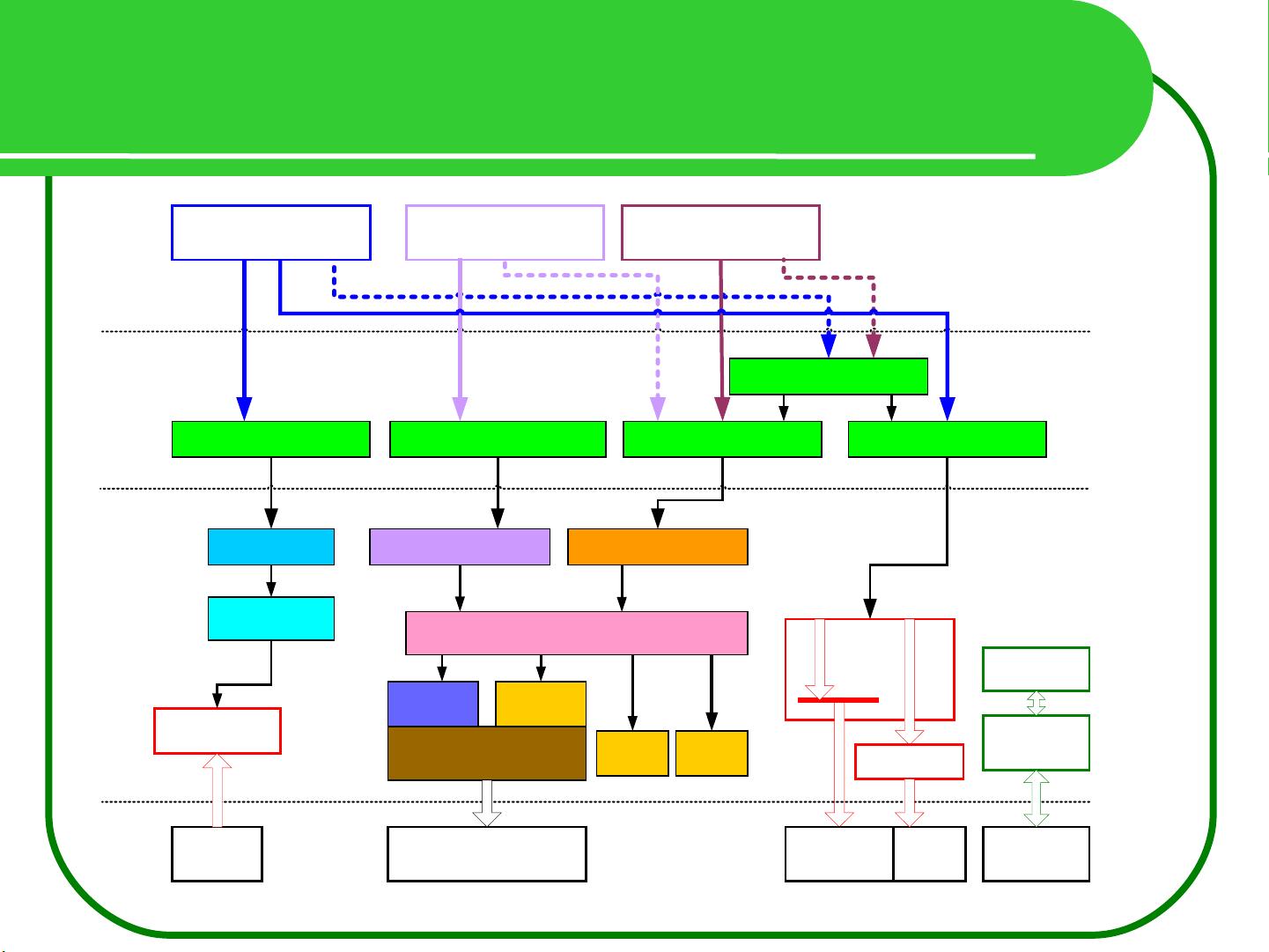

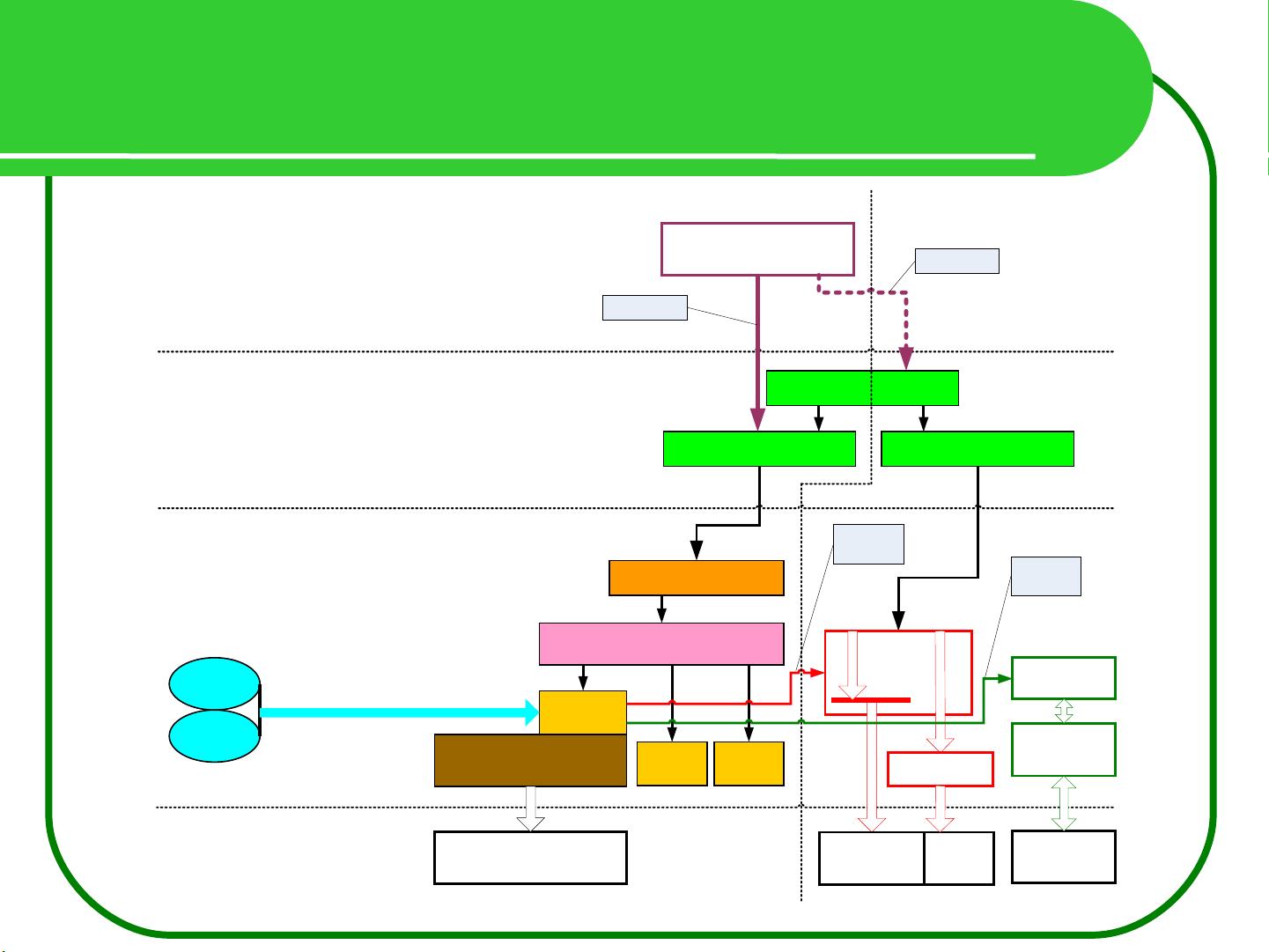

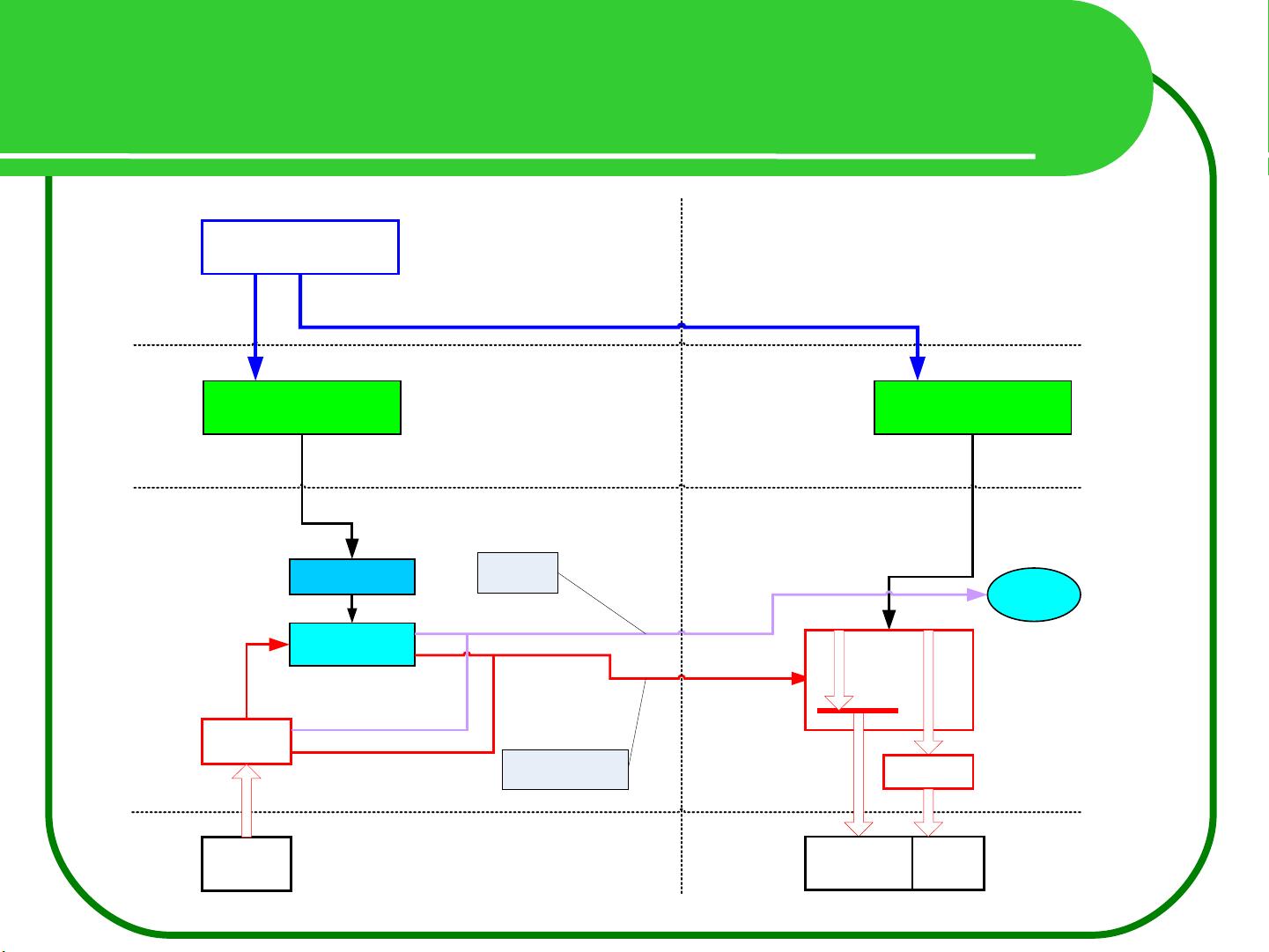

Android的多媒体系统架构分为几个关键层次:应用层、JAVA框架、C语言框架(也称为Native层)以及硬件抽象层(HAL)。应用层是用户直接交互的部分,包括MusicPlayer、VideoPlayer、Camera、SoundRecorder、Camcorder和VideoTelephone等应用程序。这些应用通过JAVA框架与系统服务进行通信。

JAVA框架包含MediaService、MediaAPI、MediaJNI以及一系列的Java类,如MediaPlayer和MediaRecorder。MediaService提供了多媒体服务接口,例如IMediaPlayer和IMediaRecorder,用于控制播放和录制。MediaJNI是Java与Native代码之间的桥梁,它使得Java类能够调用底层的C/C++实现,如libmedia和libmediaplayerservice。

在Native层,libmedia库处理大部分的媒体操作,包括音频和视频的数据流输入输出。libmediaplayerservice库则专注于多媒体服务的实现。此外,OpenCore是Android多媒体系统中的核心组件,它包含了PVPlayer和PVAuthor,负责多媒体文件的播放和编码。

OpenCore是一个跨平台的多媒体框架,它提供了对多种音频和视频格式的支持,包括编解码功能。OpenCore处理文件格式解析,以及编解码过程,这些通常涉及到硬件加速,以提高性能和效率。OpenCore的源代码位于external/opencore目录下,这部分代码编译后形成系统的一部分。

多媒体系统的输入输出环节主要由硬件抽象层实现,它处理音频和视频信号的捕获和输出。而中间处理环节,即编解码过程,主要由PacketVideo组件来完成,PacketVideo可能利用硬件加速来提高效率,尤其是在处理复杂的编码标准如H.264或AAC时。

从应用开发的角度来看,开发者需要关注输入输出系统(如音频、视频数据流的读写)以及文件格式和编解码处理。例如,对于MP3文件的播放,应用层会调用MediaPlayer API,通过JNI接口传递到Native层的libmedia,然后libmedia与HAL交互,完成音频数据的读取和解码,最后通过硬件或软件解码器播放音频。

Android的多媒体系统是一个复杂而精细的架构,它融合了Java和Native代码,利用硬件抽象层实现设备的兼容性,并依赖于OpenCore等核心组件来处理多媒体内容的处理和播放。这一系统设计确保了Android设备能提供丰富的多媒体体验,同时也为开发者提供了灵活且功能强大的编程接口。

点击了解资源详情

点击了解资源详情

点击了解资源详情

2022-09-22 上传

2021-09-29 上传

2022-09-24 上传

2022-09-24 上传

2022-09-19 上传

2021-10-01 上传

simina0

- 粉丝: 0

- 资源: 6

最新资源

- TriviaGameNativescript:TriviaGameNativescript是一个用NativeScript编写的示例项目

- react-rails-form-helpers:用于编写针对Rails的表单的组件

- 易语言MakePL源码,易语言Play源码,易语言AVI制作播放

- 流浪动物救助服务网站设计与实现(J2EE).zip

- Digitoo-crx插件

- 一个基于 Scrapy 的爬虫实现租房信息聚合分析-python

- hyperHTML-Element:可扩展类,用于定义基于hyperHTML的自定义元素

- nativescript-azure-storage:适用于NativeScript的Azure存储

- streaming-kings

- pyonesonehmoo

- 易语言f_in_box封装演示

- Credit_Risk_aNALYSIS

- Plugins_Toast:Toast 插件允许您显示本机文本弹出窗口

- jll_java_扫描线种子算法;_填充区域;_

- skribbl-io-autodraw:Chrome扩展程序,可在虚拟游戏skribbl.io中自动绘制图像

- awesome-nlprojects:与自然语言处理(NLP)相关的项目列表,这些项目因其存在而令人讨厌