朴素贝叶斯方法详解:分类与参数估计

需积分: 10 134 浏览量

更新于2024-07-17

收藏 1.05MB PDF 举报

朴素贝叶斯法是一种基于贝叶斯定理和特征条件独立性假设的机器学习算法,它在人工智能和数据挖掘领域广泛应用。该方法起源于古典数学理论,以它的简洁性和高效性著称,尤其适用于文本分类、垃圾邮件过滤和推荐系统等场景。

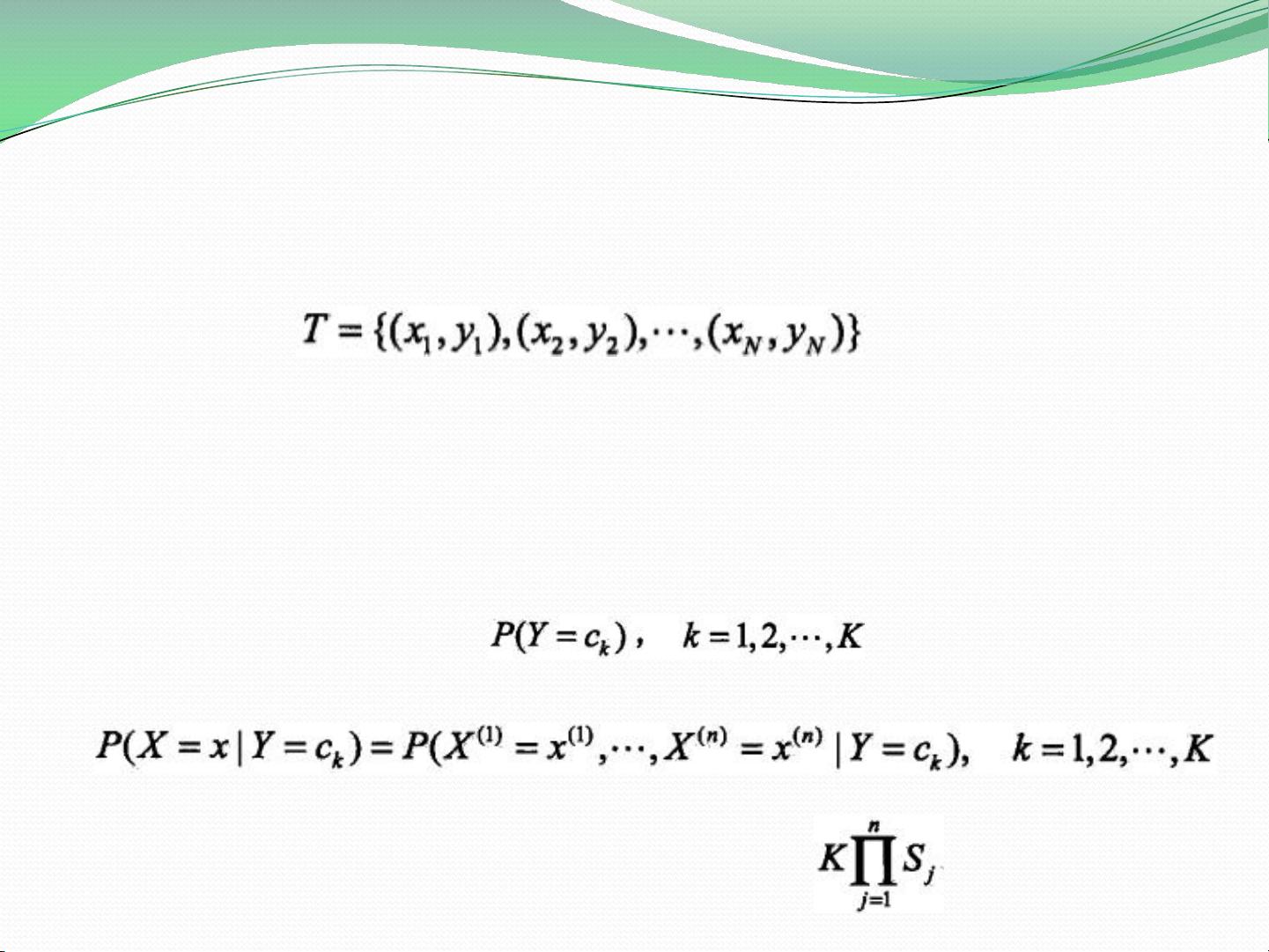

朴素贝叶斯模型的学习与分类过程主要围绕以下几点展开:

1. 基本方法:朴素贝叶斯算法假设特征之间相互独立,这被称为“朴素”假设。它通过训练数据集,学习联合概率分布P(X,Y),包括先验概率分布P(Y=ck)和条件概率分布P(x|Y=ck),其中ck表示类别的标签。条件概率被假设为指数形式,便于计算。

2. 后验概率最大化:朴素贝叶斯分类器的核心原理是利用贝叶斯定理,将新实例分配给后验概率最大的类别。这种方法等价于期望风险最小化,其中使用的是0-1损失函数。通过最大化后验概率,可以得到最有可能的类别预测。

3. 参数估计:算法使用极大似然估计法来估计概率参数。先验概率P(Y=ck)通过训练集中各类别样本的数量计算得出,而条件概率P(x(j)|Y=ck)则基于各特征在不同类别下的频率。在实际操作中,可能会遇到某些概率为零的情况,这时会采用贝叶斯估计来修正这些概率,避免分类偏差。

学习与分类流程包括:

- 输入训练数据集,每个样本包含特征及其对应的类别。

- 计算每个特征在各个类别下的条件概率和先验概率。

- 对于新的实例,计算其属于每个类别的后验概率,并据此进行分类。

总结来说,朴素贝叶斯法凭借其假设简单、参数少且对缺失数据不太敏感的特点,在众多分类算法中脱颖而出。然而,尽管理论上它具有最小的误差率,但在实际应用中,条件独立性的假设往往不成立,可能会影响分类性能。因此,朴素贝叶斯方法更适合于那些特征之间关系简单的任务,并需结合实际情况评估其适用性。

192 浏览量

170 浏览量

311 浏览量

2022-06-09 上传

2023-12-18 上传

2020-02-16 上传

2022-09-20 上传

2023-04-22 上传

解惑者冰冰

- 粉丝: 1

- 资源: 44

最新资源

- Chrome tab counter-crx插件

- Layui 元件库.zip

- KVStore:分布式多一致性键值存储

- nfr:一种轻量级工具,可对网络流量进行评分并标记异常

- Java-Http-Server

- jhipster-bookstore:使用jhipster(angular + spring + ehcache + mvn + grunt)生成的项目

- Open1560

- APx500_4.2.1 音频分析仪 APX515 APX525

- Hadoop&Hbase.rar

- qrrs:CLI QR代码生成器和用锈写的阅读器

- blink.X_blink_PIC_

- nycblog-semantichtml

- Android面试题.zip

- kubernetes-kargo-logging-monitoring:使用kargo部署kubernetes集群

- shiwai-readable-code

- ADT_Set___Lab_1_HW:DSA第一次实验室评估