使用梯度下降法进行线性回归分析

版权申诉

43 浏览量

更新于2024-08-04

收藏 298KB PDF 举报

线性回归是机器学习中的一种基础且重要的统计分析方法,用于建立输入变量(自变量)与输出变量(因变量)之间的数学关系模型。在给定的资料中,我们看到线性回归被用来找到一个公式,该公式能最小化数据的最小二乘拟合误差。

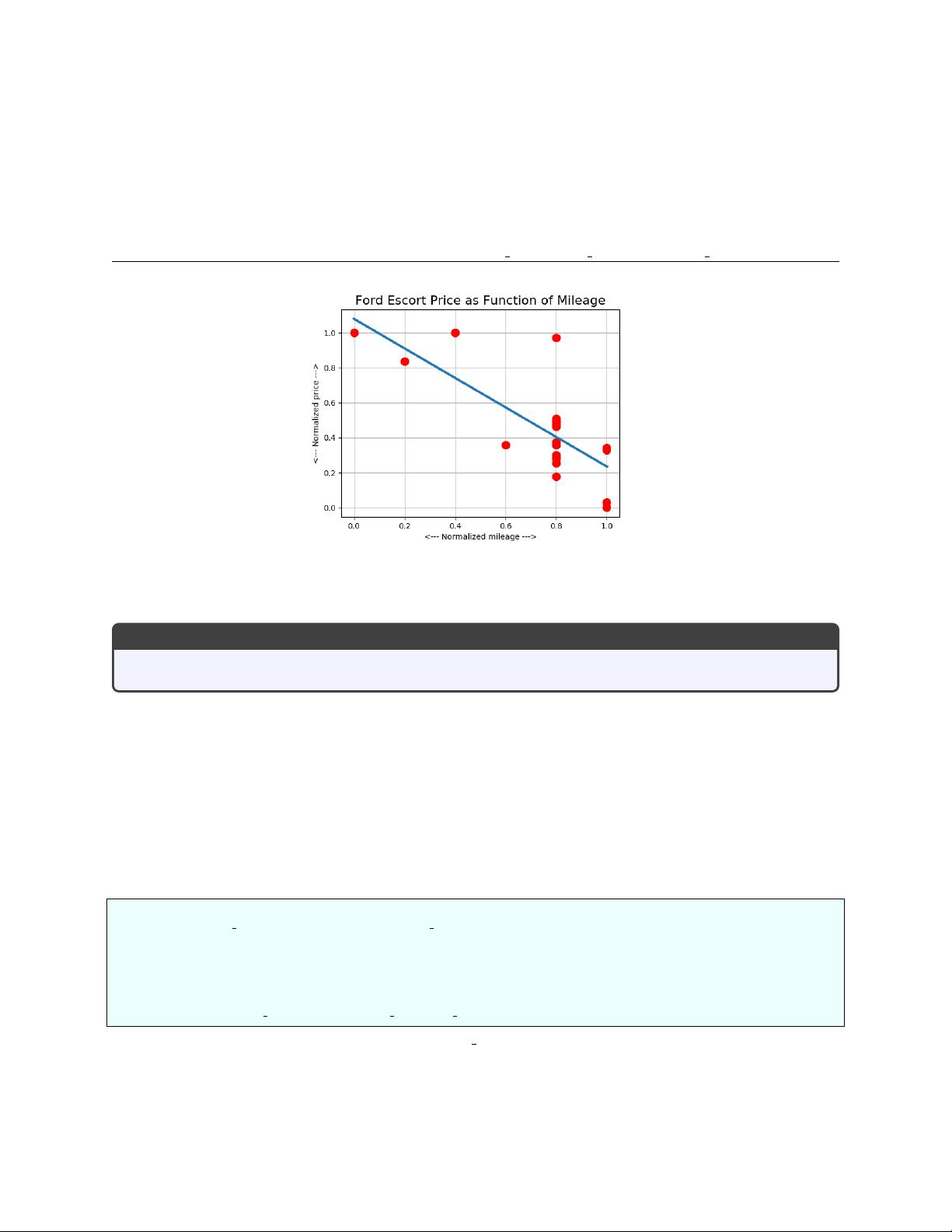

简单线性回归问题是最基本的形式,它涉及到一个输入变量x和一个输出变量y之间的关系。在案例中,我们想要拟合23组福特Escort车辆的里程(x)和价格(y)数据。目标是找到一个简单的线性公式:y = b + m*x,其中b是截距,m是斜率。为了使问题更容易处理,通常会对数据进行标准化,确保所有数值都在0到1之间。

在这个例子中,使用了梯度下降法(Gradient Descent)来估计b和m的值。这是一种优化算法,它通过迭代调整参数来最小化损失函数,这里是平方误差和。在代码清单1中,可以看到如何调用函数`gradientdescent2`来进行计算。初始化参数`bm0`代表初始的b和m值,`r`是学习率,`dxtol`和`dftol`分别是梯度变化和函数值变化的容忍度,`itmax`是最大迭代次数。

经过计算,得到了最终的线性回归公式:y = 1.04232 - 0.796815 * x。由于数据集包含23个数据点,而一条直线最多只能完美匹配两个点,所以预期我们的模型会存在一定的误差,即它是一个近似的解决方案。

线性回归有多种变体,包括多元线性回归(涉及多个自变量)和岭回归(添加了一个正则化项来解决过拟合问题)。此外,还有其他优化算法,如正规方程法,可以更直接地求解线性回归的参数。在实际应用中,线性回归模型常用于预测、特征选择和因果推断等任务。

总结一下,线性回归是通过最小化误差来寻找最佳拟合直线的过程,它在机器学习和数据分析中有广泛的应用。在给定的示例中,我们看到如何使用梯度下降来解决一个简单的线性回归问题,并得到了一个描述福特Escort价格和里程关系的线性方程。在实际应用中,需要根据数据特性和问题需求选择合适的优化方法和模型调整策略。

2023-06-18 上传

2023-06-18 上传

2018-03-01 上传

2023-10-27 上传

2019-05-17 上传

2019-10-29 上传

2018-03-01 上传

2021-05-22 上传

2020-03-26 上传

卷积神经网络

- 粉丝: 364

- 资源: 8440

最新资源

- 平尾装配工作平台运输支撑系统设计与应用

- MAX-MIN Ant System:用MATLAB解决旅行商问题

- Flutter状态管理新秀:sealed_flutter_bloc包整合seal_unions

- Pong²开源游戏:双人对战图形化的经典竞技体验

- jQuery spriteAnimator插件:创建精灵动画的利器

- 广播媒体对象传输方法与设备的技术分析

- MATLAB HDF5数据提取工具:深层结构化数据处理

- 适用于arm64的Valgrind交叉编译包发布

- 基于canvas和Java后端的小程序“飞翔的小鸟”完整示例

- 全面升级STM32F7 Discovery LCD BSP驱动程序

- React Router v4 入门教程与示例代码解析

- 下载OpenCV各版本安装包,全面覆盖2.4至4.5

- 手写笔画分割技术的新突破:智能分割方法与装置

- 基于Koplowitz & Bruckstein算法的MATLAB周长估计方法

- Modbus4j-3.0.3版本免费下载指南

- PoqetPresenter:Sharp Zaurus上的开源OpenOffice演示查看器