深度解析:BERT在推荐系统的应用与实践

181 浏览量

更新于2024-08-03

收藏 220KB PDF 举报

"基于BERT的推荐系统模型开发详解"

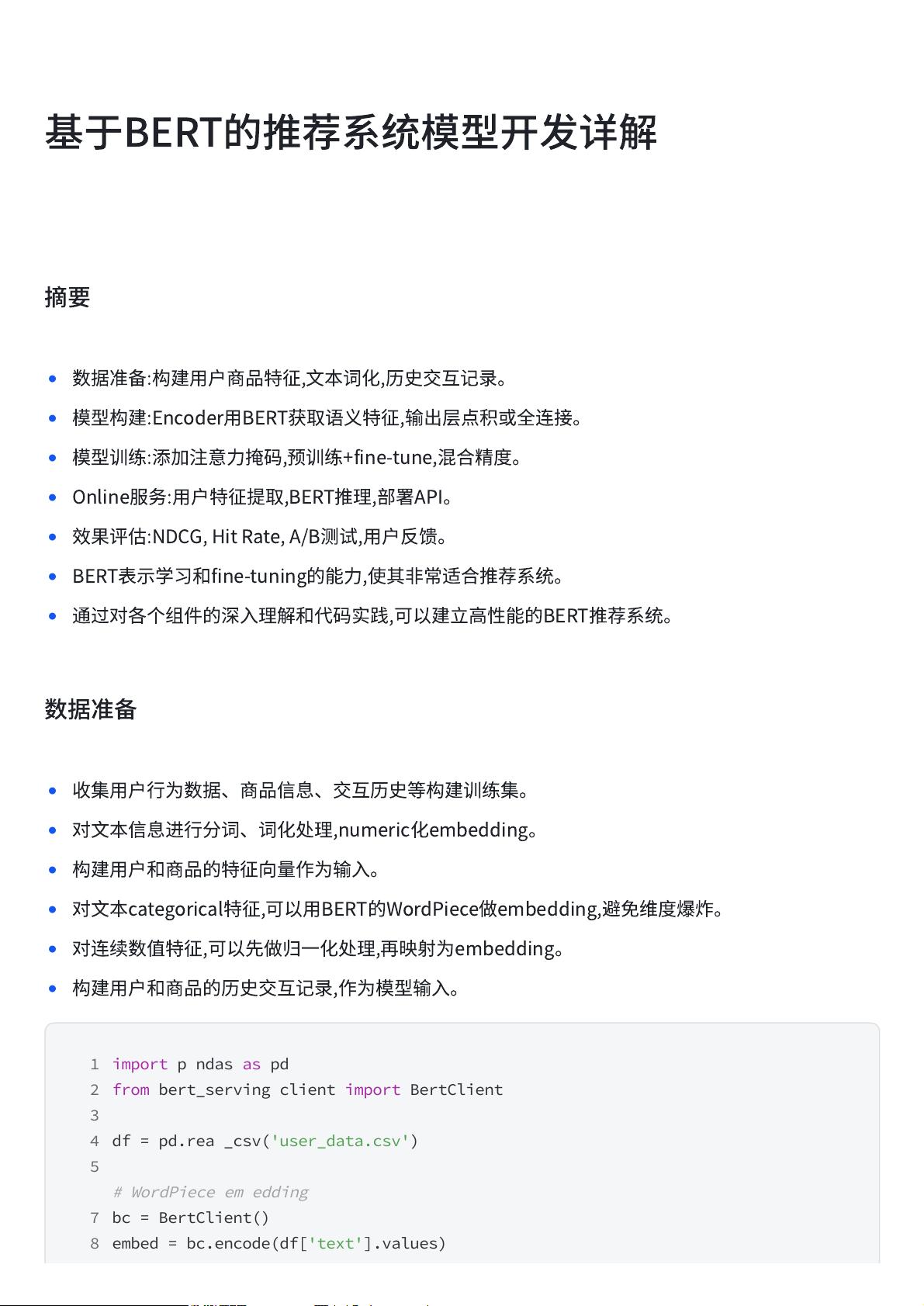

在推荐系统领域,BERT(Bidirectional Encoder Representations from Transformers)模型由于其强大的表示学习和微调能力,已经展现出极高的潜力。本文将详细介绍如何利用BERT构建一个高效的推荐系统,涵盖了从数据准备到模型训练,再到线上服务和效果评估的全过程。

数据准备是构建推荐系统的基石。首先,需要收集用户的行为数据,如浏览、购买、评分等,以及商品的信息,包括描述、类别等。这些数据经过处理转化为训练集。文本信息需要进行分词和词化,通常使用WordPiece方法将词汇切分成子词,以减少词汇表的大小,避免维度爆炸问题。对于连续数值特征,如用户的年龄和收入,应先进行归一化处理,然后映射为低维的嵌入向量。同时,构建用户与商品的历史交互记录,作为模型的输入,以便模型学习用户的偏好。

模型构建阶段,Encoder端采用预训练的BERT模型,通过Transformer架构捕捉文本的上下文信息,生成语义丰富的特征表示。在推荐任务的输出层,可以使用点积运算或者多层全连接网络来预测用户对商品的喜好程度。损失函数的选择可以是成对比较的BPR(Bayesian Personalized Ranking)或者交叉熵,具体取决于推荐任务的要求。此外,除了BERT,还可以考虑使用其变体,如ALBERT或RoBERTa,以进一步优化性能。

模型训练阶段,为了适应推荐系统的需求,通常会在BERT的预训练基础上进行微调(fine-tuning)。这包括在用户和商品的交互数据上训练模型,并添加注意力掩码以处理序列数据。混合精度训练可以加速计算并降低内存消耗,特别是在大规模数据集上。

线上服务阶段,用户特征和商品特征会被提取出来,通过已经训练好的BERT模型进行推理,生成推荐结果。这些结果可以通过API接口对外提供,实现推荐系统的实时响应。

效果评估是验证模型性能的关键步骤。推荐系统常用的评估指标有NDCG(Normalized Discounted Cumulative Gain),Hit Rate以及A/B测试。NDCG衡量了排序质量,Hit Rate关注推荐列表中是否包含目标项,而A/B测试则是在实际环境中检验模型的性能,结合用户反馈来不断优化模型。

通过深入理解每个组件的工作原理并进行实际的代码实践,可以构建出高性能的BERT推荐系统。这种系统不仅能够捕捉文本的深层语义,还能有效地学习和理解用户的行为模式,从而实现精准的个性化推荐。

2019-11-08 上传

2023-08-09 上传

2023-08-08 上传

2023-09-04 上传

2023-10-18 上传

2024-05-10 上传

2022-10-08 上传

2024-04-29 上传

2023-12-17 上传

weishaoonly

- 粉丝: 135

- 资源: 1381

最新资源

- JavaScript实现的高效pomodoro时钟教程

- CMake 3.25.3版本发布:程序员必备构建工具

- 直流无刷电机控制技术项目源码集合

- Ak Kamal电子安全客户端加载器-CRX插件介绍

- 揭露流氓软件:月息背后的秘密

- 京东自动抢购茅台脚本指南:如何设置eid与fp参数

- 动态格式化Matlab轴刻度标签 - ticklabelformat实用教程

- DSTUHack2021后端接口与Go语言实现解析

- CMake 3.25.2版本Linux软件包发布

- Node.js网络数据抓取技术深入解析

- QRSorteios-crx扩展:优化税务文件扫描流程

- 掌握JavaScript中的算法技巧

- Rails+React打造MF员工租房解决方案

- Utsanjan:自学成才的UI/UX设计师与技术博客作者

- CMake 3.25.2版本发布,支持Windows x86_64架构

- AR_RENTAL平台:HTML技术在增强现实领域的应用