SVR入门:构建简单预测模型

需积分: 30 69 浏览量

更新于2024-08-05

收藏 389KB DOCX 举报

"这篇文档是关于使用支持向量回归(SVR)构建简单预测模型的初级教程,由王若凡撰写,来自温州大学教育学院。文章介绍了SVR的基础概念,以及它与支持向量机(SVM)的关系,并探讨了如何在机器学习中应用SVR进行预测建模。"

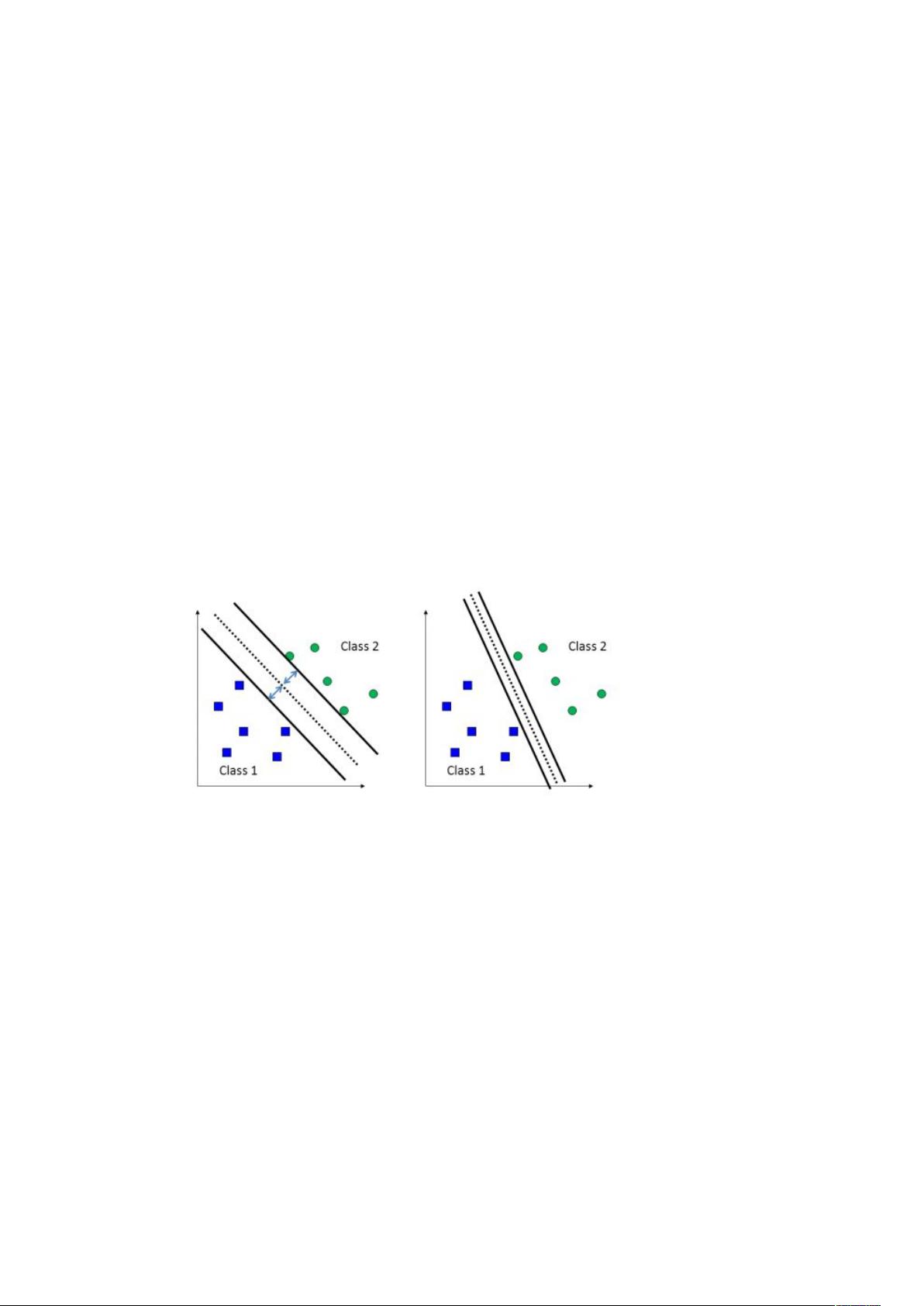

支持向量机(SVM)是一种广泛应用于分类和回归分析的机器学习算法,尤其在处理小样本、非线性及高维模式识别问题时表现出色。SVM的核心思想是构建一个能够将数据集划分为两类的超平面。在二维空间,超平面表现为一条直线,而在三维空间则是一个平面,随着维度增加,我们称其为超平面。超平面的选择目标是最大化间隔(margin),即离最近的数据点的距离,以提高模型的泛化能力。

支持向量回归(SVR)是SVM的一个变种,用于连续数值型数据的预测任务。与分类任务中的SVM不同,SVR的目标不是找到一个完全将两类数据分开的超平面,而是寻找一个能够最小化预测值与真实值之间误差的“软边界”。这个边界通常设定为一个带宽(epsilon)内的区域,任何在这个区域内的预测误差都被视为可接受的。超出这个带宽的误差点被称为支持向量,它们决定了模型的形状和位置。

在构建SVR模型时,首先需要选择合适的核函数,如线性核、多项式核或高斯核(RBF)。核函数的作用是将原始数据映射到高维特征空间,使得原本非线性可分的数据在新空间中变得线性可分。之后,通过优化算法(如梯度下降或SMO算法)寻找最优的超平面,即最大margin且误差最小的模型参数。

在实际应用中,SVR可用于各种预测问题,例如预测学生的学习成绩、股票价格、销售额等。在教育领域,通过分析学生的学习数据,SVR可以帮助教师提前预估学生的学习表现,从而制定更有效的教学策略。

总结起来,这篇文档提供的初步指导介绍了SVR的基本原理和构建过程,对于初学者来说是一个很好的入门起点。然而,要深入理解和掌握SVR,还需要进一步学习包括核函数选择、参数调优、模型评估等相关知识,并通过实践来提升技能。

2022-07-13 上传

2022-07-13 上传

2024-10-30 上传

2023-05-13 上传

2023-06-08 上传

2023-07-02 上传

2023-05-19 上传

2023-08-18 上传

weixin_46524111

- 粉丝: 0

- 资源: 6

最新资源

- Java集合ArrayList实现字符串管理及效果展示

- 实现2D3D相机拾取射线的关键技术

- LiveLy-公寓管理门户:创新体验与技术实现

- 易语言打造的快捷禁止程序运行小工具

- Microgateway核心:实现配置和插件的主端口转发

- 掌握Java基本操作:增删查改入门代码详解

- Apache Tomcat 7.0.109 Windows版下载指南

- Qt实现文件系统浏览器界面设计与功能开发

- ReactJS新手实验:搭建与运行教程

- 探索生成艺术:几个月创意Processing实验

- Django框架下Cisco IOx平台实战开发案例源码解析

- 在Linux环境下配置Java版VTK开发环境

- 29街网上城市公司网站系统v1.0:企业建站全面解决方案

- WordPress CMB2插件的Suggest字段类型使用教程

- TCP协议实现的Java桌面聊天客户端应用

- ANR-WatchDog: 检测Android应用无响应并报告异常