卷积神经网络基础与应用

需积分: 50 24 浏览量

更新于2024-07-17

收藏 1.13MB PDF 举报

"卷积神经网络原理.pdf"

卷积神经网络(Convolutional Neural Networks,简称CNN)是一种深度学习模型,特别适用于图像处理和计算机视觉任务。它在神经网络的基础上引入了卷积层和池化层,从而有效地提取特征并减少参数数量。

首先,我们要了解机器学习、神经网络和深度学习之间的关系。机器学习是让计算机通过数据学习规律的一类方法,神经网络是实现机器学习的一种模型,它模仿人脑神经元的工作方式。而深度学习是机器学习的一个分支,它主要关注构建多层的神经网络,也称为深度神经网络。

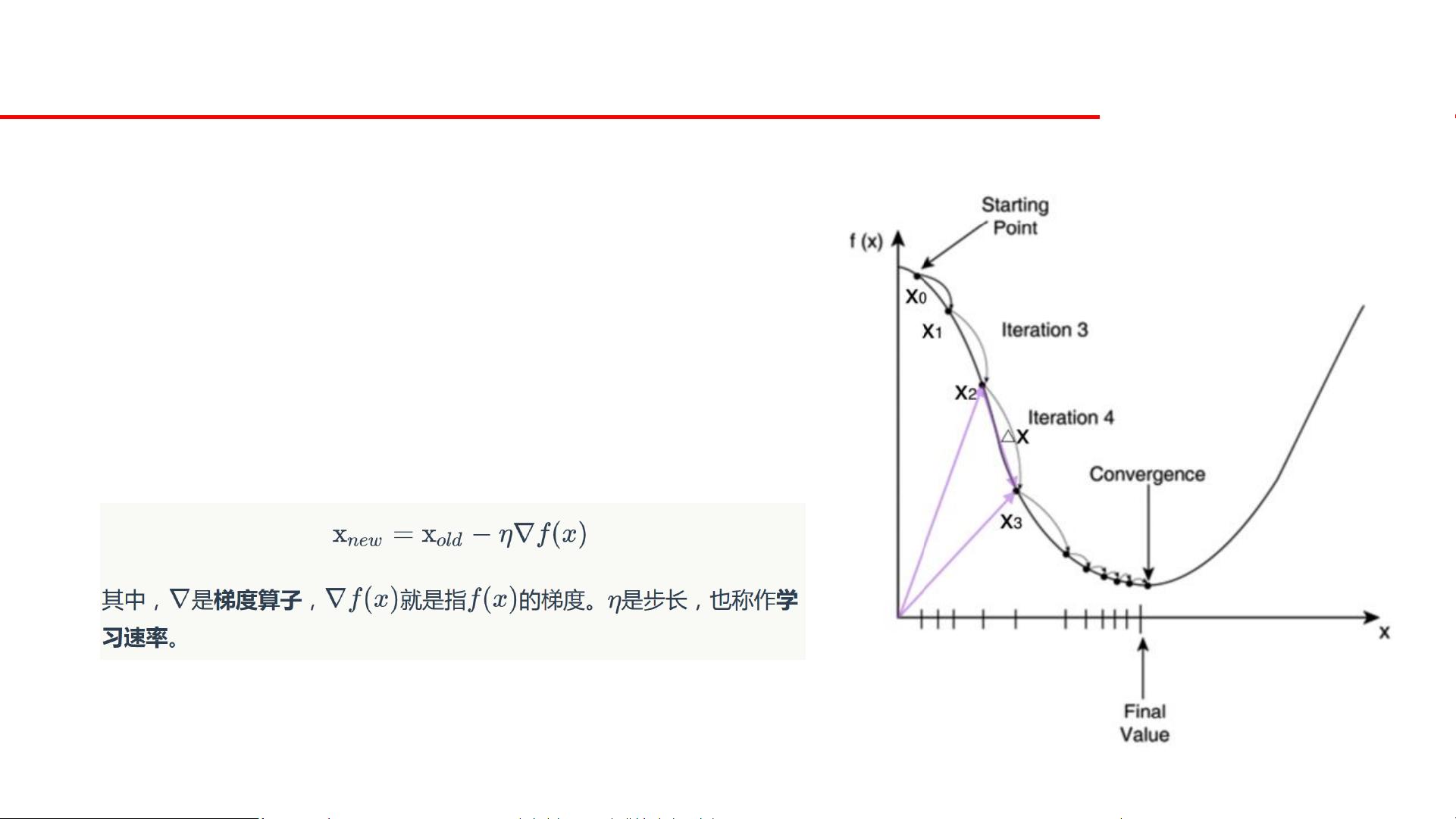

神经网络是由大量神经元相互连接组成的网络,每个神经元都有权重,负责接收输入、进行计算并产生输出。神经元之间通过权重连接形成层,层与层之间传递信息,形成前向传播过程。在训练过程中,通过梯度下降算法寻找使损失函数最小化的权重值。梯度下降是一种优化算法,它沿着损失函数梯度的负方向更新参数,以逼近函数的全局最小值。

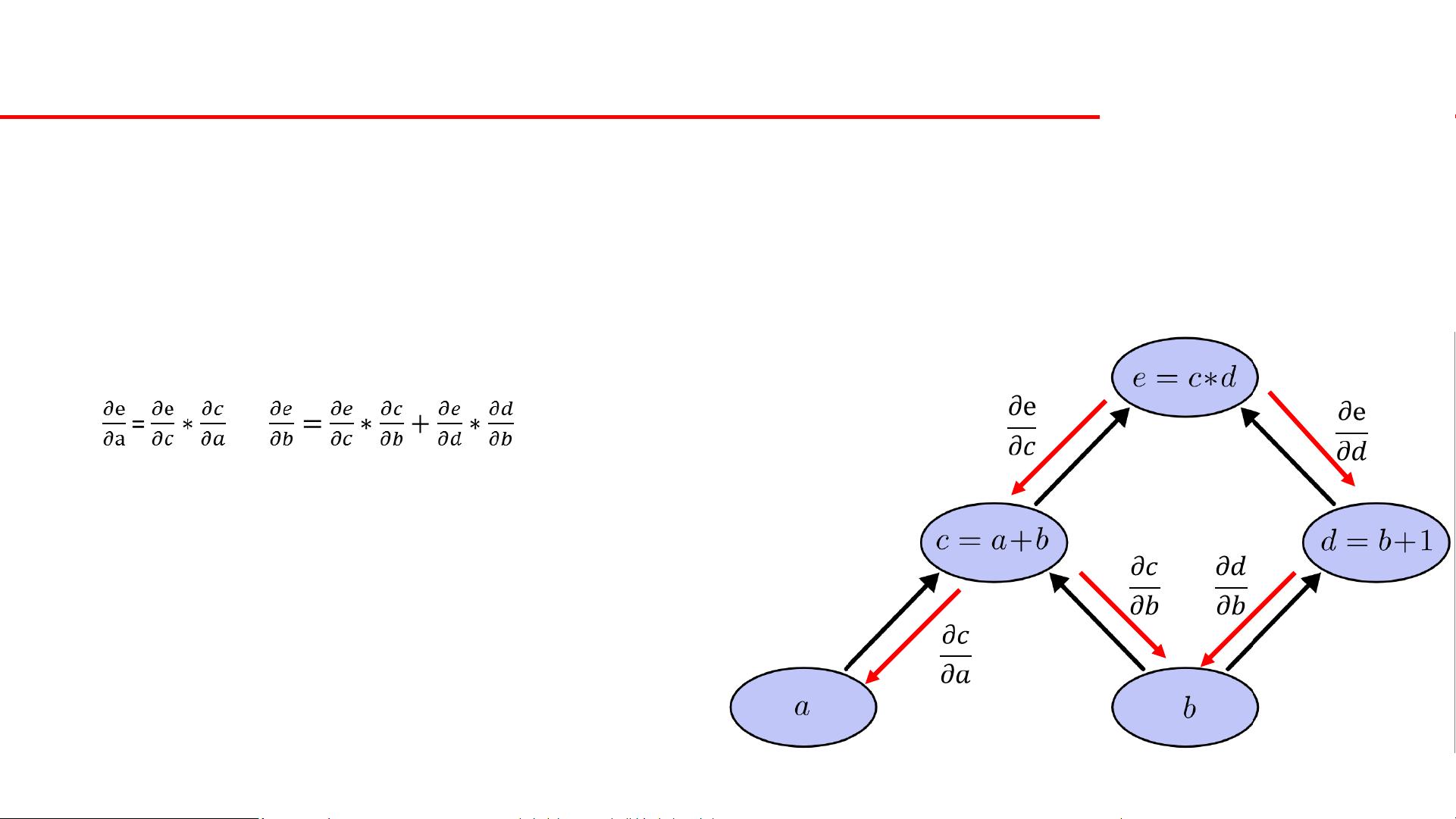

反向传播算法(Backpropagation)是神经网络训练的核心,用于计算损失函数关于所有权重的梯度。它是利用链式法则从顶层(输出层)向底层(输入层)反向计算每个节点的梯度,有效地减少了重复计算,提高了效率。

在CNN中,卷积操作是关键。它借鉴了数学中的卷积概念,但有所不同。在神经网络中,卷积层使用一组可学习的滤波器(或称卷积核)在输入数据上滑动,提取特征。每个滤波器会生成一个特征映射,多个滤波器可以捕获不同类型的特征。卷积操作不仅减少了模型的参数数量,还保持了输入数据的空间结构,这对于图像识别等任务至关重要。

此外,池化层(Pooling Layer)用于减小数据的尺寸,通常采用最大池化或平均池化,保留关键信息,降低计算成本。LeNet-5是早期著名的卷积神经网络架构,由Yann LeCun等人提出,它在手写数字识别任务上取得了突破性进展。

总结来说,卷积神经网络通过卷积和池化操作在深度学习中构建高效的特征提取模型,是解决图像处理问题的首选方法,广泛应用于图像分类、目标检测、语义分割等领域。了解和掌握CNN的基本原理和运作机制,对于深入研究深度学习技术至关重要。

点击了解资源详情

点击了解资源详情

点击了解资源详情

2021-09-25 上传

2024-04-23 上传

2022-07-03 上传

2022-06-01 上传

扬帆起航追太阳

- 粉丝: 7

- 资源: 5

最新资源

- 简洁的中国画背景中国风下载PPT模板

- BioBioChile-crx插件

- Nucleotide-Sequence-generator:随机DNA:dna:核苷酸生成器和反向互补查找器:microscope:

- 2_displacement_strain_analysis

- python学习

- Convolution:该程序找到两个离散序列的线性卷积-matlab开发

- Ejercicio2-LluviaPalabras-Java

- Python库 | viztracer-0.3.1-cp37-cp37m-manylinux2010_x86_64.whl

- kdmhmfrshx

- 行业分类-设备装置-电机转子嵌绝缘纸机.zip

- mysql-5.7-linux安装包及安装过程

- Earthworm-Web.github.io:这是Earthworm-Web的后台管理存储库

- 绿色田园风光自然风景下载PPT模板

- Better Eenadu E-Paper-crx插件

- plotmultix(varargin):绘制具有多个 x 轴的图-matlab开发

- Saltar Modal de La Nación-crx插件