浙江大学统计学习理论与SVM课件详解

需积分: 34 136 浏览量

更新于2024-07-18

3

收藏 1.83MB PPT 举报

"该资源是浙江大学的一份关于支持向量机(SVM)的经典课件,由徐从富博士编撰,包含《人工智能引论》课程的相关内容,详细讲解了统计学习理论与SVM,以及其在机器学习领域的地位、数学基础和与传统方法的区别。"

在深入探讨SVM之前,我们先理解一下统计学习理论。统计学习理论是机器学习的一个分支,它提供了理论基础,用于分析和理解学习算法的性能,特别是在大量数据集上的表现。这一理论强调了模型的泛化能力,即模型在未见过的数据上表现的能力。

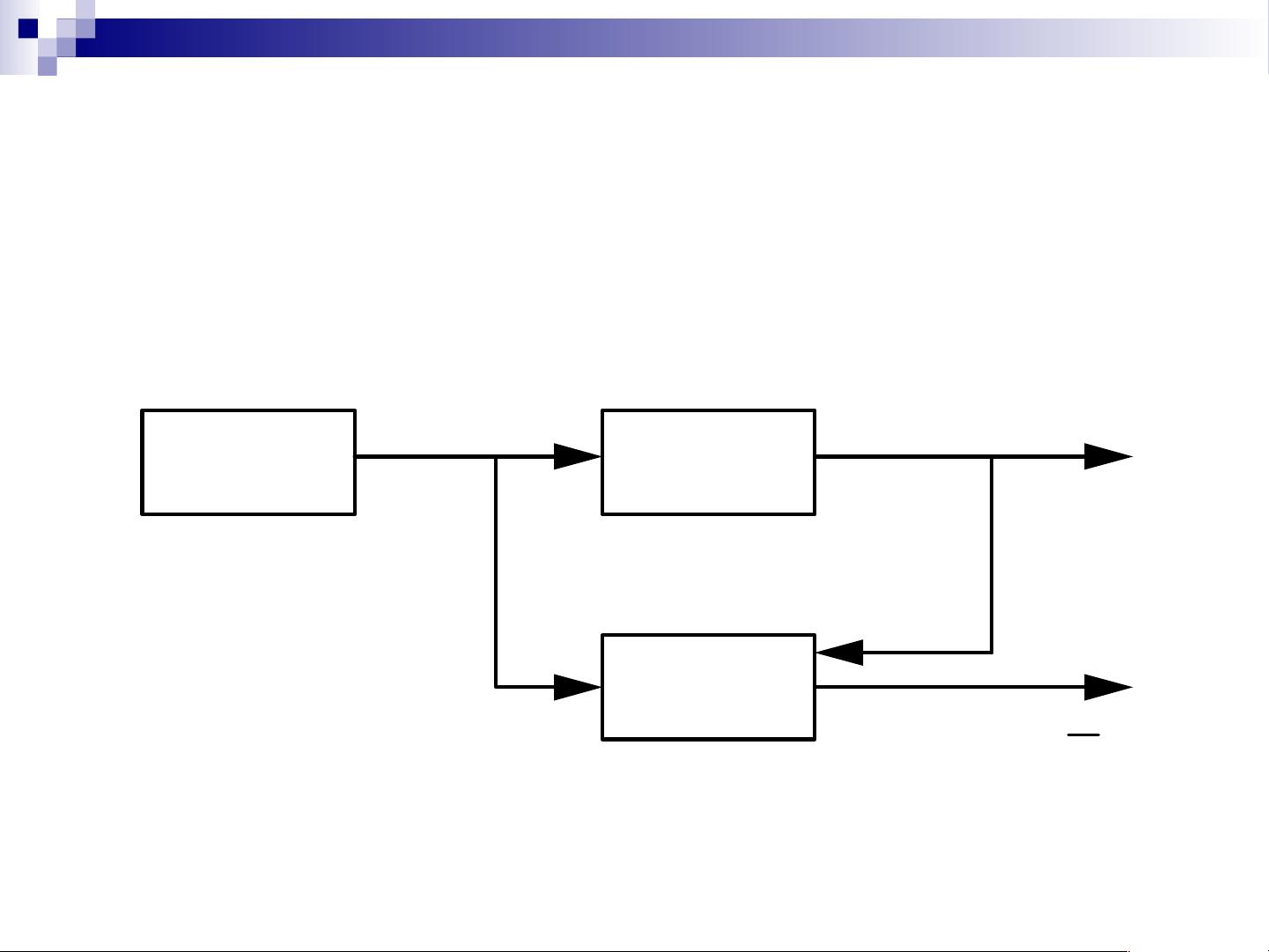

支持向量机(Support Vector Machine,SVM)是统计学习理论中的一个重要概念,它是一种监督学习算法,主要用于分类和回归分析。SVM的核心思想是找到一个最优超平面,将不同类别的数据点最大程度地分开。这个超平面是由训练集中距离它最近的数据点(支持向量)决定的。SVM的优势在于它可以处理高维数据,并且在小样本情况下也能表现出色。

课件中提到,SVM与传统的学习方法有显著区别。传统的学习方法往往依赖于人工挑选或构造少量的“强特征”来近似未知函数,而SVM则认为实际问题中有大量“弱特征”,通过它们的适当线性组合可以得到更好的逼近效果。这意味着在SVM中,选择特征的重要性不如如何构造有效的组合。

SVM的数学基础包括概率论与数理统计以及泛函分析。概率论与数理统计为理解和处理随机数据提供了理论框架,而泛函分析则为解决无限维空间中的优化问题提供了工具,这在构建和支持向量机的核函数时尤为关键。

课件还提到了SVM在2003年和2006年的修改稿,这表明了SVM领域的快速发展和持续的研究。SVM的研究现状可能包括了更多的核函数选择、软间隔处理、大规模数据集的优化算法以及与其他机器学习方法的集成应用。

这份浙江大学的SVM课件提供了丰富的理论背景和实践应用,对于理解和支持向量机的学习者来说,是一份宝贵的资源。它不仅介绍了SVM的基本概念,也探讨了其在统计学习理论中的重要地位,以及与传统方法的差异,有助于深化对机器学习的理解。

2021-03-30 上传

点击了解资源详情

点击了解资源详情

点击了解资源详情

点击了解资源详情

点击了解资源详情

点击了解资源详情

资源存储库

- 粉丝: 1w+

- 资源: 396

最新资源

- MATLAB新功能:Multi-frame ViewRGB制作彩色图阴影

- XKCD Substitutions 3-crx插件:创新的网页文字替换工具

- Python实现8位等离子效果开源项目plasma.py解读

- 维护商店移动应用:基于PhoneGap的移动API应用

- Laravel-Admin的Redis Manager扩展使用教程

- Jekyll代理主题使用指南及文件结构解析

- cPanel中PHP多版本插件的安装与配置指南

- 深入探讨React和Typescript在Alias kopio游戏中的应用

- node.js OSC服务器实现:Gibber消息转换技术解析

- 体验最新升级版的mdbootstrap pro 6.1.0组件库

- 超市盘点过机系统实现与delphi应用

- Boogle: 探索 Python 编程的 Boggle 仿制品

- C++实现的Physics2D简易2D物理模拟

- 傅里叶级数在分数阶微分积分计算中的应用与实现

- Windows Phone与PhoneGap应用隔离存储文件访问方法

- iso8601-interval-recurrence:掌握ISO8601日期范围与重复间隔检查