"伯禹学习平台的打卡任务,涵盖了机器学习中的重要概念,如过拟合、欠拟合、权重衰减、丢弃法,以及深度学习中的梯度消失、梯度爆炸、Kaggle房价预测问题,还包括了循环神经网络和相关技术的介绍。"

在机器学习领域,过拟合与欠拟合是两个关键概念。过拟合指的是模型在训练数据上表现极好,但在未见过的数据(测试数据)上表现较差,这通常是因为模型过于复杂,对训练数据中的噪声或特有特征过度学习。欠拟合则相反,模型无法有效地捕捉训练数据中的模式,导致训练误差高,这可能是因为模型过于简单,无法表达数据的复杂性。解决这两种问题的关键在于找到合适的模型复杂度和足够的训练数据。

权重衰减是一种有效的防止过拟合的策略,它等同于L2正则化。通过在损失函数中添加模型参数的平方和,即L2范数,可以促使模型学习到较小的权重值,从而避免过拟合。较小的权重意味着模型对训练数据的依赖减少,提高了泛化能力。

丢弃法(Dropout)是另一种常用的防止过拟合的技术,它在训练过程中随机忽略一部分神经元,使得模型不能过分依赖任何单一特征,增加了模型的鲁棒性。

在深度学习中,梯度消失和梯度爆炸是训练神经网络时常见的问题。梯度消失是指在反向传播过程中,梯度的值变得非常小,导致深层节点的权重更新缓慢或几乎不更新。梯度爆炸则是梯度值过大,可能导致权重更新过度,破坏模型的稳定性。解决这些问题的方法包括使用激活函数如ReLU,初始化策略,以及梯度裁剪。

Kaggle房价预测是一个典型的机器学习竞赛任务,它涉及到协变量偏移、标签偏移和概念偏移等实际问题。这些偏移问题意味着训练数据和测试数据的分布可能存在差异,需要在模型构建和评估时予以考虑。

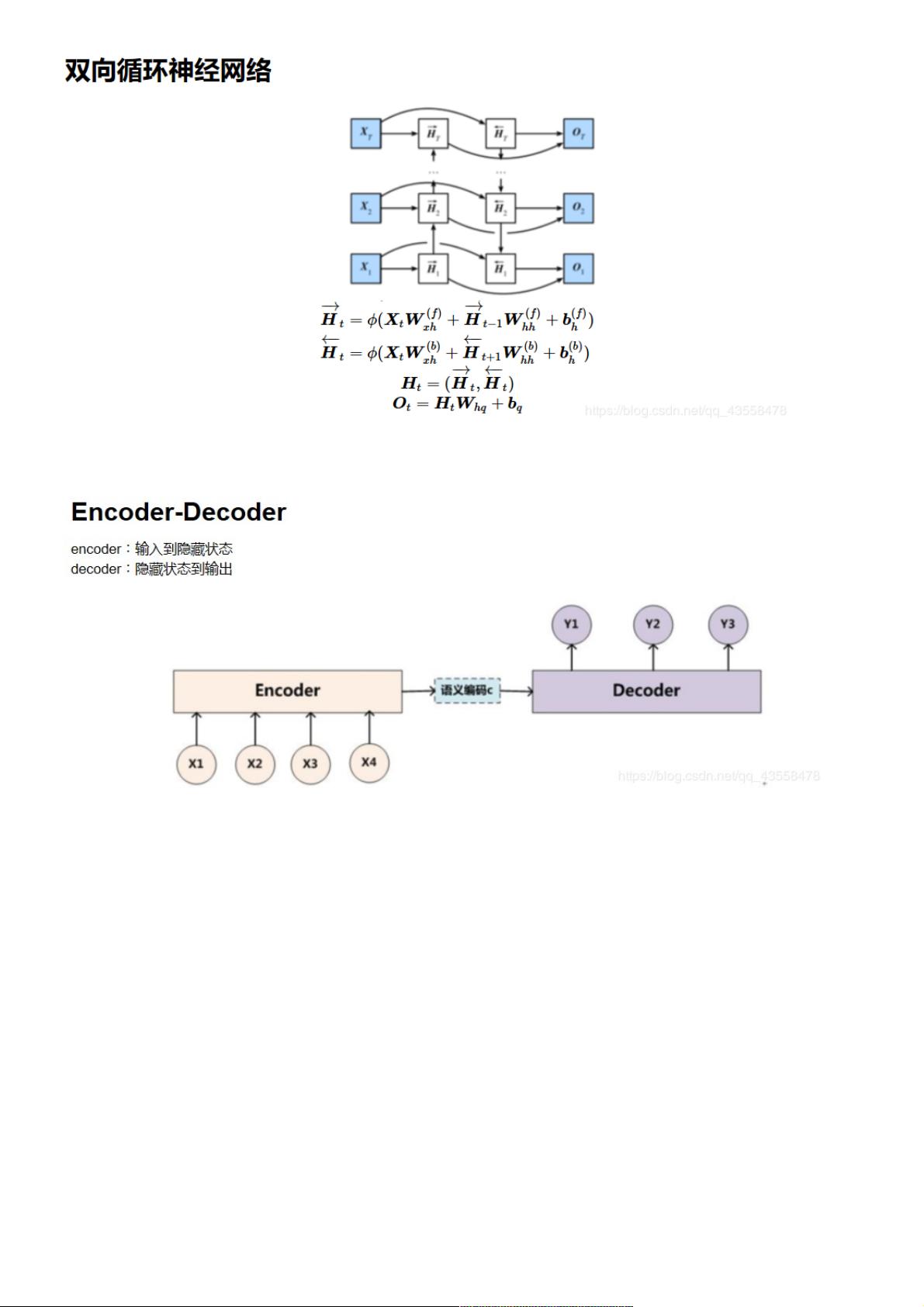

循环神经网络(RNN)在处理序列数据,如自然语言处理中起着重要作用。进阶话题包括机器翻译和注意力机制,这两者都是现代NLP模型的核心组成部分。Transformer是一种基于自注意力机制的架构,它在机器翻译任务中取得了重大突破,如今已成为深度学习领域的标准组件。

卷积神经网络(CNN)在图像识别和计算机视觉任务中占据主导地位,从基础的LeNet到更复杂的进阶应用,CNN不断推动着图像处理技术的发展。

这个学习平台的任务覆盖了从基本的机器学习概念到深度学习的前沿技术,对于提升机器学习和深度学习的知识水平有着显著的帮助。