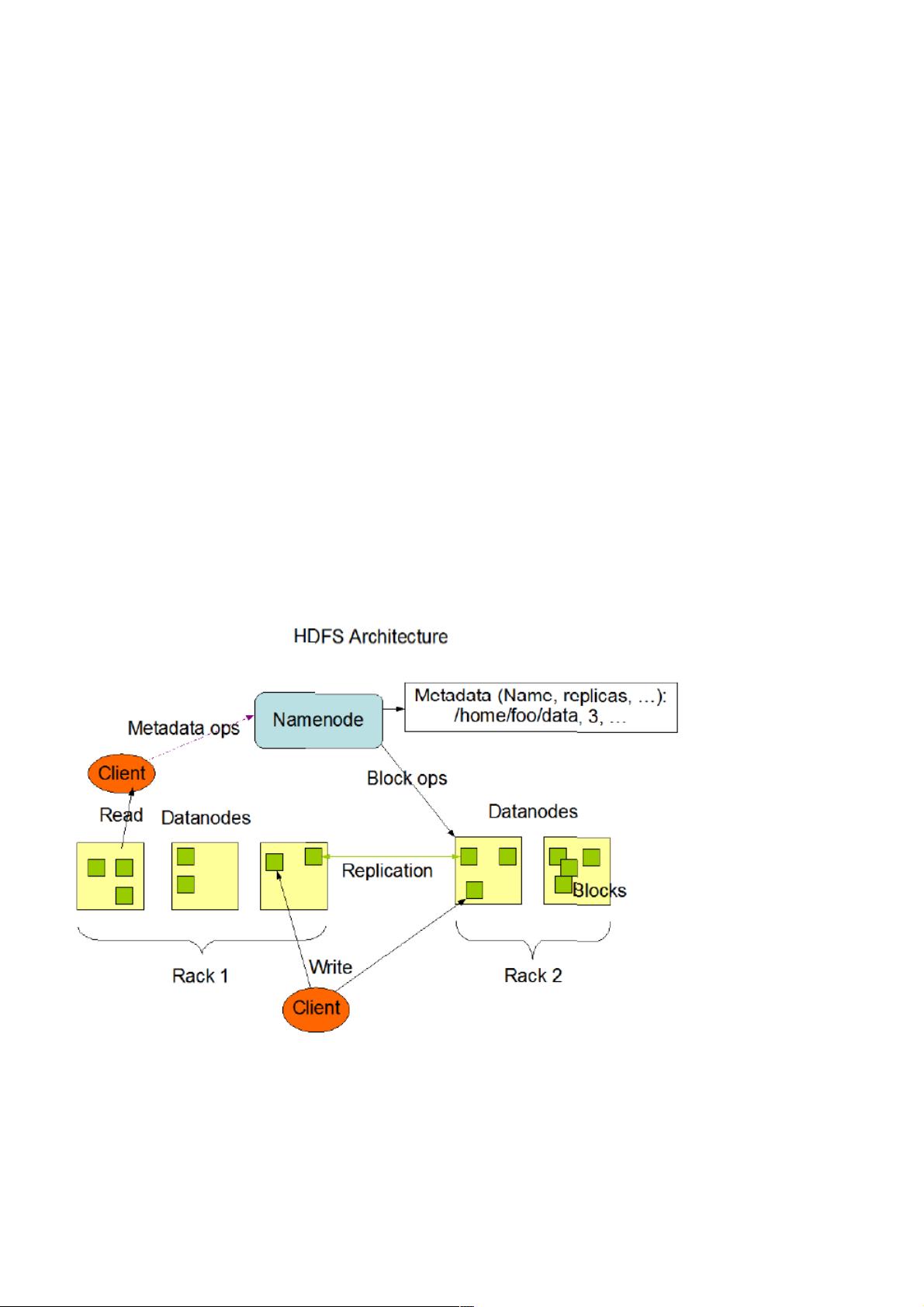

HDFS架构:应对海量数据的错误检测与高吞吐量设计

Hadoop分布式文件系统(HDFS)是一种专为大规模数据处理而设计的分布式文件系统,其核心架构和设计要点着重于以下几个方面: 1. **容错性与故障恢复**:HDFS将硬件错误视为常态,由于系统可能由成百上千个服务器组成,单点故障不再是罕见事件。因此,HDFS的关键设计目标是实现错误检测的高效性和自动恢复机制,确保即使部分服务器故障,也能保持系统的连续性和可用性。 2. **流式读取与吞吐量优先**:针对大数据处理应用,HDFS的设计更侧重于提供高吞吐量而非低延迟的数据访问。应用程序通常执行批量处理,而不是频繁的数据读取,这使得HDFS能够更好地满足这种以流式为主的访问模式。 3. **大数据存储**:HDFS被设计为支持大文件,单个文件通常在GB至TB级别,且能够支持大量的文件数量,如数千万。这就需要系统能够有效地管理海量文件,并保证文件的持久性和一致性。 4. **写一次读多次模型**:HDFS假设文件创建后很少更改,遵循write-one-read-many的访问模式。这种模型简化了数据一致性问题,允许高效的大量数据读取,适合MapReduce等需要高吞吐量的应用。 5. **移动计算的优势**:HDFS鼓励将计算任务移动到数据附近,以提高效率。随着数据规模的增长,这种本地性原则更为重要,因为它降低了数据移动的成本。 6. **Master-Slave架构**:HDFS采用Namenode和Datanode的角色分工。Namenode作为中心服务,负责文件系统的命名空间管理和客户端的文件操作,而Datanode则负责存储数据块并响应Namenode的指令。两者都设计为可以在廉价的Linux机器上运行,具有良好的可移植性。 7. **部署灵活性**:HDFS使用Java开发,支持在广泛的机器上部署。常见的部署方式是一台机器运行一个Namenode节点,其他机器运行Datanode实例。虽然在同一台机器上运行多个Datanode并不常见,但也是可能的。 HDFS通过其独特的架构和设计策略,解决了大规模数据处理中的一系列挑战,提供了高度可靠的、高性能的存储和访问服务,是云计算和大数据时代不可或缺的基石。

下载后可阅读完整内容,剩余3页未读,立即下载

- 粉丝: 6

- 资源: 928

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

最新资源

- Ansys Comsol实现力磁耦合仿真及其在电磁无损检测中的应用

- 西门子数控系统调试与配置实战案例教程

- ELM多输出拟合预测模型:简易Matlab实现指南

- 一维光子晶体的Comsol能带拓扑分析研究

- Borland-5技术资料压缩包分享

- Borland 6 技术资料分享包

- UE5压缩包处理技巧与D文件介绍

- 机器学习笔记:深入探讨中心极限定理

- ProE使用技巧及文件管理方法分享

- 增量式百度图片爬虫程序修复版发布

- Emlog屏蔽用户IP黑名单插件:自定义跳转与评论限制

- 安装Prometheus 2.2.1所需镜像及配置指南

- WinRARChan主题包:个性化你的压缩软件

- Neo4j关系数据映射转换测试样例集

- 安装heapster-grafana-amd64-v5-0-4所需镜像介绍

- DVB-C语言深度解析TS流

信息提交成功

信息提交成功