SparkContext入门:编程接口与作业管理

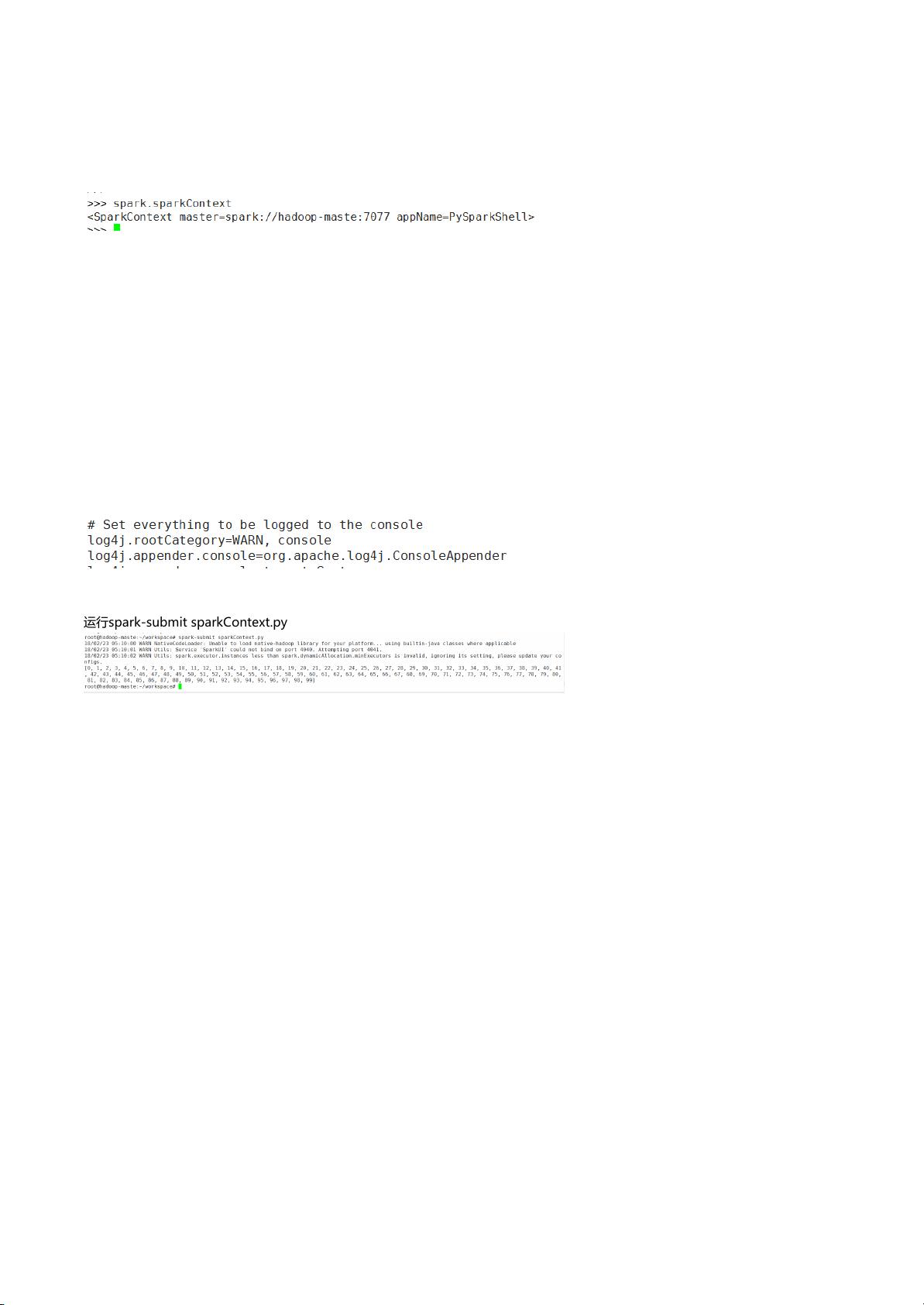

SparkContext是Apache Spark编程的核心组件,它在PySpark中扮演着至关重要的角色。它是与Spark集群的连接点,所有作业的提交、任务的调度和应用程序的注册都依赖于SparkContext。通过一个SparkContext实例,开发人员可以创建RDD(弹性分布式数据集)和Broadcast变量,这些是Spark处理大规模数据的基础。 获取SparkContext主要有两种方式: 1. **通过SparkSession**:在命令行中运行`pyspark --master spark://hadoop-master:7077`,这会启动一个SparkSession并自动创建一个SparkContext。SparkSession提供了更高级别的接口,但底层仍依赖SparkContext。在启动过程中,可以看到SparkContext连接的Spark集群的master地址,即`spark://hadoop-master:7077`。 2. **直接导入SparkContext**:在Python脚本中,可以导入`pyspark.SparkContext`并创建实例。例如,在`sparkContext.py`中,创建一个SparkConf对象设置master地址为本地模式,然后初始化SparkContext。之后创建一个RDD来演示基本操作,并在程序结束时停止SparkContext。 Accumulator是SparkContext提供的一个重要工具,它允许在多个任务(Task)之间共享状态并进行累加。Accumulator支持单个操作(如add),并且可以设置初始值。在`accumulator.py`中,我们创建了一个Accumulator实例,用于执行1到50的加法运算,通过numpy库辅助计算。Accumulators在Spark的分布式计算中很有用,尤其是在需要全局累计或汇总数据的场景。 SparkConf对象是Spark应用的配置容器,用于设置运行时参数,如master地址、内存分配等。通过配置它可以调整Spark的工作方式以适应不同的环境和需求。在上述例子中,调整log4j.properties文件的日志级别是为了优化日志输出,便于分析和调试。 SparkContext是PySpark开发者进行大数据处理的基石,理解和掌握其工作原理和使用方法对于构建高效、可靠的Spark应用至关重要。同时,Accumulator作为Spark共享状态的机制,是分布式计算中的关键组件之一。通过适当的配置和使用,SparkContext和Accumulator能够帮助我们充分利用Spark的分布式计算能力。

下载后可阅读完整内容,剩余6页未读,立即下载

- 粉丝: 31

- 资源: 328

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

最新资源

- ASP.NET数据库高级操作:SQLHelper与数据源控件

- Windows98/2000驱动程序开发指南

- FreeMarker入门到精通教程

- 1800mm冷轧机板形控制性能仿真分析

- 经验模式分解:非平稳信号处理的新突破

- Spring框架3.0官方参考文档:依赖注入与核心模块解析

- 电阻器与电位器详解:类型、命名与应用

- Office技巧大揭秘:Word、Excel、PPT高效操作

- TCS3200D: 可编程色彩光频转换器解析

- 基于TCS230的精准便携式调色仪系统设计详解

- WiMAX与LTE:谁将引领移动宽带互联网?

- SAS-2.1规范草案:串行连接SCSI技术标准

- C#编程学习:手机电子书TXT版

- SQL全效操作指南:数据、控制与程序化

- 单片机复位电路设计与电源干扰处理

- CS5460A单相功率电能芯片:原理、应用与精度分析

信息提交成功

信息提交成功