Multi-Frame Quality Enhancement for Compressed Video

Ren Yang, Mai Xu

∗

, Zulin Wang and Tianyi Li

School of Electronic and Information Engineering, Beihang University, Beijing, China

{yangren, maixu, wzulin, tianyili}@buaa.edu.cn

Abstract

The past few years have witnessed great success in ap-

plying deep learning to enhance the quality of compressed

image/video. The existing approaches mainly focus on en-

hancing the quality of a single frame, ignoring the simi-

larity between consecutive frames. In this paper, we in-

vestigate that heavy quality fluctuation exists across com-

pressed video frames, and thus low quality frames can be

enhanced using the neighboring high quality frames, seen

as Multi-Frame Quality Enhancement (MFQE). According-

ly, this paper proposes an MFQE approach for compressed

video, as a first attempt in this direction. In our approach,

we firstly develop a Support Vector Machine (SVM) based

detector to loca te Peak Qua lity Frames (PQFs) in com-

pressed video. Then, a novel Multi-Frame Convolution-

al Neural Network (MF-CNN) is designed to enhance the

quality of compressed video, in which the non-PQF and its

nearest two PQFs are as the input. The MF-CNN compen-

sates motion between the non-PQF and PQFs through the

Motion Compensation subnet (MC-subnet). Subsequently,

the Quality Enhancement subnet (QE-subnet) reduces com-

pression artifacts of the non-PQF with the help o f its n-

earest PQFs. Finally, the experiments validate the effec-

tiveness and generality of our MFQE approach in advanc-

ing the state-of-the-art quality enhancement of compressed

video. The code of our MFQE approach is available at

https://github.com/ryangBUAA/MFQE.git.

1. Introduction

During the past decades, video has become significant-

ly popular over the Internet. According to the Cisco Data

Traffic Forecast [7], video generates 60% of Internet traf-

fic in 2016, and this figure is p redicted to reach 78% by

2020. When transmitting video over the bandwidth-limited

Internet, video compression has to be applied to significant-

ly save the coding bit-rate. However, the compressed video

inevitably suffers from compression artifacts, which may

severely degrade the Qu ality of Experience (QoE). There-

fore, it is necessary to study on quality enhan cement for

∗

Mai Xu is the corresponding author of this paper.

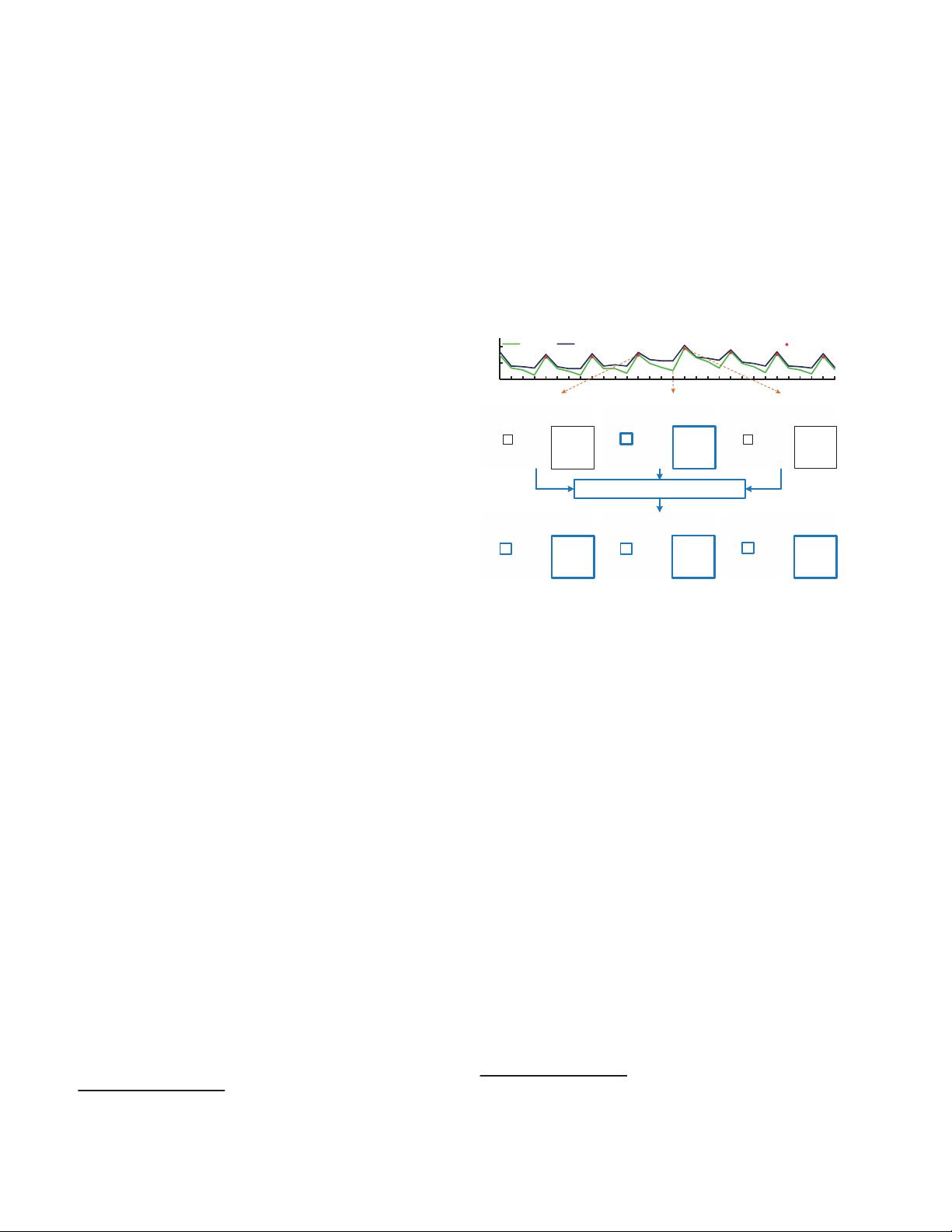

DS-CNN [38]

Compressed frame 93 Compressed

frame 96 Compressed frame 97

Enhanced

frame 96Enhanced frame 96 Raw frame 96

PSNR (dB)

Frames81 85 90 95 100 105

HEVC

Our MFQE approach

PQF

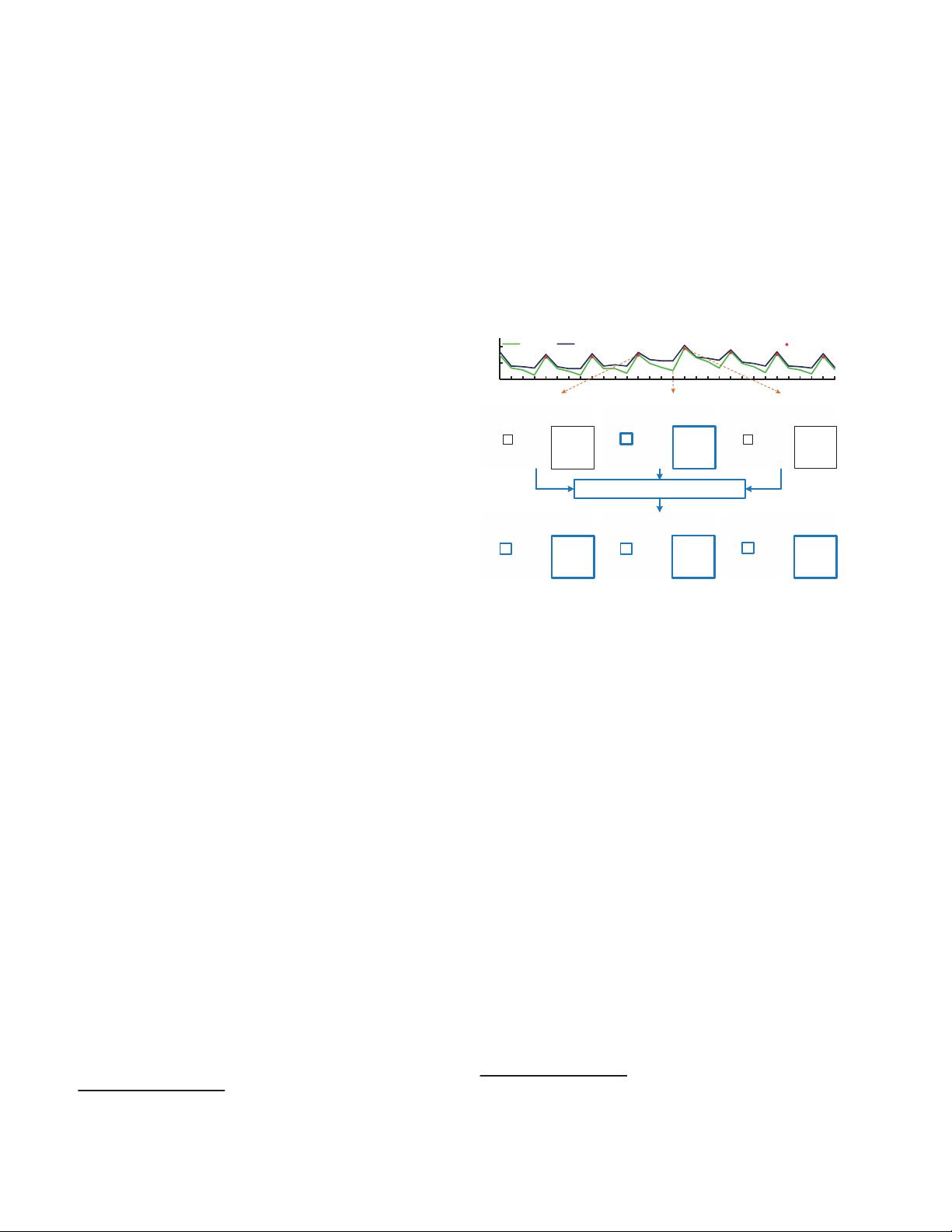

MF-CNN of our MFQE approach

Figure 1. Example for quality fluctuation (top) and quality enhancement

performance (bottom).

compressed video.

Recently, there has been increasing interest in enhanc-

ing the visual quality of compressed image/video [2 5, 10,

18, 33, 6, 9, 35, 12, 24, 24, 38]. For example, Dong et

al. [9] designed a four-layer Convolutional Neural Net-

work (CNN) [22], named AR-CNN, which considerably

improves the q uality of JPEG images. Later, Yang et al. de-

signed a Decoder-side Scalable CNN (DS-CNN) for video

quality enhancement [3 8, 3 9]. However, when process-

ing a single frame, all existing quality enhancement ap-

proaches do not take any advantage of information in the

neighbouring frames, and thus their performance is large-

ly limited. As Figure 1 shows, the quality of compressed

video dramatically fluctuates across frames. Therefore, it

is possible to use the high quality frames (i.e., Peak Qual-

ity Frames, called PQFs

1

) to enh ance the quality of their

neighboring low quality frames (non-PQFs). This can be

seen as Multi-Frame Quality Enhancement (MFQE), simi-

lar to multi-frame super-resolution [20, 3].

This paper proposes an MFQE approach for compressed

video. Specifically, we first investigate that there exists

large quality fluctuation across frames, for video sequences

compressed by almost all coding standards. Thus, it is nec-

1

PQFs are defined as the frames whose quality is higher than their pre-

vious and subsequent frames.