使用Delta Lake优化Apache Spark

需积分: 9 102 浏览量

更新于2024-07-16

收藏 5.09MB PDF 举报

"Delta-Lake_Michael_Armbrust_BayAreaMeetup-iteblog.pdf"

这篇PDF文件探讨了如何通过Delta Lake改进Apache Spark,由Michael Armbrust主讲。Delta Lake是一个开源存储层,旨在解决数据湖中的关键挑战,如历史查询、杂乱无章的数据、错误和失败以及更新问题。以下是关于Delta Lake及其对Apache Spark提升的详细知识点:

1. **数据收集与应用场景**

- Delta Lake支持各种各样的应用场景,包括推荐引擎、风险和欺诈检测、物联网(IoT)及预测性维护、基因组学和DNA测序。

- 这些应用都需要处理大量实时或近实时的数据,对数据的存储和分析能力有高要求。

2. **数据湖的承诺与挑战**

- 数据湖的概念是将所有类型的数据存储在一起,以便进行后期分析。然而,传统的数据湖往往存在“垃圾进,垃圾出”的问题,即数据质量难以保证。

- 数据湖项目通常经历一个演化过程,从最初的事件数据存储,发展到支持流式分析、人工智能(AI)和报告等高级功能。

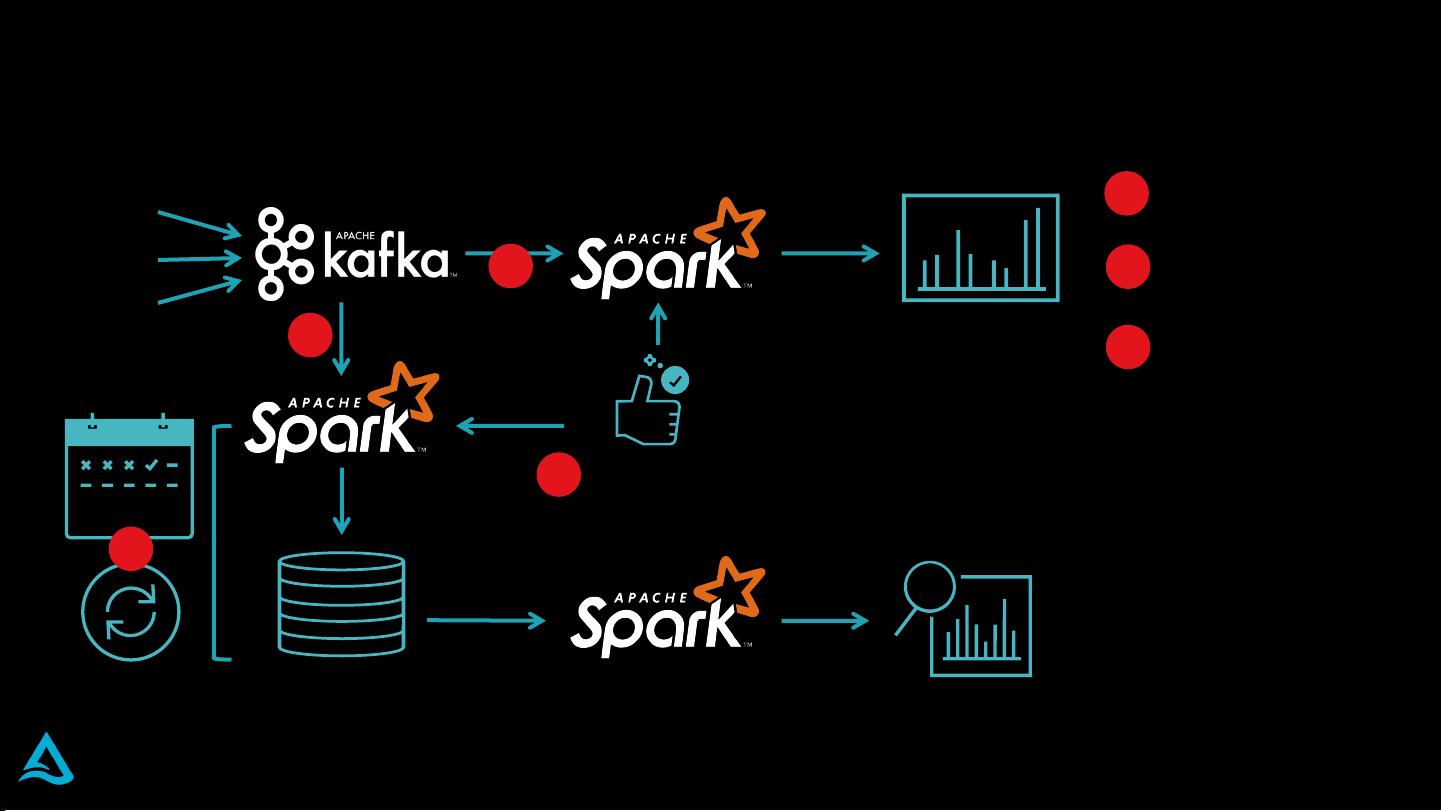

3. **Lambda架构的挑战**

- Lambda架构是一种处理实时和批处理数据的混合架构,但面临几个挑战:

- **历史查询**:Lambda架构在处理历史数据查询时效率低下,因为需要结合实时和历史数据。

- **杂乱无章的数据**:数据质量控制不力可能导致数据湖中的数据不一致。

- **错误和失败**:处理数据错误和系统故障可能导致需要重新处理大量数据。

- **更新问题**:Lambda架构对数据更新的支持有限。

4. **Delta Lake的解决方案**

- Delta Lake解决了上述挑战,提供了一种统一的、事务性的数据存储解决方案,适用于批处理和流处理。

- **验证**:Delta Lake引入了数据验证机制,确保写入的数据满足预定义的规范,从而提高数据质量。

- **重处理**:通过版本控制和时间旅行功能,Delta Lake允许轻松地重新处理数据,纠正错误。

- **分区优化**:通过智能分区,Delta Lake加速了查询性能,特别是在处理大规模数据时。

5. **Apache Spark与Delta Lake的结合**

- Delta Lake与Apache Spark的集成,使Spark能够更好地处理数据湖中的数据,提供ACID(原子性、一致性、隔离性、持久性)事务支持。

- Spark可以利用Delta Lake的特性,如强大的读写性能、一致性保证和容错能力,提升大数据处理的效率和可靠性。

6. **机器学习和数据分析**

- Delta Lake支持数据科学和机器学习工作流,可以提供干净、一致的数据集用于模型训练和评估。

- 结合Spark的MLlib库,Delta Lake可以实现端到端的机器学习管道,从数据准备到模型部署。

Delta Lake通过增强数据存储的可靠性和一致性,极大地提升了Apache Spark在数据湖场景下的表现,使得复杂的数据处理任务变得更加高效和可靠。

2019-10-28 上传

2021-01-20 上传

2020-08-27 上传

2014-05-29 上传

2019-08-28 上传

2018-11-21 上传

2021-06-19 上传

2021-05-18 上传

2022-03-21 上传

SAM

- 粉丝: 27

- 资源: 77

最新资源

- MATLAB新功能:Multi-frame ViewRGB制作彩色图阴影

- XKCD Substitutions 3-crx插件:创新的网页文字替换工具

- Python实现8位等离子效果开源项目plasma.py解读

- 维护商店移动应用:基于PhoneGap的移动API应用

- Laravel-Admin的Redis Manager扩展使用教程

- Jekyll代理主题使用指南及文件结构解析

- cPanel中PHP多版本插件的安装与配置指南

- 深入探讨React和Typescript在Alias kopio游戏中的应用

- node.js OSC服务器实现:Gibber消息转换技术解析

- 体验最新升级版的mdbootstrap pro 6.1.0组件库

- 超市盘点过机系统实现与delphi应用

- Boogle: 探索 Python 编程的 Boggle 仿制品

- C++实现的Physics2D简易2D物理模拟

- 傅里叶级数在分数阶微分积分计算中的应用与实现

- Windows Phone与PhoneGap应用隔离存储文件访问方法

- iso8601-interval-recurrence:掌握ISO8601日期范围与重复间隔检查