深度学习人脸检测与识别:MTCNN与FaceNet实战

PDF格式 | 878KB |

更新于2024-08-26

| 175 浏览量 | 举报

"本文主要探讨如何使用MTCNN和FaceNet模型进行人脸检测与识别,这两个深度学习模型在现代人脸识别技术中的应用越来越广泛。MTCNN用于人脸检测,而FaceNet则专注于人脸识别。"

人脸检测与人脸识别是计算机视觉领域的重要组成部分,它们在安全监控、身份验证、社交网络等多种场景中发挥着关键作用。人脸检测首先定位图片中的人脸,给出精确的人脸框坐标和特征点位置,为后续的识别阶段提供基础。人脸识别则通过提取人脸的特征并与其他人脸进行比较,以确定个体身份。

MTCNN(Multi-task Cascaded Convolutional Networks)是由张开鹏等人于2016年提出的先进人脸检测模型。它采用三个连续的卷积神经网络(CNN),即PNet、RNet和ONet,分别执行人脸候选框生成、初步筛选和精确检测的任务。PNet负责初步人脸检测和关键点定位,RNet进一步精炼候选框并进行关键点检测,最后ONet负责更精细的面部结构检测和边界框回归。这种级联结构使得MTCNN能够在复杂场景中实现高效且准确的人脸检测。

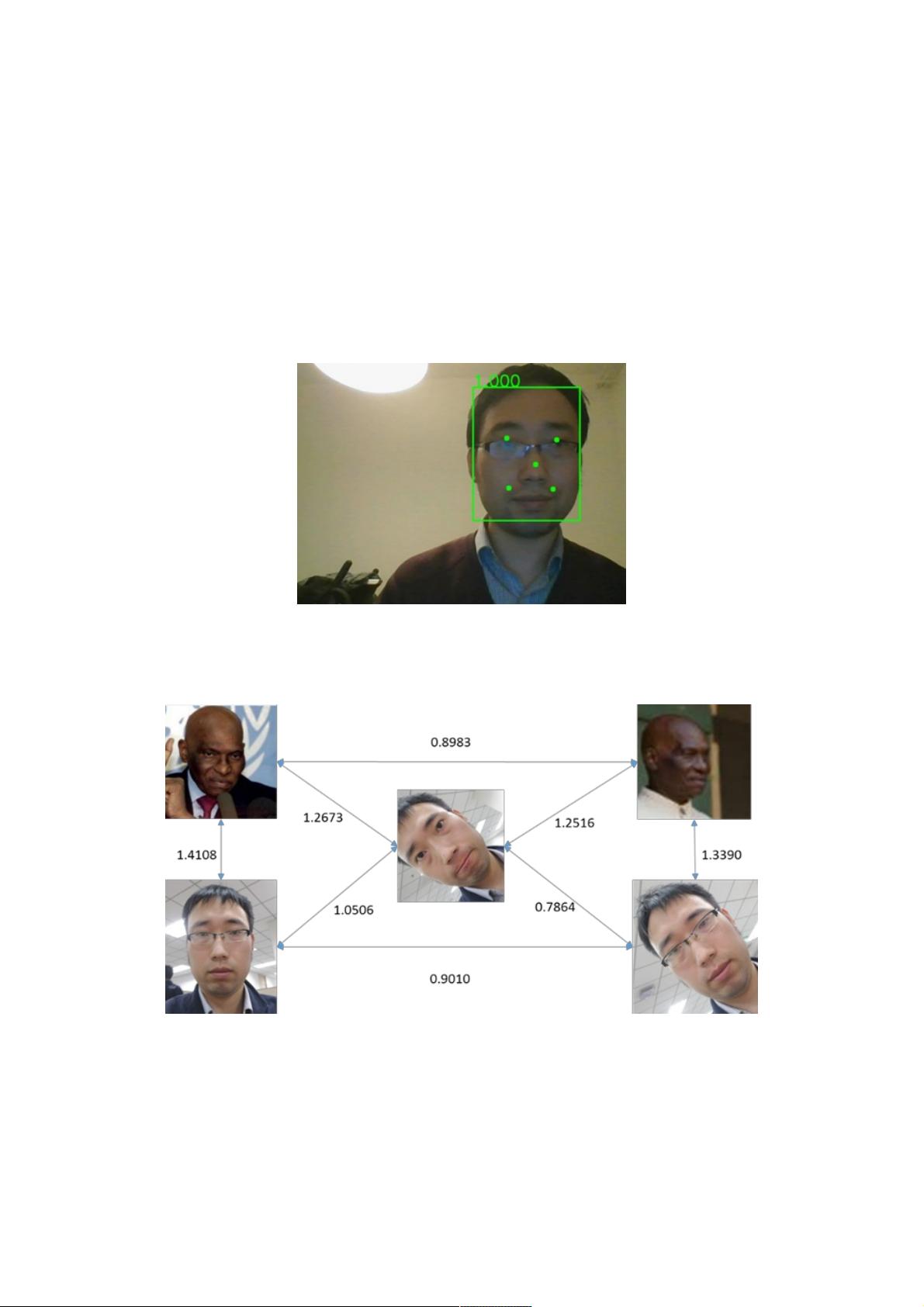

FaceNet是Google团队开发的深度学习人脸识别模型,由弗洛里安·施罗夫等人提出。与传统分类方法不同,FaceNet不直接进行分类,而是学习将人脸图像映射到欧氏空间中的一个向量,使得相同人脸的向量距离近,不同人脸的向量距离远。这种方法允许直接通过计算两个向量的距离来判断是否为同一人脸,当距离小于特定阈值(如1.06)时,认为是同一个人。FaceNet的成功在于其能适应各种光照、表情和遮挡条件,提高了人脸识别的鲁棒性。

结合MTCNN和FaceNet,我们可以构建一个完整的人脸识别系统。首先,MTCNN用于检测和定位图片中的人脸,接着提取出人脸特征点;然后,FaceNet从这些检测到的人脸区域提取特征向量;最后,通过比较这些向量的欧氏距离,可以确定不同人脸之间的相似性,从而实现身份识别。

随着深度学习技术的不断发展,人脸检测和识别的性能得到了显著提升,能够应对更多挑战,如大规模人脸检测、遮挡人脸识别和低分辨率图像处理等。这些技术的进步不仅推动了学术研究,也促进了实际应用场景的广泛应用,如智能安防、移动支付和虚拟现实等。然而,随之而来的是隐私保护和伦理问题,如何在利用这些技术带来便利的同时确保个人信息的安全,成为未来发展中必须考虑的重要议题。

相关推荐

1210 浏览量

368 浏览量

weixin_38629042

- 粉丝: 7

最新资源

- 便携式XML编辑工具,强大功能轻松管理

- Android广播通信机制解析

- 定时自动关机软件,设置时间表轻松管理

- 基于MFC的航班订退票管理系统

- 掌握滚动动画制作技巧,动画演示不再难

- PHP实现定时检测URL连通性服务

- 简易SegmentControl控件实现与学习指南

- xwork-2.1.5库文件压缩包解析指南

- WinMend Auto-Shutdown实现智能定时开关机

- 微软SMS2003部署与管理详细教程PDF

- XML Web Service课程设计实战指南

- 约旦文化探讨:食品、服饰、庆典与旅游

- Android手机稳定录像功能实现示例代码

- Android WebView加载Web界面实战指南

- 系统提速精灵:一键电脑提速解决方案

- 非侵入式实现RecyclerView拖拽排序简易方法