探索深度学习入门:神经网络与CNN、RNN与LSTM

需积分: 0 164 浏览量

更新于2024-06-30

收藏 3.41MB PDF 举报

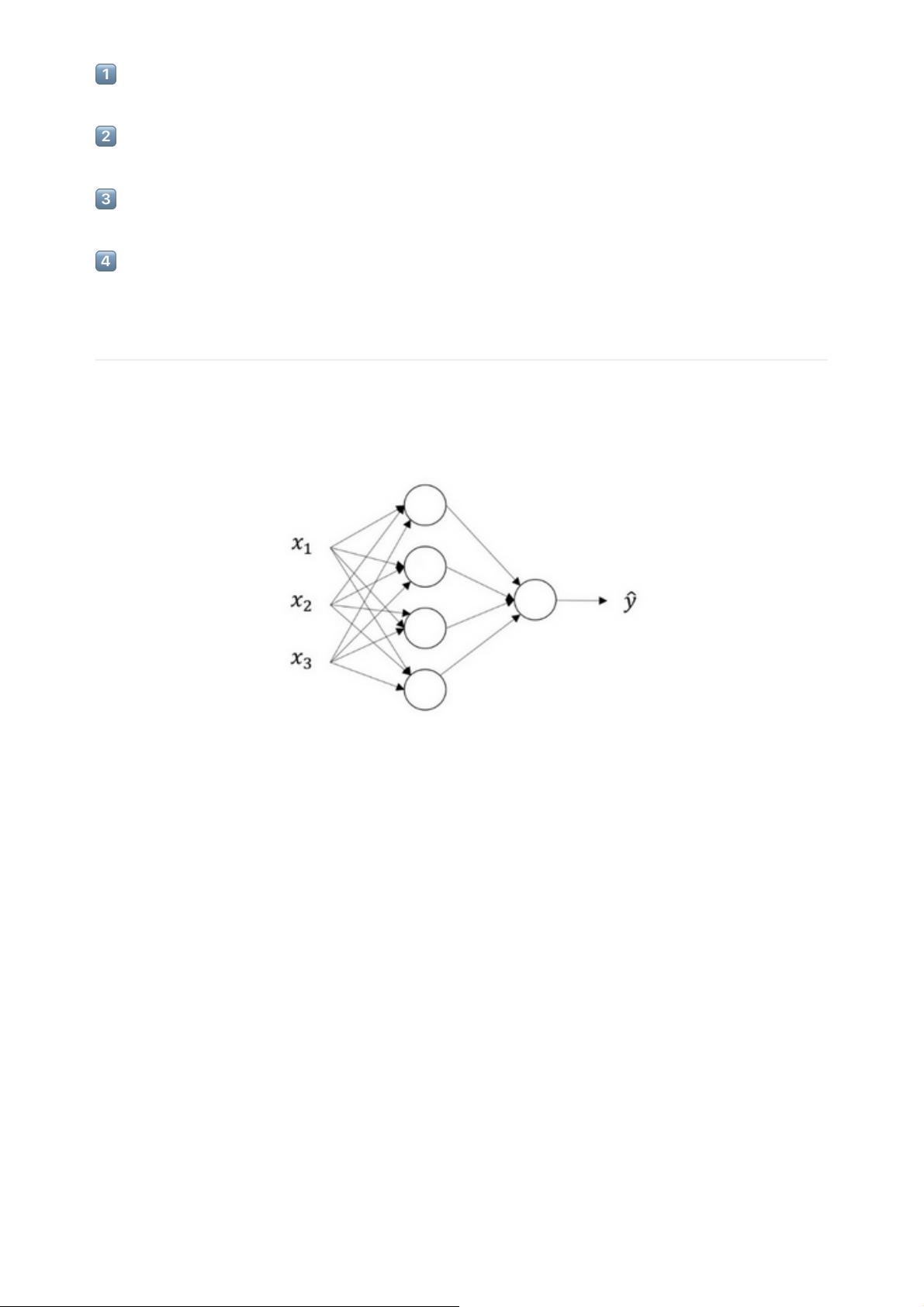

"第一门课:神经网络与深度学习1"是一门深入介绍机器学习领域中核心概念和技术的课程。本章节涵盖了神经网络的基本原理和深度学习的起源,特别是深度学习中的关键算法如深度神经网络(DNN),卷积神经网络(CNN)和循环神经网络(RNN)及其变种,如长短时记忆网络(LSTM)。课程开始时,提到了"Introduction to Deep Learning",强调了深度学习的引入和发展,以及它在人工智能领域的突破性作用。

课程详细介绍了优化算法,如动量优化(Momentum)、Adam优化器等,这些是训练深层神经网络时不可或缺的工具,它们通过调整权重更新策略来提高模型的收敛速度和性能。此外,还讨论了常用的激活函数,如sigmoid、ReLU(Rectified Linear Unit)等,它们在神经元中引入非线性,增强模型的表达能力。

对于计算机视觉任务,CNN(卷积神经网络)的应用被重点讲解,包括它们在图像识别、特征提取中的角色。同时,课程也提及了卷积层(CNN layers)和池化操作(pooling),这些都是CNN结构的核心组成部分。

课程还涉及到自然语言处理(NLP)的神经网络模型,如递归神经网络(RNN)和长短时记忆网络(LSTM),这些技术用于理解和生成文本序列,对于诸如语言翻译、情感分析等任务至关重要。NLP部分强调了词嵌入(word embeddings)和注意力机制(attention mechanisms)在模型中的应用。

神经网络的训练通常依赖于梯度下降法(gradient descent),这是一系列迭代过程,通过计算损失函数对参数的梯度来调整模型。课程中可能还涉及了诸如反向传播(backpropagation)这样的算法,这是优化过程的关键步骤。

此外,课程可能探讨了深度学习模型的调优策略,例如正则化(regularization)和dropout,以防止过拟合。在结束时,课程触及了一些基础模型的构建,如基础的多层感知机(Baselines),让学生理解从零开始构建复杂神经网络的基础。

"第一门课 神经网络和深度学习1"是一个全面的入门指南,旨在为学生提供必要的理论知识和实践技巧,让他们能够在这个快速发展的领域中立足。通过学习这个课程,学员将掌握如何设计、训练和评估深度学习模型,以解决现实生活中的各种问题。

281 浏览量

114 浏览量

1787 浏览量

267 浏览量

202 浏览量

163 浏览量

150 浏览量

162 浏览量

2025-01-04 上传

郭逗

- 粉丝: 33

最新资源

- Spring开发指南:V0.8预览版 - 持久层、Web工作流与AOP详解

- 精通Eclipse插件开发:从入门到实践

- DB2驱动的联系人信息管理系统数据库设计与实现

- Struts开发步骤详解:从创建工程到数据操作

- C#编程入门与进阶指南

- C#面试必备:核心概念与题目解析

- ESRI Shapefile格式详解:专业地理信息存储标准

- Hibernate缓存机制详解:事务、进程与集群范围

- Java正则表达式完全指南

- 整合STRUTS、SPRING与HIBERNATE实践笔记

- Oracle函数详解:SQL指令与字符串操作

- JAVA数据库编程详解:连接、操作与事务处理

- Java取余操作谜题:解析isOdd方法的陷阱

- 高质量C++/C编程规范与指南

- 计算机网络习题解析与解答

- 配置多节点JBoss服务器:端口修改指南