深度学习与矩阵运算:线性代数在AI中的应用

需积分: 9 60 浏览量

更新于2024-07-02

收藏 130.56MB PDF 举报

"AI综合笔记.pdf"

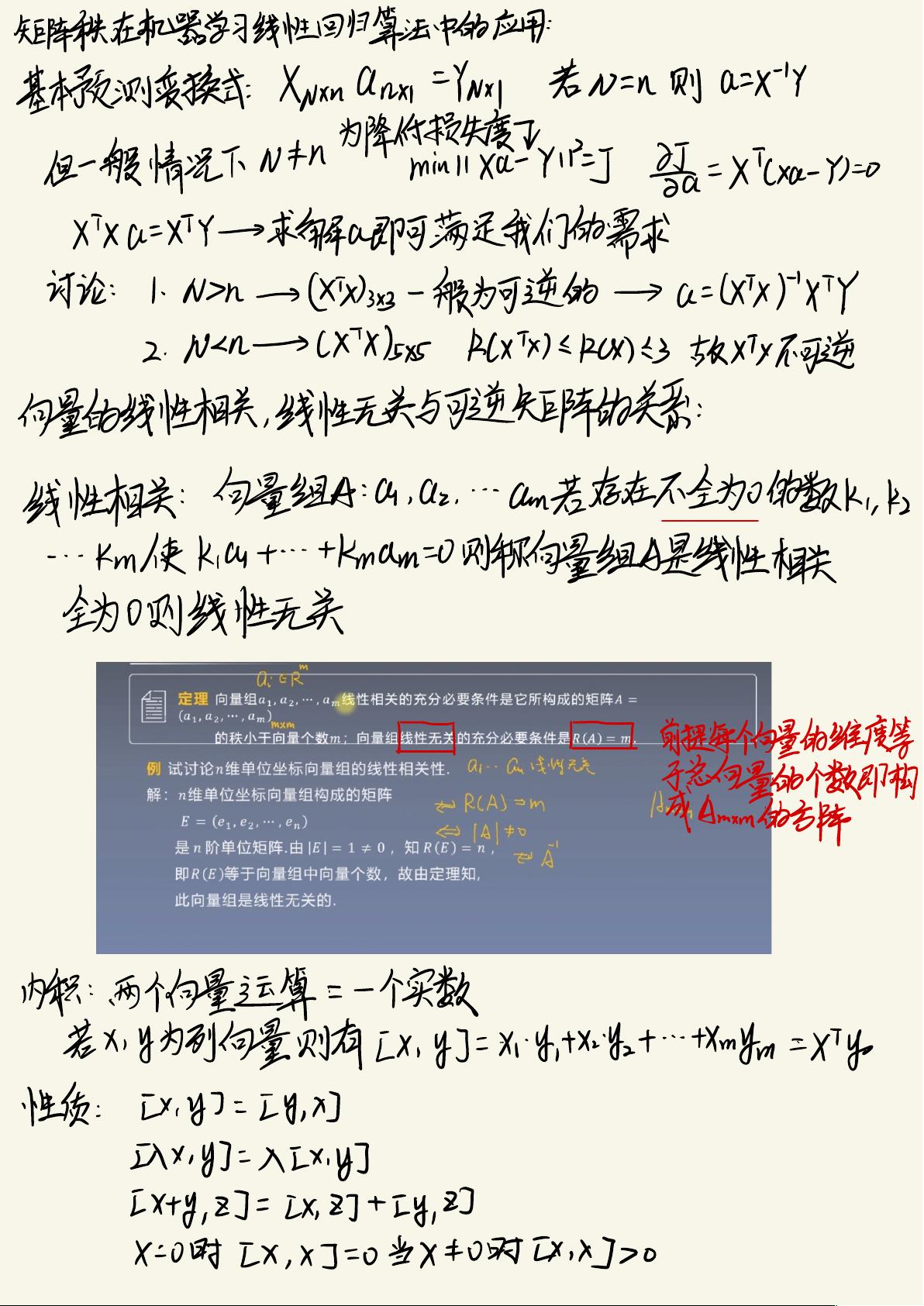

本笔记涵盖了人工智能(AI)中的重要数学基础知识,特别是线性代数在深度学习中的应用。线性代数是理解机器学习和深度学习算法的关键,因为它提供了处理高维数据的工具。

首先,笔记介绍了线性变换的概念,这涉及到矩阵的使用。矩阵乘法是线性代数中的核心运算,它描述了一个线性变换如何将一个向量空间映射到另一个。矩阵乘法满足结合律,即三个矩阵\( A \),\( B \)和\( C \)的乘积\( (AB)C = A(BC) \)始终成立,但不满足交换律,即\( AB \neq BA \)。在深度学习中,矩阵运算用于描述神经网络中的权重和输入数据之间的关系,例如,一个10到100的线性层,接着是一个100到512的线性层。

矩阵乘法在神经网络中的应用体现在隐藏层的计算上,其中输入图像经过一系列的线性变换和非线性激活函数来学习复杂的模式。笔记提到,对于一个输入矩阵\( X \)和权重矩阵\( W \),神经网络的隐藏层输出可以表示为矩阵乘法的结果,即\( Y = WX + b \),其中\( b \)是偏置项。

笔记还讨论了矩阵的性质,包括矩阵的转置和对称性。矩阵的转置是通过交换矩阵的行和列得到的,记为\( A^T \)。如果一个矩阵\( A \)与其转置相等,即\( A = A^T \),那么它被称为对称矩阵。对称矩阵在统计学中尤其重要,因为它们可以表示变量之间的相关性,如样本的协方差矩阵。

在机器学习中,解决线性方程组是常见的任务,这通常涉及计算行列式。行列式是一个特殊的数值,它可以用来确定矩阵是否可逆,并在解线性方程组时计算逆矩阵。行列式的计算涉及到全排列和逆序数,逆序数是计算行列式值的一个关键步骤。笔记给出了计算逆序数的例子,并说明了行列式的性质,如交换两行会使行列式变号,所有元素都为零的行或列对应的行列式为零,以及行(列)成比例的行列式也等于零。

此外,笔记还提到了矩阵的迹,即矩阵对角线上元素的和,它在某些情况下与交换后的矩阵乘积的迹相等,即使两个矩阵无法直接相乘。这些基本概念构成了理解和应用机器学习模型的基础,特别是深度学习模型,其中矩阵运算无处不在,从卷积神经网络(CNNs)到递归神经网络(RNNs)和自注意力机制。深入理解这些数学原理对于优化模型性能和解析模型行为至关重要。

点击了解资源详情

点击了解资源详情

点击了解资源详情

2021-07-07 上传

2021-05-23 上传

2024-02-03 上传

2021-05-04 上传

2021-11-24 上传

2023-10-14 上传

Per_HR7

- 粉丝: 106

- 资源: 27

最新资源

- 竞速

- hamdown:[WIP]面向Haml和Markdown粉丝的下一代模板语言

- 参考资料-客户尽职调查在金融服务创新形势下的挑战与对策.zip

- galaxyjs.github.io:GalaxyJS的官方文档网站

- Disable numbers-crx插件

- cesarevalo22:PsicoAsistenteWeb接口React

- 弹簧质量阻尼器:弹簧质量阻尼器模型的PID控制-matlab开发

- 计算器

- Dobrabet-crx插件

- 第一个实验室Ruby学习cli-nitrous-q-000

- MERN-Template:感谢Dakota Rennemann和佛罗里达大学开源俱乐部。 创建的模板存储库将使用Heroku部署启动MERN堆栈项目。 因此,它是针对此用例的,如果您发现此模板但不属于该组,请在以下位置使用原始存储库

- SimpleApp

- 3x3Determinant App:可视化如何取 3x3 矩阵的行列式-matlab开发

- Widget 101: Últimas publicaciones-crx插件

- 插值超级功率q-000

- Breadfit_test