PyTorch实战:逻辑回归与多元分类基础

需积分: 3 53 浏览量

更新于2024-08-03

收藏 1.5MB PDF 举报

在"PyTorch实现逻辑回归、多元分类-谢TS的博客.pdf"这篇文章中,作者探讨了逻辑回归和多元分类在深度学习框架PyTorch中的应用。首先,文章区分了线性回归和非线性回归,强调逻辑回归的独特性,它是一种特殊的二元分类方法,其输出是离散的,通常表现为0和1,而非连续值。逻辑回归的核心在于使用sigmoid函数作为激活函数,将模型的输出转换为概率形式,使得概率之和等于1,便于决策。

激活函数sigmoid(x) = 1 / (1 + e^(-x))的特点是输出范围在(0, 1),适用于二分类问题,表示样本属于某一类别的概率。对于多类别分类问题,如逻辑回归的多元版本,会使用softmax函数替代sigmoid,softmax函数接收多个输入,输出的概率分布总和为1,方便判断每个类别的相对概率。

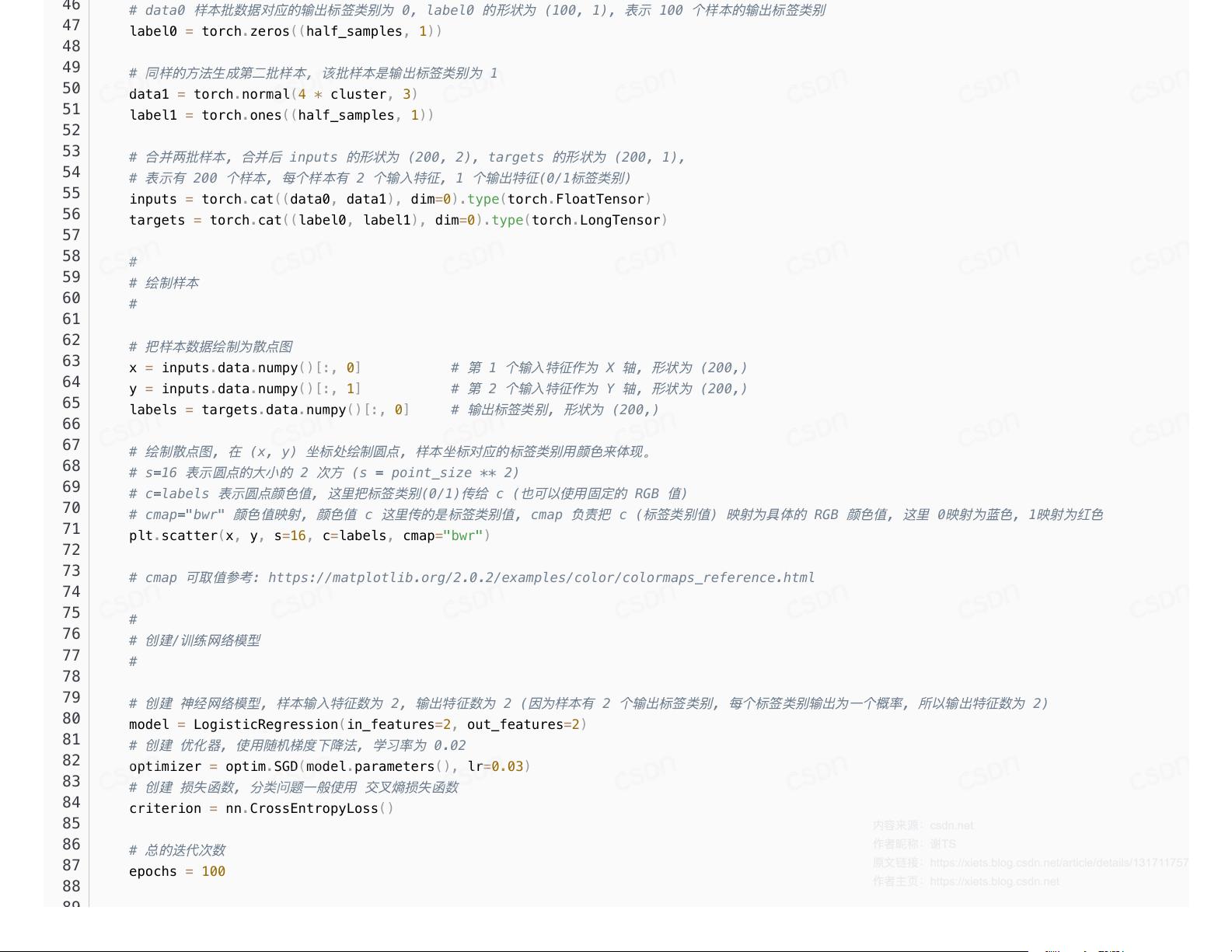

文章中还提到了在PyTorch中实现逻辑回归的示例。通过创建一个简单的Python脚本,随机生成具有两个输入特征和二元标签的数据样本,然后利用PyTorch构建模型,其中模型可能包括线性层、sigmoid激活函数以及交叉熵损失函数(CrossEntropyLoss)。交叉熵损失函数是分类问题的标准选择,它衡量预测概率分布与真实标签之间的差异。

在这个示例中,目标是训练模型来预测每个样本属于哪一类,通过反向传播算法优化模型参数,使得损失函数最小化。这展示了如何将逻辑回归的基本原理应用于实际的深度学习任务中,以便对多类数据进行分类预测。

总结来说,这篇博客介绍了逻辑回归的理论基础、在PyTorch中的实现方式,以及如何用它处理二元和多元分类问题。对于想要学习和实践PyTorch的读者,这是理解神经网络基础和分类任务的重要参考资料。

2022-02-14 上传

2023-07-17 上传

2023-07-17 上传

2023-07-17 上传

2023-02-20 上传

2024-10-20 上传

2024-10-20 上传

谢TS

- 粉丝: 2w+

- 资源: 23

最新资源

- 深入浅出:自定义 Grunt 任务的实践指南

- 网络物理突变工具的多点路径规划实现与分析

- multifeed: 实现多作者间的超核心共享与同步技术

- C++商品交易系统实习项目详细要求

- macOS系统Python模块whl包安装教程

- 掌握fullstackJS:构建React框架与快速开发应用

- React-Purify: 实现React组件纯净方法的工具介绍

- deck.js:构建现代HTML演示的JavaScript库

- nunn:现代C++17实现的机器学习库开源项目

- Python安装包 Acquisition-4.12-cp35-cp35m-win_amd64.whl.zip 使用说明

- Amaranthus-tuberculatus基因组分析脚本集

- Ubuntu 12.04下Realtek RTL8821AE驱动的向后移植指南

- 掌握Jest环境下的最新jsdom功能

- CAGI Toolkit:开源Asterisk PBX的AGI应用开发

- MyDropDemo: 体验QGraphicsView的拖放功能

- 远程FPGA平台上的Quartus II17.1 LCD色块闪烁现象解析